Что действительно нужно, чтобы интегрировать генеративный ИИ в современную разработку игр? В этой статье мы рассмотрим, как с помощью Leonardo AI и Photoshop Generative Fill можно создать локации для игр с поиском предметов. Раскроем тонкости рабочего процесса, ошибки генерации и ограничения ИИ, с которыми столкнулись в ходе работы.

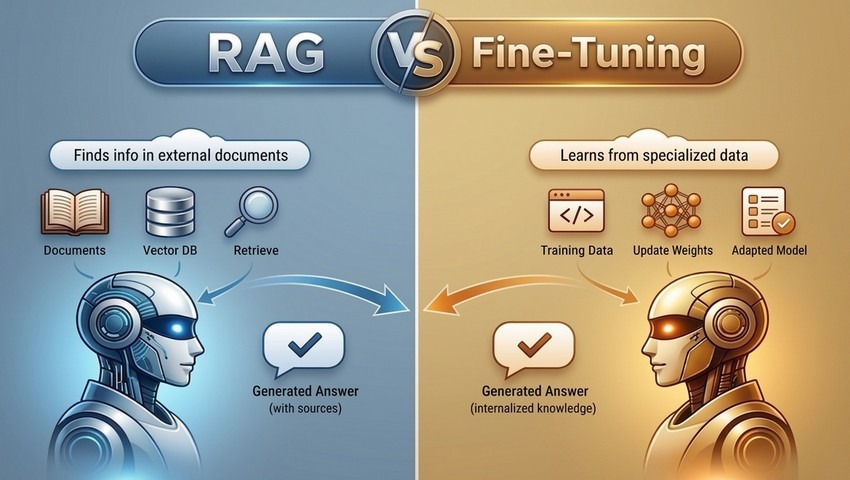

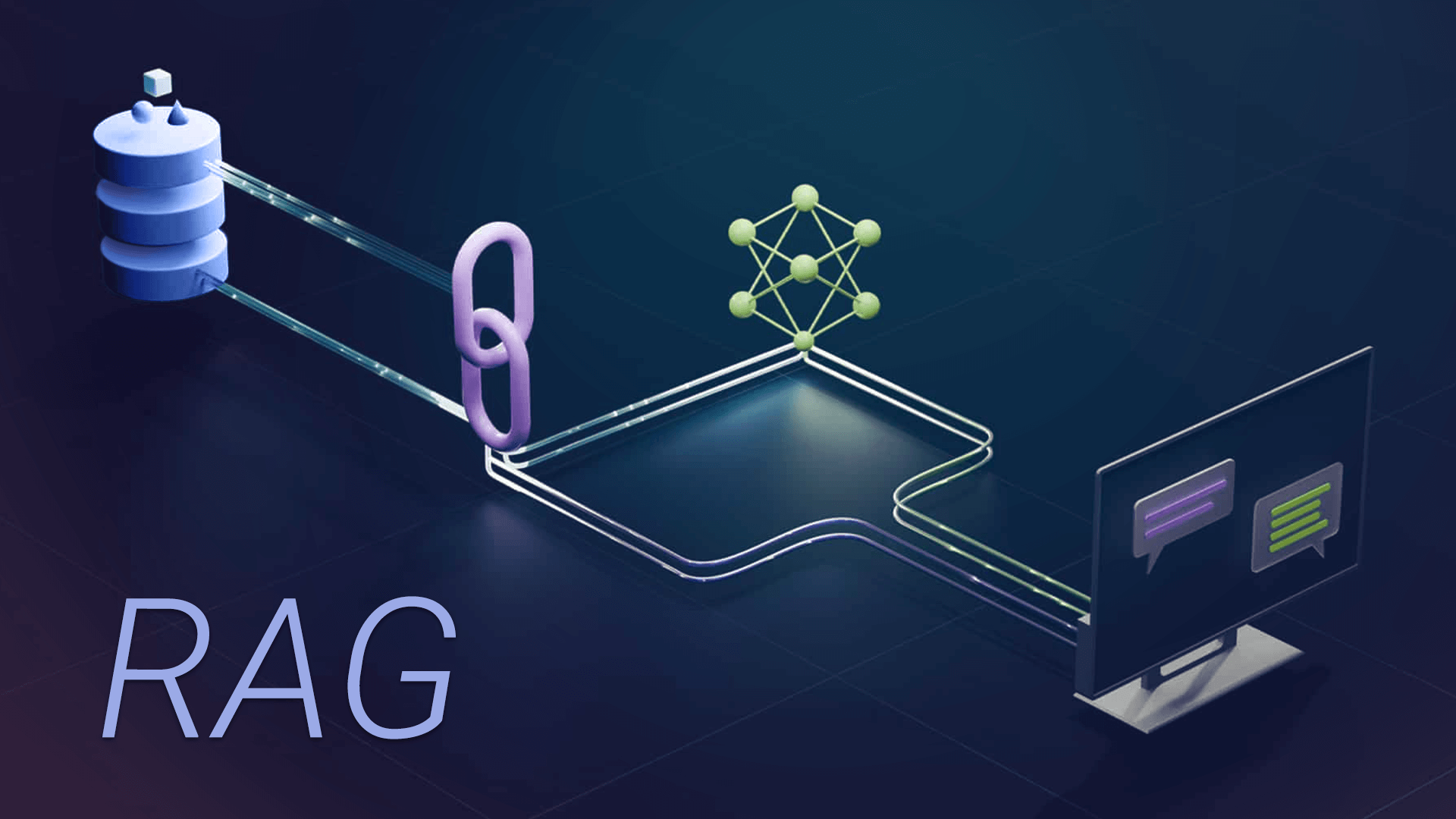

RAG и fine-tuning – это не конкурирующие подходы, они решают принципиально разные задачи: один дает моделям доступ к актуальным внешним данным, а другой меняет способ их мышления. Настоящая сила заключается в понимании, когда использовать каждый из них, и как их сочетание позволяет создавать более быстрые, умные и надежные ИИ-системы.

ИИ-агенты уже давно превзошли ИИ-ассистентов. Они способны автономно планировать, анализировать, взаимодействовать и выполнять полные рабочие процессы практически без участия человека. Рассмотрим подробнее, почему мультиагентные системы и локальные агенты становятся стратегическим ядром крупнейших компаний.

Где нейросети ускоряют работу, а где начинается настоящая магия творчества? Узнайте из практики арт-студии, как эффективно использовать ИИ для быстрой генерации концептов, персонажей и бэкграундов, а в каких случаях без руки художника качественный результат пока невозможен.

ИИ больше не работает за кулисами игр! Он активно формирует то, как строятся миры, как мыслят персонажи и как игроки проживают каждый момент геймплея. В этой статье мы рассмотрим, почему ИИ перестал быть конкурентным преимуществом, а стал базовым требованием для студий, стремящихся создавать масштабируемые, иммерсивные и перспективные игры.

Загляните за кулисы создания Guess Mess – казуальной игры, рожденной из причудливого воображения искусственного интеллекта. Узнайте, как мы использовали хаотичную креативность ChatGPT для создания 1000 уникальных уровней и сделали его “ошибки” основой визуального стиля.

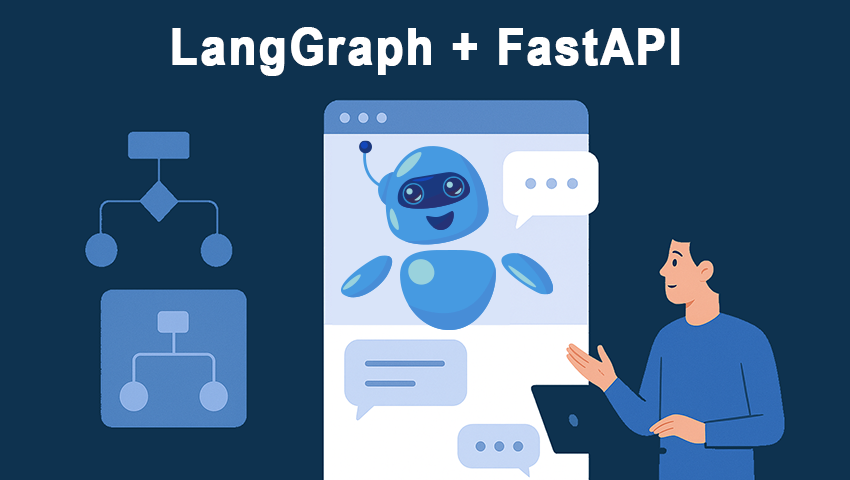

LangGraph изменяет подход к разработке чат-ботов, заменяя линейные цепочки LangChain на гибкую систему графов,основанную на состояниях и поддерживающую разветвления диалогов и Human-In-The-Loop. Вместе с FastAPI это создает масштабируемые микросервисы ботов, обрабатывающих сложные диалоги без потери контекста.

По мере того как АI выходит за пределы простого распознавания шаблонов, модели рассуждения открывают способность мыслить, адаптироваться и понимать сложные ситуации. От вероятностной логики к агентному ИИ и интерактивному диалогу – эти модели знаменуют переход к действительно умным системам.

Галлюцинации ИИ – случаи, когда ИИ генерирует ложный или обманчивый контент – становятся все более частыми, даже в самых совершенных моделях, таких как GPT или Gemini. Выясним вместе, почему такие ошибки случаются, какие реальные риски они несут и как разработчики и пользователи могут их минимизировать.

RAG позволяет системам ИИ формировать точные ответы, используя современные внешние базы знаний. Узнайте больше об архитектуре RAG, практическом применении и ключевых преимуществах, таких как возможность отслеживания первоисточников, повышенная надежность и прозрачность данных.

Ideogram 2.0 – новый генератор изображений на основе ИИ с разнообразными стилями, созданными для воплощения уникальных творческих задумок. Узнайте, какие настройки модели улучшат ваши текстовые промпты и как создать высококачественные изображения всего за пару кликов.

От бионического нейронного двигателя A18 до повышенного уровня конфиденциальности – исследуйте топ 6 инноваций в сфере искусственного интеллекта и машинного обучения из презентации Apple 2024 года. Узнайте, как эти достижения формируют будущее устройств Apple.

Пришло время исследовать функцию Leonardo AI – Style Reference. Всего за 1 минуту вы узнаете, как легко и быстро перенести любой стиль с помощью генератора изображений абсолютно бесплатно. Загрузите выбранный референс, а Leonardo AI сделает все остальное.

Функция Leonardo AI: Image to Motion позволяет легко превращать ваши статические изображения в динамические, увлекательные анимации всего за несколько кликов! Наш пошаговый туториал поможет оживить ваши фото и анимировать любое изображение онлайн всего за 1 минуту.

Исследователи из MIT CSAIL и Google Research представили "Alchemist" – модель, которая предлагает беспрецедентную точность в управлении свойствами материалов на изображениях, изменяя ключевые атрибуты объектов, такие как шероховатость, металличность, альбедо и прозрачность.