Mamba-3 – нова ера в мовному моделюванні

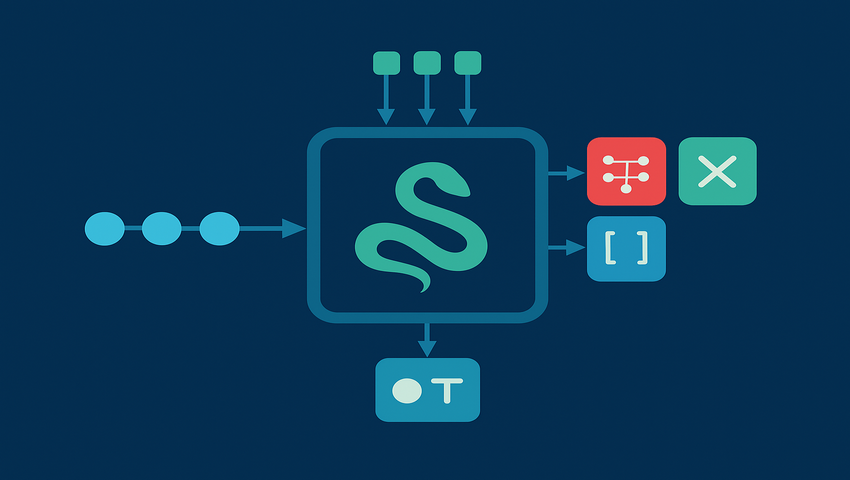

Зі створенням Mamba-3 у світі штучного інтелекту розпочався новий етап. Mamba-3 – це передова нейронна архітектура, яка встановлює нові стандарти продуктивності, ефективності та можливості для великих мовних моделей (LLM).

Mamba-3 продовжує розвиток ідей, започаткованих ще у 2023 році з появою оригінальної архітектури Mamba. На відміну від трансформерів (Transformers), які майже десятиліття домінували у мовному моделюванні, Mamba спирається на моделі стану (State Space Models, SSM) – клас моделей, спершу створених для прогнозування безперервних послідовностей у таких галузях, як теорія керування та обробка сигналів.

Трансформери, попри свою потужність, мають серйозний недолік – квадратичне зростання потреб у пам’яті та обчисленнях із подовженням послідовності, що створює “вузьке місце” під час навчання та інференсу. Натомість модель Mamba забезпечує лінійне або навіть постійне використання пам’яті під час інференсу, що дозволяє ефективно працювати з надзвичайно довгими послідовностями. При цьому вона досягає або перевершує точність моделей Transformer аналогічного розміру на стандартних бенчмарках, суттєво скорочуючи затримку та зменшуючи вимоги до апаратного забезпечення.

Основна перевага Mamba полягає в її моделі вибіркового простору станів (Selective State Space Model, S6), яка забезпечує вибіркову увагу, подібну до трансформера. Завдяки динамічному регулюванню пріоритетів попередніх вхідних даних, моделі Mamba можуть зосередитися на релевантному контексті, “забуваючи” менш корисну інформацію. Це досягається за допомогою оновлень станів, що залежать від вхідних даних. У поєднанні з паралельним скануванням, що враховує апаратне забезпечення, ці моделі можуть ефективно виконувати масштабні обчислення на графічних процесорах (GPU), максимізуючи пропускну здатність без втрати якості.

Mamba-3 має кілька унікальних особливостей, які відрізняють її від попередників

- Трапецієподібна дискретизація (Trapezoidal Discretization) – підвищує виразність SSM та зменшує потребу у коротких згортках, що покращує результати в задачах мовного моделювання.

- Комплексне оновлення простору станів (Complex State-Space Updates) – дозволяє моделі відстежувати складні залежності, виконуючи логічні та арифметичні операції, які раніше були недоступні для попередніх версій Mamba.

- Багатоканальний вхід і вихід для SSM (Multi-Input, Multi-Output (MIMO) SSM) – збільшує ефективність інференсу, підвищуючи інтенсивність обчислень і використання апаратних ресурсів без додаткового навантаження на пам’ять.

Ці інновації в поєднанні з архітектурними удосконаленнями, такими як QK-нормалізація та індивідуальні зсуви, гарантують, що Mamba-3 не тільки забезпечує чудову продуктивність, але й повною мірою використовує апаратні можливості.

Результати всебічного тестування показують, що Mamba-3 відповідає або перевершує показники моделей Transformer, Mamba-2 та Gated DeltaNet у завданнях мовного моделювання, відстеження станів і пошуку інформації. Завдяки своїй SSM-архітектурі модель зберігає довготривалий контекст, а селективний механізм забезпечує використання лише релевантної інформації – ключовий фактор для моделюванні послідовностей.

Втім, Mamba-3 має певні обмеження. Архітектури з фіксованим станом поки що поступаються моделям з механізмом уваги (attention) у складних завданнях пошуку та вилучення контексту. Дослідники вбачають перспективу у створенні гібридних архітектур, які поєднають ефективність Mamba з механізмами пошуку, притаманним трансформерам.

Mamba-3 – це не просто чергове оновлення, а переосмислення принципів побудови нейронних мереж, що поєднує швидкість, масштабованість і точність. Використовуючи принципи структурованих SSM та оновлення стану залежно від вхідних даних, Mamba-3 кидає виклик домінуванню трансформерів у мовному моделюванні, пропонуючи життєздатну альтернативу, яка плавно масштабується як за довжиною послідовності, так і за обмеженнями апаратного забезпечення.