Достижение MIT: ИИ генерирует высококачественные изображения в 30 раз быстрее

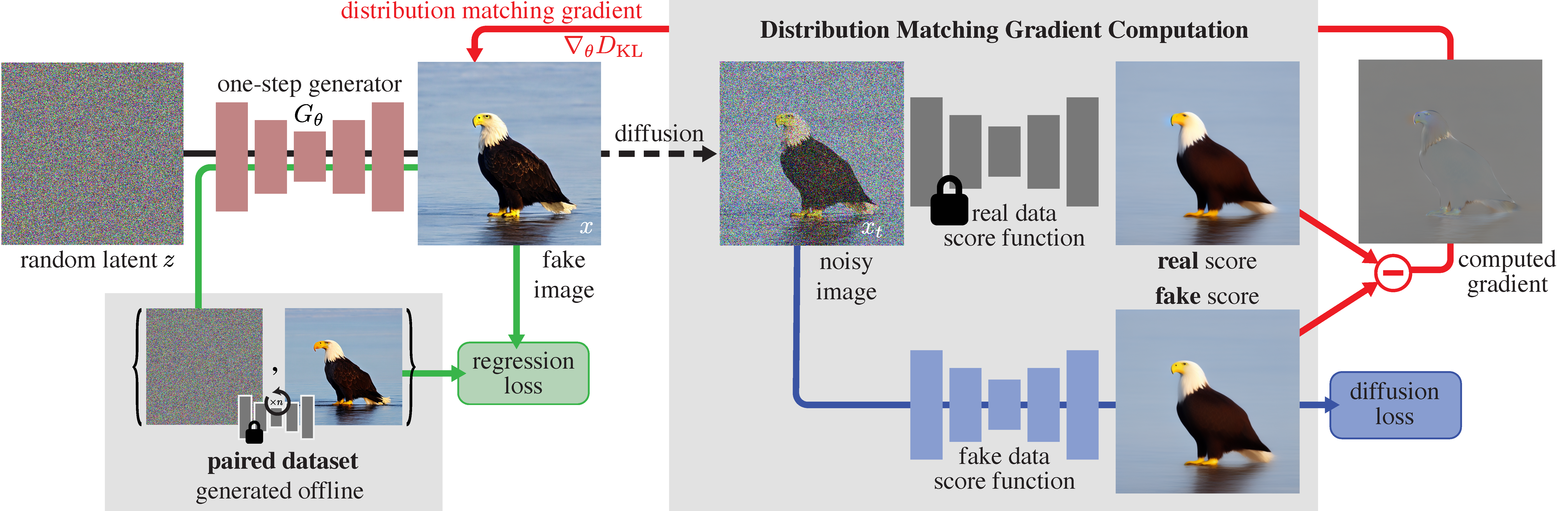

Исследователи Лаборатории компьютерных наук и искусственного интеллекта (CSAIL) Массачусетского технологического института (MIT) представили инновационный метод под названием Distribution Matching Distillation (DMD). Новый подход упрощает традиционный многоэтапный процесс создания моделей диффузии до одного шага, устраняя предыдущие ограничения.

Обычно генерация изображений была сложным и трудоемким процессом, который предусматривал многочисленные итерации для совершенствования конечного результата. Однако недавно разработанный фреймворк DMD упрощает этот процесс, значительно сокращая время вычислений, сохраняя или даже превосходя качество сгенерированных изображений. Исследовательская группа под руководством Тяньвей Инь (Tianwei Yin), аспиранта MIT, достигла впечатляющего успеха: ускорила работу существующих моделей диффузии, таких как Stable Diffusion и DALL-E-3, в 30 раз. Сравните результаты генерации изображения Stable Diffusion (слева) после 50 шагов итерации и DMD (справа) всего после одного шага. Качество и детализация поражают!

Ключ к успеху DMD заключается в его инновационном подходе, который сочетает принципы генеративно-состязательных сетей (GAN) с принципами диффузионных моделей. Путем переноса знаний сложных моделей в более простую и быструю модель, DMD достигает генерации визуального контента за один шаг.

Но как DMD достигает этого? Система сочетает две составляющие:

1. Потеря регрессии: закрепляет отображение, обеспечивая грубую организацию пространства изображений во время обучения.

2. Потеря соответствия распределения: выравнивает вероятность генерации изображения с моделью ученика с частотой его появления в реальном мире.

Благодаря использованию двух моделей диффузии в качестве ориентиров, DMD минимизирует расхождение распределения между созданными и реальными изображениями, что приводит к более быстрой генерации без потери качества.

В своем исследовании Инь и его коллеги продемонстрировали эффективность DMD в различных тестах производительности (benchmark). В частности, DMD показал стабильные результаты во время проведения такого популярного бенчмарка, как ImageNet, достигнув показателя начального расстояния Фреше (FID) только 0,3, что свидетельствует о качестве и разнообразии сгенерированных изображений. Кроме того, DMD преуспел в преобразовании текста в изображения в промышленных масштабах, продемонстрировав свою универсальность и практическую применимость в реальном мире.

Несмотря на свои выдающиеся достижения, производительность DMD неразрывно связана с возможностями модели учителя, используемой в процессе дистилляции. Хотя текущая версия использует Stable Diffusion v1.5 в качестве модели учителя, в будущих итерациях могут использоваться более продвинутые модели, открывая новые возможности для высококачественного визуального редактирования в реальном времени.