Акции американских технологических компаний падают, вызывая опасения по поводу краха рынка, поскольку энтузиазм по поводу искусственного интеллекта постепенно угасает. Ожидается, что в ближайшие недели отрицательные показатели сохранятся.

Карикатуры Фионы Катаускас бросают вызов устоявшимся представлениям и вызывают дискуссии. Изучите ее работы, чтобы найти в них пищу для размышлений.

ИИ меняет экзамены: устные оценки, более строгие меры безопасности, более быстрое оценивание. В экзаменационном сезоне 2025 года произойдет переход от бумаги и ручки к ИИ.

GPT-5 от OpenAI менее болтлив, что меняет уникальное взаимодействие с пользователями. Разработчик программного обеспечения Линн Вейлт хвалит его адаптивность и характерную речь.

TikTok переносит акцент на искусственный интеллект, ставя под угрозу рабочие места в сфере доверия и безопасности в Великобритании. Более строгие правила направлены на ограничение вредного онлайн-контента.

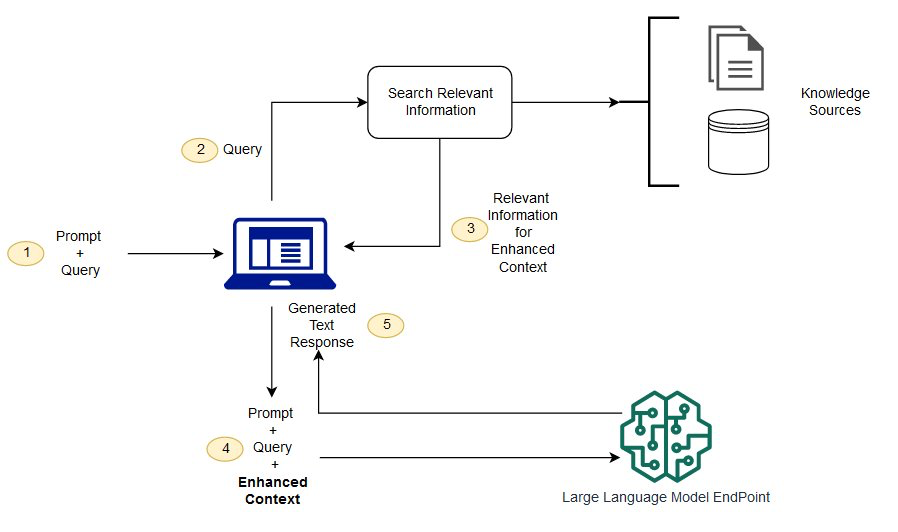

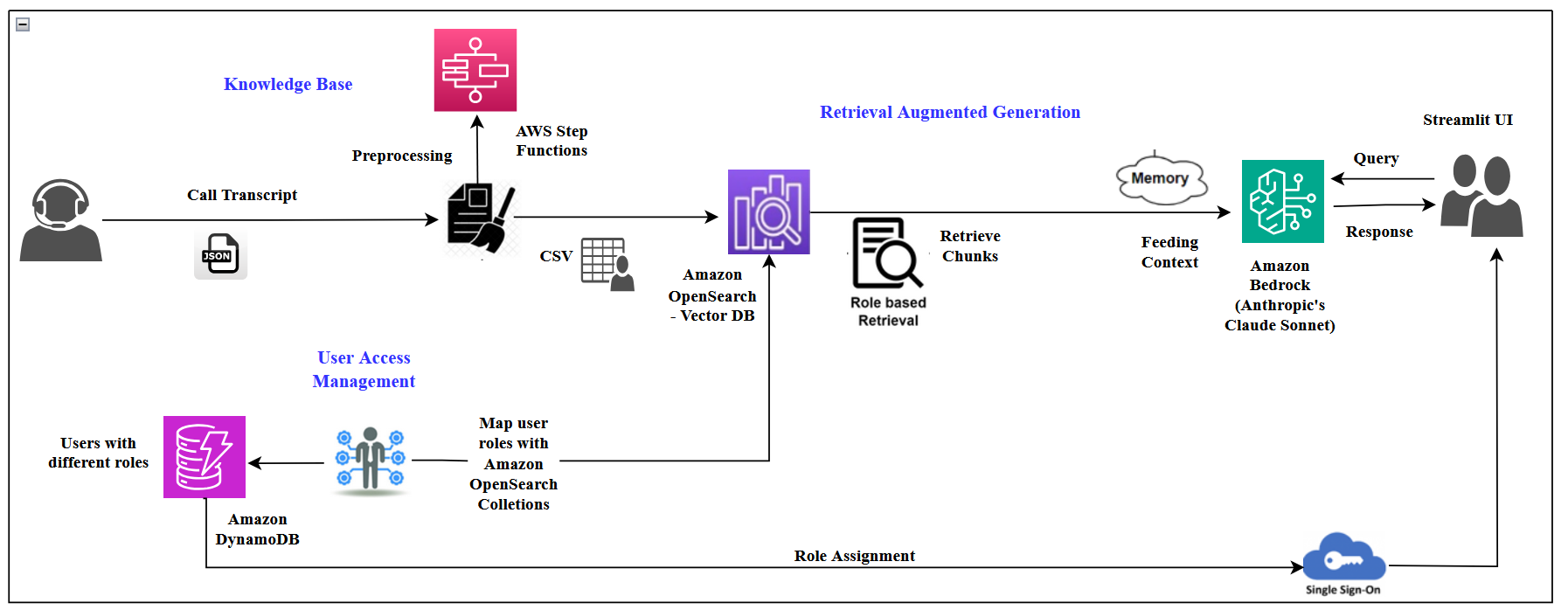

Новые технологии в области геопространственных данных предлагают пользователям совершенно новый опыт. Интеграция Amazon Bedrock может повысить эффективность и дать новые возможности для всех сотрудников.

Фабрики искусственного интеллекта становятся новой нормой: интернет-гиганты и правительства инвестируют в создание огромных центров обработки данных для обучения искусственного интеллекта. Передовые технологии и сетевые архитектуры меняют представление о вычислениях, а графические процессоры и инфраструктура искусственного интеллекта требуют оборудования промышленного масштаба.

27-й сезон «Южного парка» затрагивает такие спорные темы, как рейды ICE, Кристи Ноем и искусственный интеллект, сохраняя высокие рейтинги и актуальность. Эпизод «Sickofancy» направлен против ChatGPT и индустрии технологий, демонстрируя своевременные социальные комментарии сериала.

Статья: «Вычисление определителя матрицы с помощью метода Гаусса-Шиффля в C#». Узнайте, как проверять обратные матрицы и реализовывать эту технику в коде C#. Изучите определители матриц и их важность в алгоритмах машинного обучения.

Приложения и услуги на базе искусственного интеллекта играют важную роль в корпоративном секторе. Infosys Topaz интегрирует генеративный искусственный интеллект AWS для создания эффективных корпоративных решений, таких как сокращение времени обработки звонков и автоматизация задач технической поддержки в крупных энергетических компаниях.

Генеральный директор Австралийской ассоциации звукозаписывающих компаний призывает технологические компании соблюдать законы об авторском праве. Соглашение ACTU с технологическим сектором об оплате за использование творческого контента в обучении искусственного интеллекта вызывает беспокойство среди творческих профессионалов.

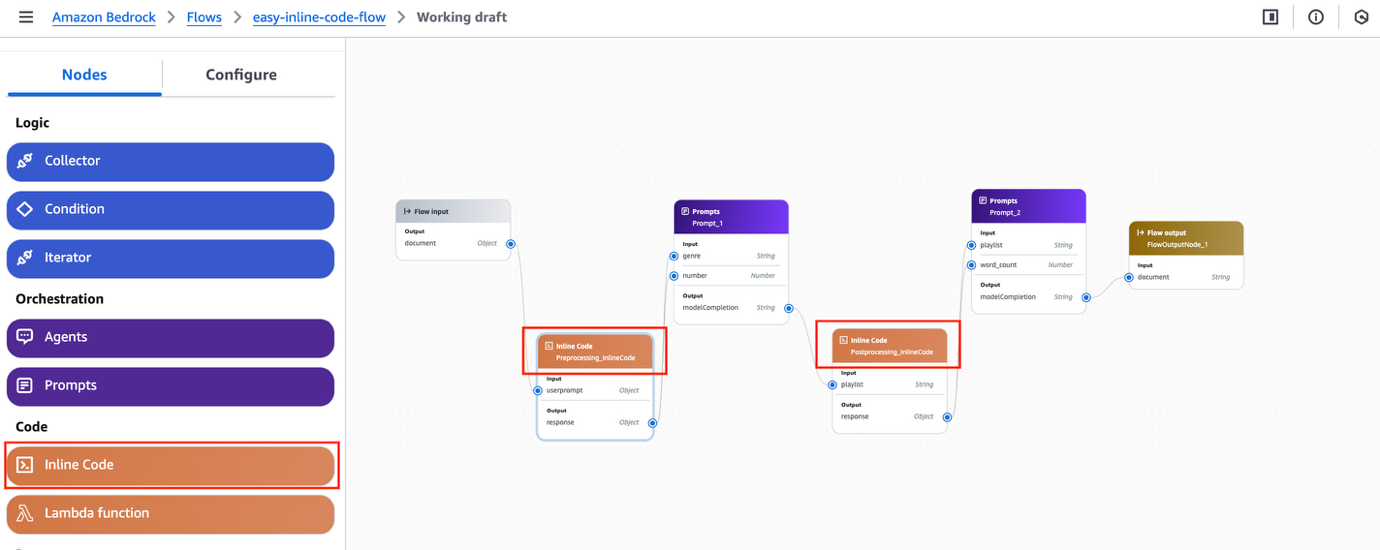

Amazon Bedrock Flows представляет встроенные узлы кода, позволяющие таким пользователям, как Thomson Reuters, оптимизировать разработку генеративных приложений искусственного интеллекта за счет упрощения предварительной обработки, постобработки и сложных сценариев использования в рамках рабочего процесса. Эта функция ускоряет внедрение в предприятиях, снижает затраты на обслуживание и обеспечи...

Заместитель премьер-министра Анжела Рейнер столкнулась с судебным иском в связи с строительством дата-центра мощностью 90 МВт в графстве Бакингемшир на территории зеленого пояса. Активисты критикуют отсутствие оценки воздействия на окружающую среду в связи с планами лейбористского правительства по расширению мощностей искусственного ин

Несколько новостных изданий, в том числе Wired и Business Insider, удалили статьи, приписываемые Марго Бланшар, поскольку они были созданы с помощью искусственного интеллекта.По меньшей мере шесть изданий удалили статьи под именем Марго Бланшар, которые были созданы с помощью искусственного интеллекта.

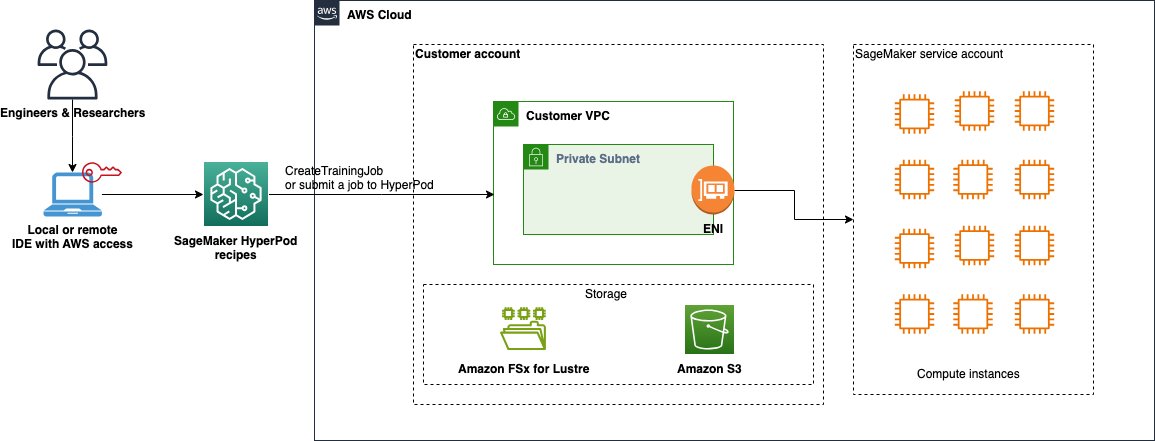

Узнайте, как настроить модели GPT-OSS с помощью SageMaker AI, используя библиотеки Hugging Face и рецепты SageMaker HyperPod для простой и высокопроизводительной настройки кластера. Готовые конфигурации упрощают распределенное обучение, позволяя GPT-OSS обрабатывать многоязычные рассуждения в моделях Meta Llama, Mistral и DeepSeek.