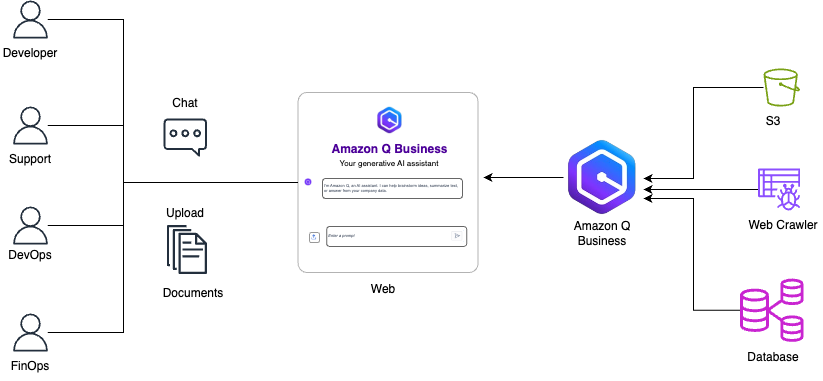

Amazon Q Business упрощает доступ к лучшим практикам AWS для различных команд, повышая производительность и обмен знаниями. MuleSoft использует Amazon Q Business для создания генеративного помощника на базе искусственного интеллекта для более чем 100 инженеров, оптимизируя панель Cloud Central.

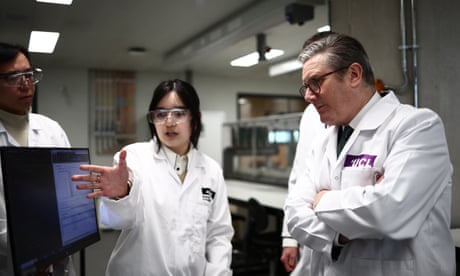

Министры рассматривают возможность разрешить частным компаниям использовать данные NHS для инноваций в области ИИ. Кейр Стармер объявляет о том, что ИИ будет разрабатывать новые решения в области здравоохранения, используя анонимные данные пациентов.

Подкаст Virtually Parkinson использует искусственный интеллект для интервью со знаменитостями, вызывая споры и любопытство. Сложная операция обеспечивает беспрепятственное подражание модели искусственного интеллекта покойному Майклу Паркинсону.

Растущая доступность экстремистского контента на менее модерируемых платформах представляет угрозу национальной безопасности, поскольку эксперты предупреждают о цифровой радикализации. Озабоченность вызывает доступность таких материалов, как руководства по убийствам и файлы 3D-печати оружия, на таких платформах, как ChatGPT.

Согласно отчетам Verizon и Salesforce, среди малых предприятий наблюдается резкий рост внедрения ИИ. Утверждения о широком распространении ИИ среди малых предприятий, скорее всего, завышены.

Регуляризация высокоразмерных пространств с различными коэффициентами для каждой переменной с помощью аппроксимированной Лапласом байесовской оптимизации в логистической регрессии. Сравнение с сеточным поиском для оптимального выбора коэффициентов регуляризации в примере бинарной классификации.

Министр технологий Питер Кайл стремится сделать Великобританию лидером в области ИИ, уравновесив экономический рост с вопросами безопасности в Интернете. Убедить гигантов Кремниевой долины поддержать революцию ИИ в условиях политической напряженности - непростая задача для лейбористского правительства.

Авторы, в том числе Сара Сильверман, обвиняют генерального директора Meta Марка Цукерберга в том, что он одобрил использование пиратских наборов данных книг для обучения искусственного интеллекта. Внутренние коммуникации свидетельствуют о том, что одобрение было получено, несмотря на предупреждения внутри компании.

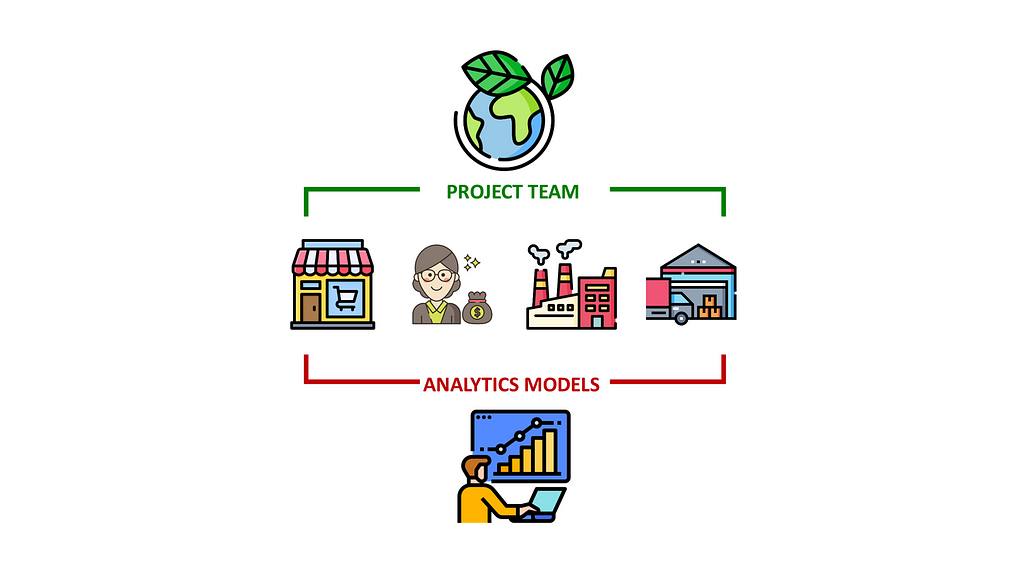

Аналитика данных может помочь компаниям в создании устойчивых стратегий за счет согласования различных целей между отделами. Один из примеров иллюстрирует, как аналитические модели поддерживают «зеленые» инициативы при разработке экономически эффективных и экологичных сетей цепочек поставок.

Оценка модели выходит за рамки точности при калибровке модели. Узнайте, как оценить надежность прогнозов и доверительные оценки вероятности. Калибровка гарантирует, что модели отражают истинную вероятность правильных прогнозов, что очень важно для реальных приложений.

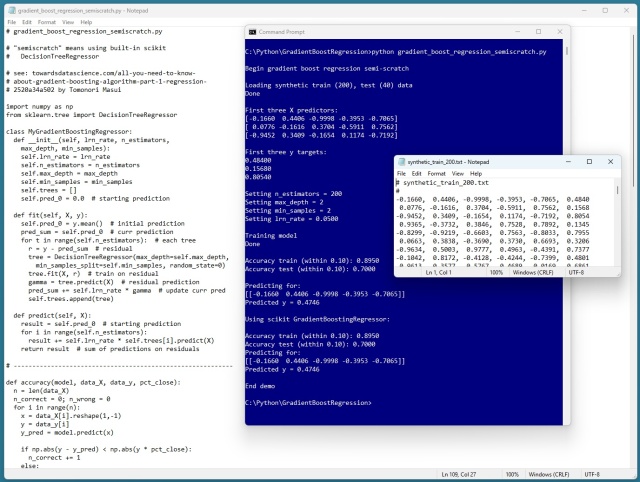

Gradient boosting regression (GBR) использует деревья решений для предсказания значений. Демонстрация на Python демонстрирует точность GBR в предсказании синтетических данных, совпадающих с результатами из библиотеки scikit. XGBoost и LightGBM - популярные библиотеки GBR для энтузиастов машинного обучения.

Элон Маск предлагает использовать самообучающиеся синтетические данные, поскольку ИИ-компании сталкиваются с нехваткой данных. Некоторые предостерегают от потенциального «краха модели».

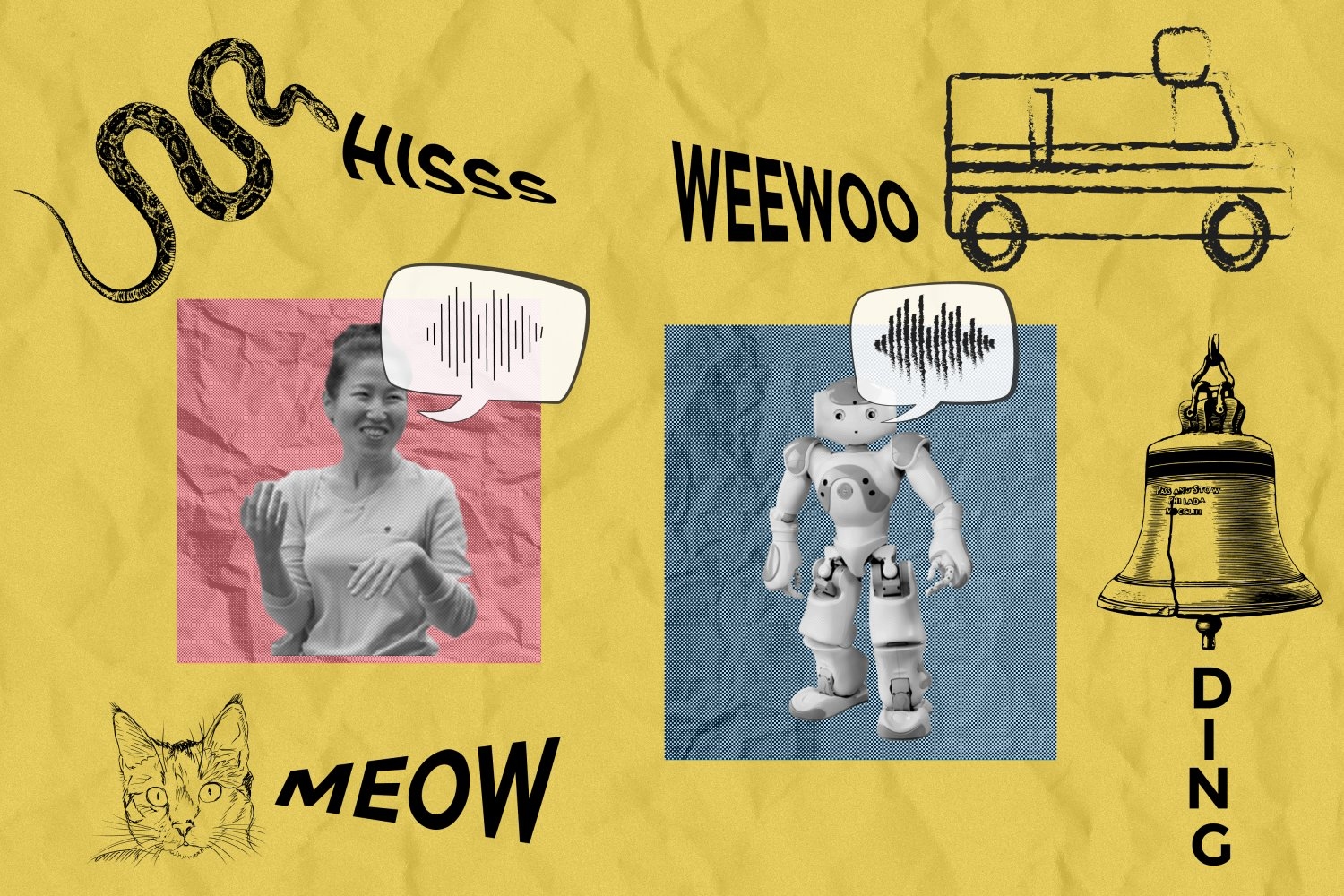

Исследователи MIT CSAIL создали систему искусственного интеллекта, которая имитирует человеческие вокальные звуки без обучения, вдохновляясь когнитивной наукой. Этот прорыв может привести к созданию более интуитивных интерфейсов звукового дизайна, реалистичных персонажей ИИ и инновационных методов изучения языка.

Deep Instinct предлагает DSX, передовое решение для кибербезопасности, использующее глубокое обучение и генеративный искусственный интеллект для защиты от вредоносных программ и программ-вымогателей в режиме реального времени. Инструмент DIANNA на базе Amazon Bedrock расширяет возможности SOC-команд, обеспечивая быстрый анализ известных и неизвестных угроз и решая ключевые задачи в условиях ра...

Профессор Джон Макдермид подчеркивает необходимость того, чтобы регулирующие органы имели возможность отзывать модели ИИ и оценивать опережающие индикаторы риска, чтобы снять опасения Джеффри Хинтона по поводу опасностей ИИ. Совместные исследования и разработка ИИ для обеспечения безопасности имеют решающее значение для снижения рисков, выходя за рамки тестирования «красных команд» после разра...