Вчені отримали Нобелівську премію за відкриття мікроРНК та створення нового білка. Штучний інтелект відзначений преміями з фізики та хімії.

Вплив ChatGPT на університети ставиться під сумнів, але штучний інтелект виявився корисним для вищої освіти. Університети впроваджують штучний інтелект, щоб покращити досвід студентів і співробітників.

Моделі синтезу відео зі штучним інтелектом, такі як Kling і video-01 від Kuaishou Technology та Minimax, розширюють межі, створюючи вірусне відео, яке змінює культуру мемів. Kling, перевершивши Sora, може генерувати високоякісні відео з текстових підказок, нерухомих зображень або існуючих відео, викликаючи суперечки та захоплення.

Деміс Хассабіс і Джон Джампер з DeepMind разом з Девідом Бейкером отримали Нобелівську премію за прогрес у вивченні структури білка. Їхня робота над ШІ-моделлю AlphaFold революціонізувала прогнозування структури білків.

Розвивайте навички ШІ, створюючи проекти. Почніть з ідей для вирішення проблем, таких як оптимізація резюме для заявок на роботу за допомогою бібліотек Python.

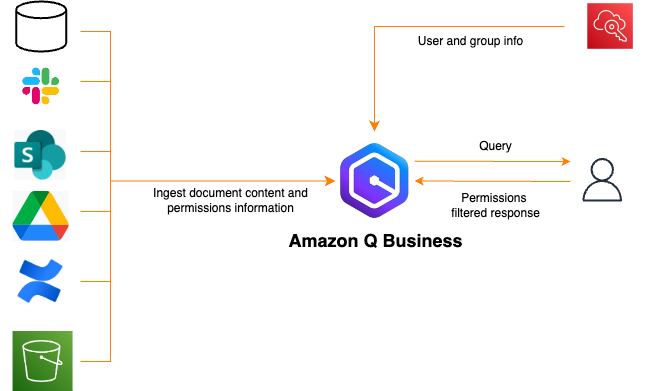

Amazon Q Business - це асистент зі штучним інтелектом, який має понад 40 роз'ємів, включно зі Slack, для підвищення продуктивності та обміну знаннями. Інтеграція зі Slack забезпечує швидкий і безпечний доступ до цінних знань організації завдяки можливостям генеративного ШІ.

Google Colab, інтегрований з інструментами генеративного ШІ, спрощує програмування на Python. Вивчайте Python легко і без встановлення завдяки доступним функціям Google Colab.

Асистент штучного інтелекту Meta, який викликав занепокоєння щодо конфіденційності, тепер є на сонцезахисних окулярах Ray-Ban Meta за 299 фунтів стерлінгів у Великій Британії. Асистент генерує текст і зображення на платформах соціальних мереж у Великій Британії та Бразилії.

Black Forest Labs представляє FLUX. 1 AI для генерації зображень, оптимізований для графічних процесорів GeForce RTX і NVIDIA RTX. FLUX. 1 вирізняється швидким відтворенням точної анатомії людини та розбірливого тексту всередині зображень, пропонуючи три варіанти для різних потреб користувачів.

Сер Деміс Хассабіс, керівник Google DeepMind і лауреат Нобелівської премії, підкреслює переваги ШІ, але попереджає про ризики. Колишній розробник підліткових ігор, автор популярної гри Theme Park.

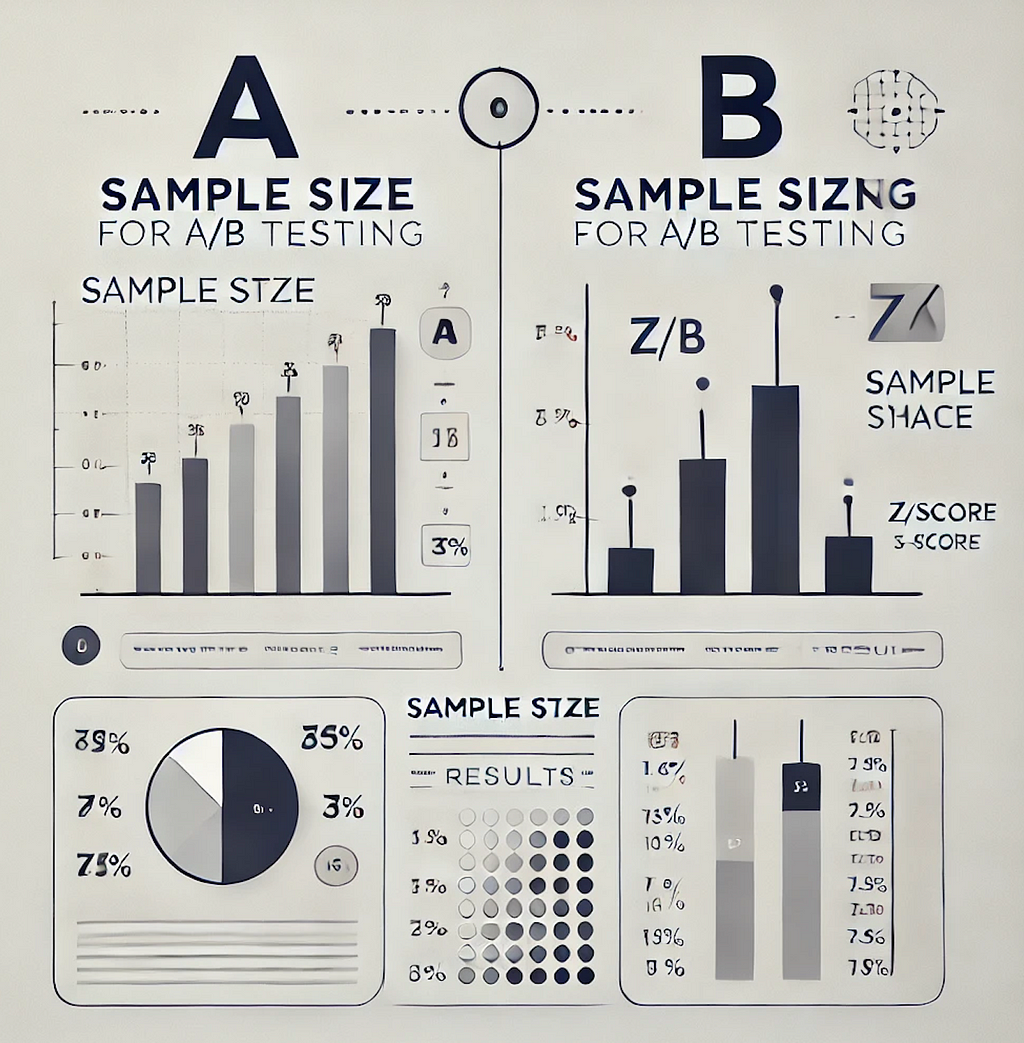

A/B-тестування vs. відкидання висновків: Вибір правильного розміру вибірки. Порівняння двох груп в A/B-тестуванні або вибір репрезентативної вибірки для відкидання висновків має вирішальне значення для отримання об'єктивних результатів. Розуміння метрик успіху, таких як пропорції або абсолютні цифри, є ключовим для точного експериментування.

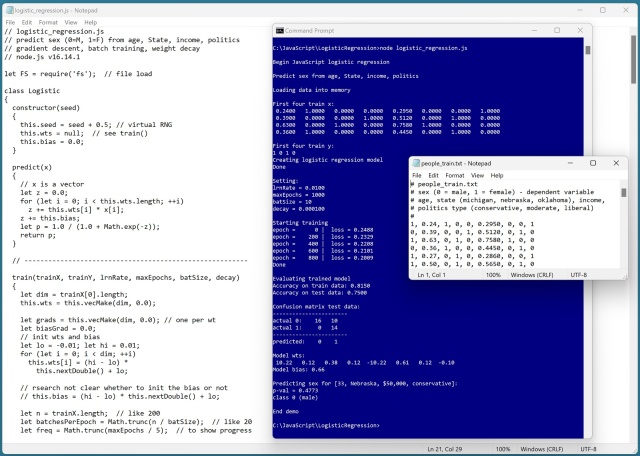

Реалізація логістичної регресії за допомогою JavaScript для прогнозування статі на основі віку, штату, доходу та політичних уподобань. Навчання з пакетним градієнтним спуском дає модель з точністю 75% на тестових даних.

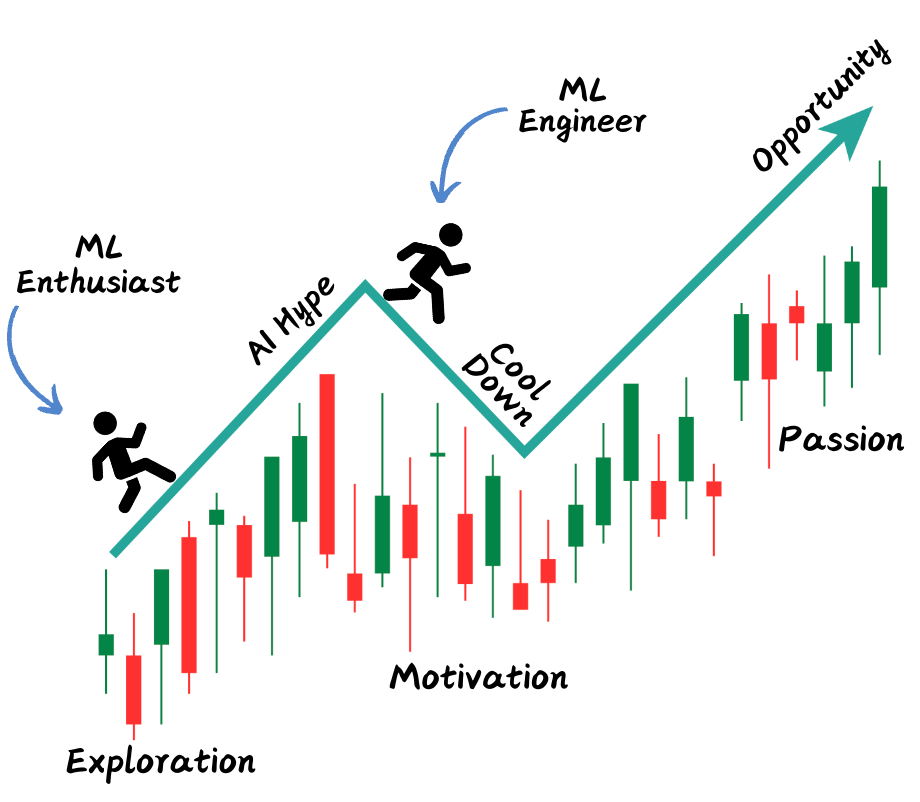

Перехід від інженера-програміста до інженера машинного навчання в компаніях FAANG включає 7 ключових кроків, серед яких пошук мотивації, вивчення основ ML, нетворкінг та пошук своєї ніші в ландшафті ML. Розуміння своїх інтересів та стратегічне використання поточних навичок є важливими для успішного переходу.

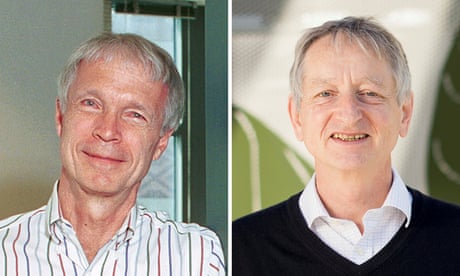

Джеффрі Хінтон і Джон Хопфілд отримали Нобелівську премію 2024 року за створення штучних нейронних мереж, натхненних роботою мозку. Їхня робота революціонізувала можливості штучного інтелекту завдяки функціям зберігання пам'яті та навчання, що імітують людське пізнання.

Дізнайтеся, як запускати Rust-код у браузері за допомогою WebAssembly, надаючи динамічним веб-сторінкам переваги конфіденційності. Дотримуйтесь дев'яти правил для перенесення коду на WASM у браузері, щоб забезпечити успішне впровадження та інтеграцію.