Python - це універсальна мова для проектів зі штучного інтелекту та науки про дані. Вивчіть основи Python для розробки ШІ за допомогою зручного для початківців посібника QuickStart. Програмування ШІ-проектів є дуже важливим, навіть з такими інструментами, як ChatGPT, що робить навчання легшим, ніж будь-коли.

Понад 4 000 митців закликають уряд запровадити податок на смартфони, щоб підтримати візуальне мистецтво на тлі скорочень. Сер Джон Акомфра, Дама Соня Бойс серед підписантів відкритого листа до Міністра культури.

Data Scientist ділиться інсайдами з реалізованих проектів, включаючи прогнозування використання сервісів за допомогою моделі Tabnet з налаштуванням гіперпараметрів за допомогою Optuna. Зосередьтеся на реальних прикладах для науковців-початківців та детальних інсайтах для досвідчених розробників.

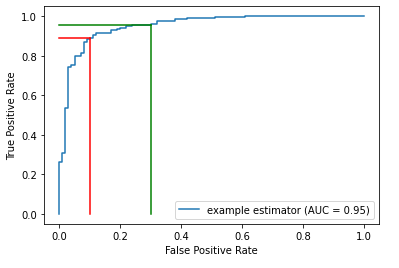

Інструмент на python під назвою ClassificationThesholdTuner автоматизує налаштування порогових значень для задач класифікації, забезпечуючи візуалізацію та підтримку багатокласової класифікації. Він спрощує процес і підвищує якість моделі, оптимізуючи вибір порогових значень.

Девід Покок попереджає про загрозу демократії з боку штучного інтелекту, створюючи фейкові відео з австралійськими політиками, які підтримують заборону реклами азартних ігор. Уряд розглядає можливість регулювання АІ за порадою Австралійської виборчої комісії.

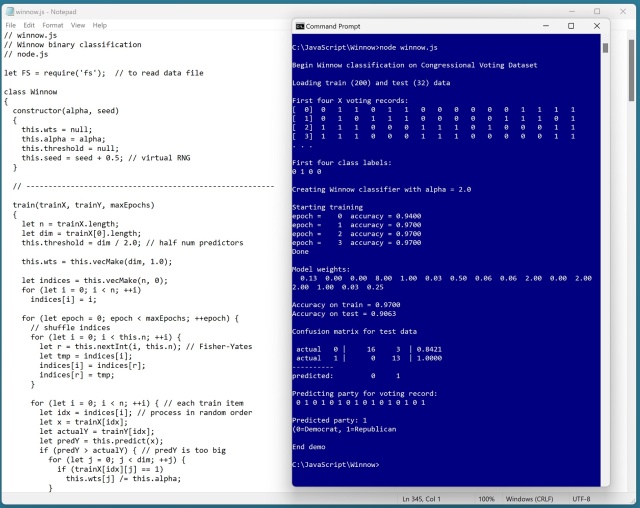

Реалізація бінарної класифікації Winnow за допомогою JavaScript на базі даних про результати голосування в Конгресі, досягнення високої точності та використання вагових коефіцієнтів для прогнозування. Класифікатор точно прогнозує політичну партію на основі даних про голосування, демонструючи ефективну бінарну класифікацію з чіткими пороговими критеріями.

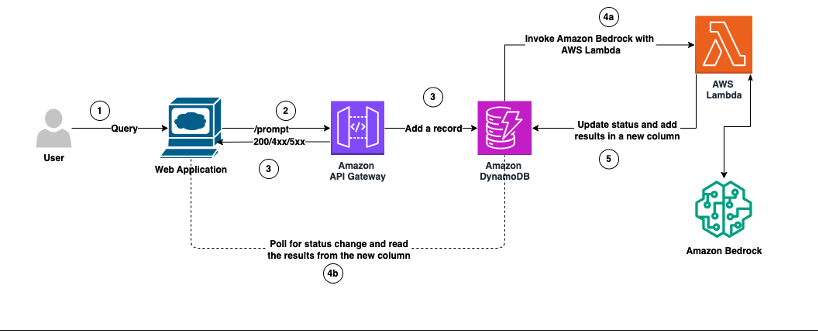

Генеративний ШІ покращує маркетинг за допомогою персоналізованого контенту та предиктивної аналітики. Vidmob співпрацює з AWS GenAIIC для аналізу креативних даних за допомогою Amazon Bedrock, революціонізуючи креативну аналітику.

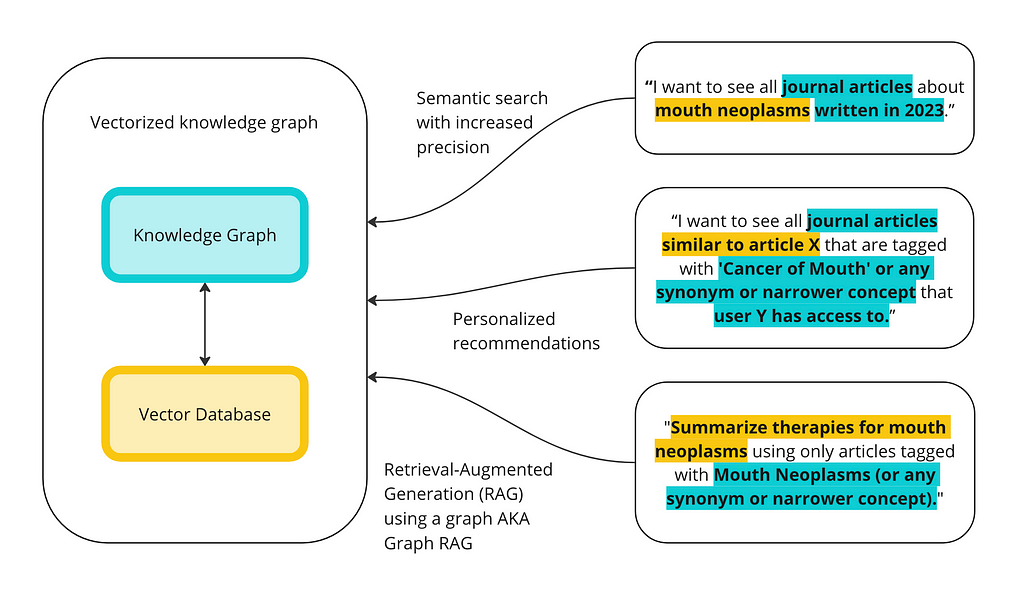

Впровадження Retrieval-Augmented Generation (RAG) з використанням графів знань покращує відповіді LLM. RAG з використанням KG поєднує в собі векторний пошук і методи підказки для поліпшення контекстного розуміння.

Китайські хмарні провайдери пропонують ШІ-чіпи Nvidia за ціною $6/год, що дешевше, ніж у США - $10/год, що свідчить про легкий доступ, незважаючи на експортні обмеження. Велика кількість поставок Nvidia в Китаї призводить до зниження витрат в обхід технологічних заходів США.

Шістьом громадянам Росії пред'явлено звинувачення у хакерських атаках на український уряд в інтересах Кремля. Змова включала знищення конфіденційних даних за допомогою шкідливого програмного забезпечення WhisperGate.

Лише 1 з 4 американських виборців довіряє собі розрізняти реальні та згенеровані штучним інтелектом зображення, що викликає занепокоєння обох партій щодо впливу штучного інтелекту на вибори. Дослідження Savanta свідчить про необхідність посилення регулювання синтетичних медіа в політиці.

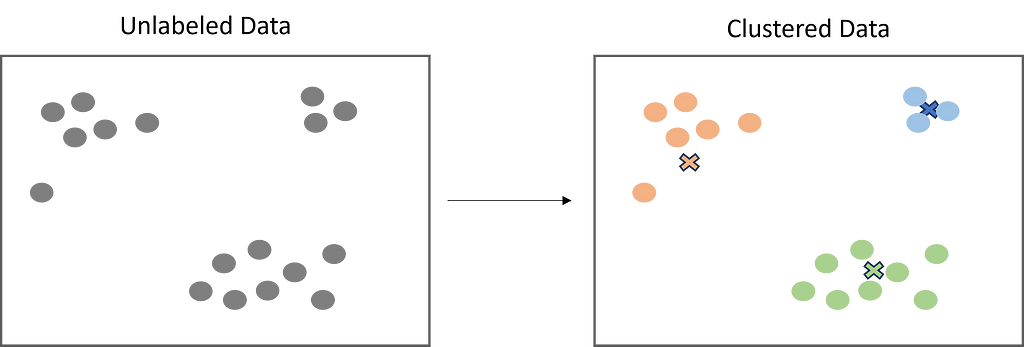

Кластеризація є життєво важливою для аналітиків даних, а популярні алгоритми, такі як K-середнє та K-середнє ++, покращують якість та виразність кластерів. Ці алгоритми групують точки даних на основі схожості, пропонуючи цінне застосування в сегментації ринку та рекомендаційних системах.

Музиканта Майкла Сміта звинувачують у шахрайстві на $10 млн за допомогою підроблених пісень, згенерованих штучним інтелектом, на Spotify, Apple Music, Amazon. Сміту загрожує до 20 років ув'язнення за шахрайство з банківськими рахунками, змову у відмиванні грошей за складною схемою.

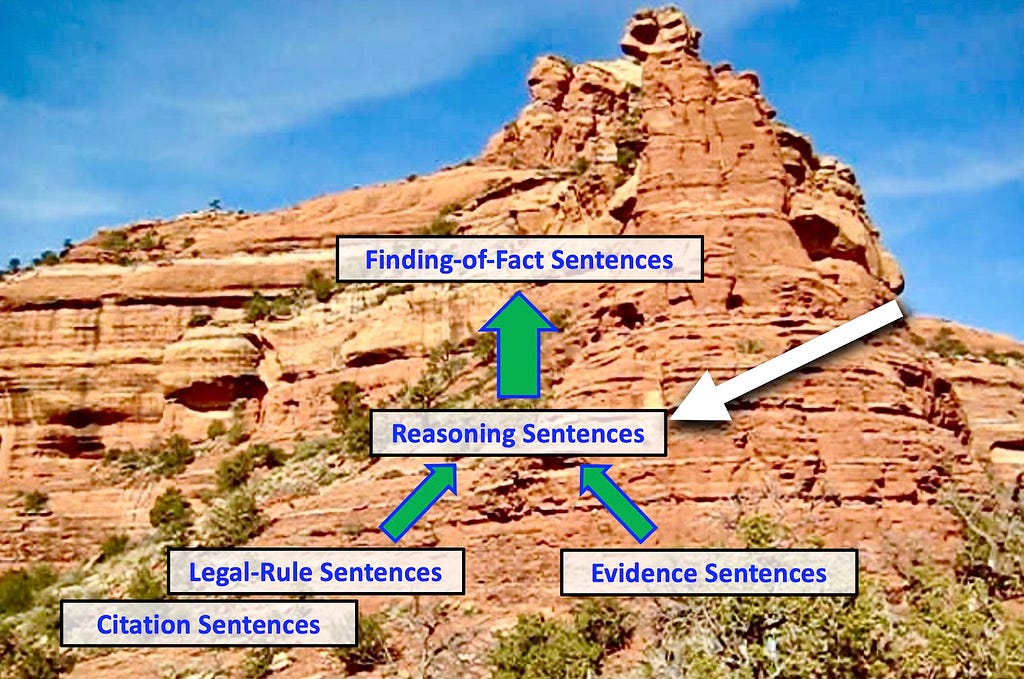

Судові трибунали використовують три етапи для оцінки доказів: доречність, достовірність і зважування конкуруючих доказів. Розуміння аргументації речень у судових рішеннях має вирішальне значення для моделей машинного навчання, які автоматично маркують їх, допомагаючи у вирішенні завдань з видобутку аргументів.

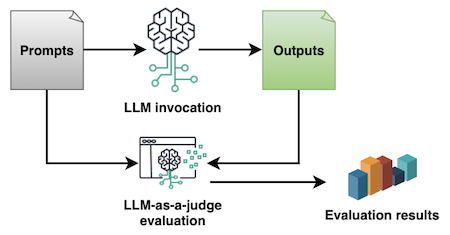

Оперативний інжиніринг має вирішальне значення для максимізації відповідей генеративних моделей ШІ. Впровадження автоматизованої оперативної оцінки за допомогою Amazon Bedrock може підвищити якість контенту, створеного штучним інтелектом, покращити користувацький досвід і підвищити економічну ефективність.