Короткий зміст: Дізнайтеся більше про захоплюючі мультфільми Фіони Катаускас у довгому списку.

Система штучного інтелекту ChatGPT стимулює творчість у письменників, яким бракує хисту, але може обмежити унікальні ідеї. Дослідники вважають, що штучний інтелект може допомогти авторам у створенні історій, потенційно змінюючи творчий процес.

Проривний DQN Мегаакорд "Веселка" поєднує в собі 6 потужних варіантів DQN для оптимальної продуктивності в глибокому навчанні з підкріпленням. Бібліотека Stoix розбиває компоненти Rainbow, включаючи алгоритм DQN та реалізацію нейронної мережі.

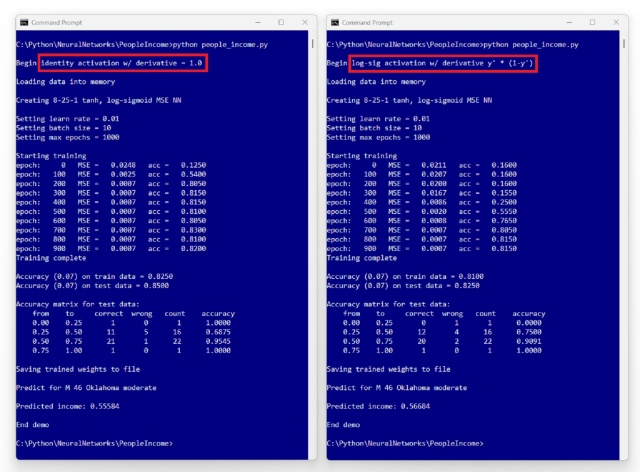

Нейромережеві регресійні моделі: Використовуйте logistic-sigmoid() для обмеженого виходу, identity() для необмеженого виходу. Ключ: член y' (1-y') у градієнті виходу.

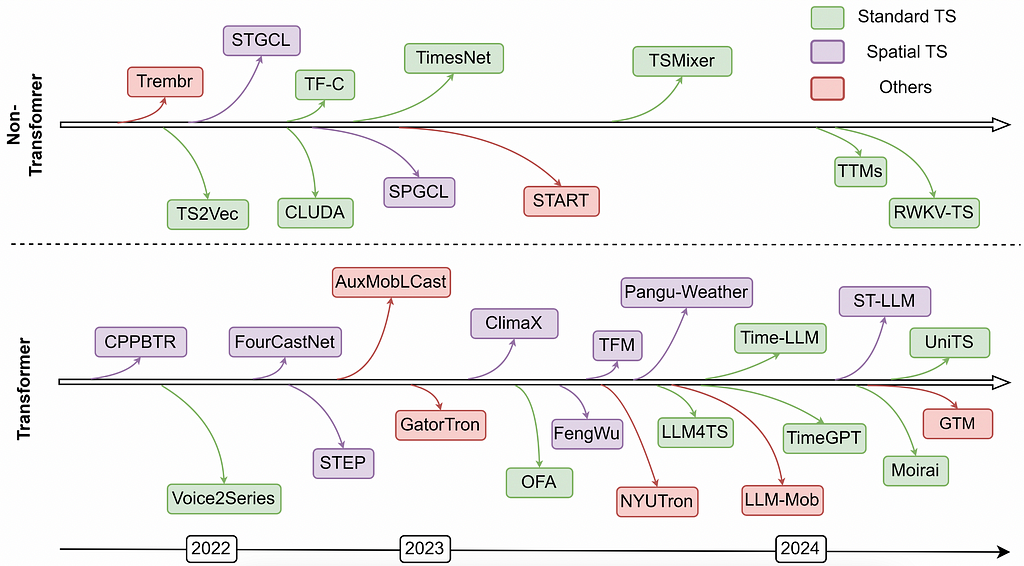

Фундаментальні моделі, такі як великі мовні моделі (LLM), адаптуються для моделювання часових рядів за допомогою великих фундаментальних моделей часових рядів (LTSM). Використовуючи подібність послідовних даних, LTSM має на меті навчатися на різноманітних даних часових рядів для таких завдань, як виявлення та класифікація викидів, спираючись на успіх LLM в обчислювальній лінгвістиці.

OpenAI запроваджує 5-рівневу систему для вимірювання прогресу на шляху до AGI, що викликає дискусії щодо доцільності та впливу. Генеральний директор Сем Альтман прогнозує, що AGI з'явиться протягом десятиліття, підкреслюючи потенційні соціальні потрясіння.

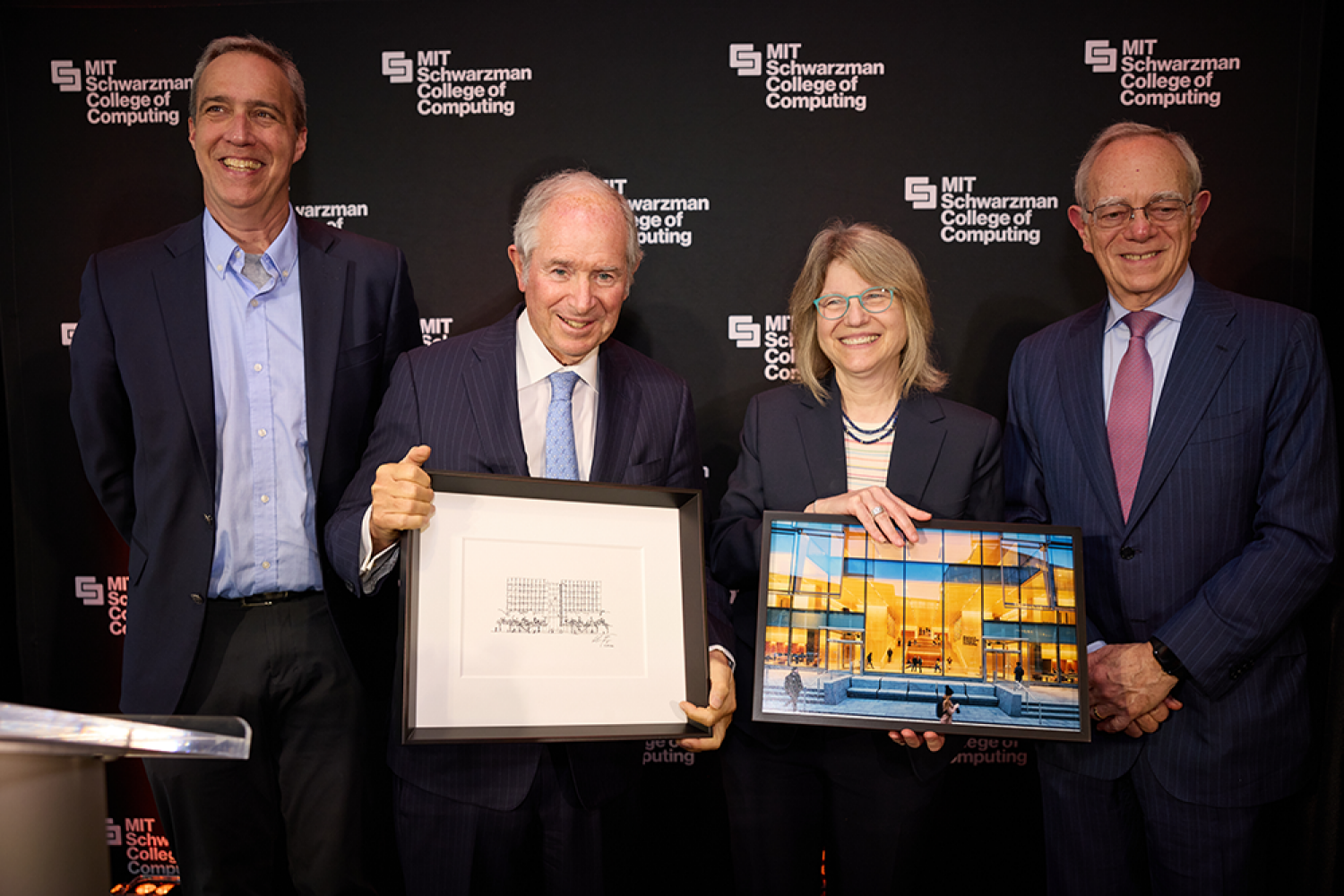

Комп'ютерний коледж ім. Стівена А. Шварцмана при Массачусетському технологічному інституті відкриває нову будівлю, сприяючи інноваціям та вирішенню глобальних проблем. Бачення Шварцмана щодо розвитку штучного інтелекту з урахуванням етичних міркувань призвело до трансформаційної співпраці з Массачусетським технологічним інститутом.

Щільність супутників на орбіті Землі зростає: у 2023 році буде запущено 2 877 супутників, що призведе до появи нових технологій глобального масштабу. Оголошено переможців премії MIT ARCLab за інновації в галузі штучного інтелекту в космосі, яка присвячена дослідженню моделей поведінки супутників із застосуванням штучного інтелекту.

Японське агентство AIST модернізує суперкомп'ютер ABCI 3.0 за допомогою графічних процесорів NVIDIA та мережі HPE для передових досліджень і розробок у галузі ШІ, зміцнюючи можливості ШІ та технологічну незалежність Японії. NVIDIA співпрацює з японською організацією METI у сфері досліджень та освіти в галузі ШІ, а генеральний директор Дженсен Хуанг (Jensen Huang) обіцяє підтримку генеративного...

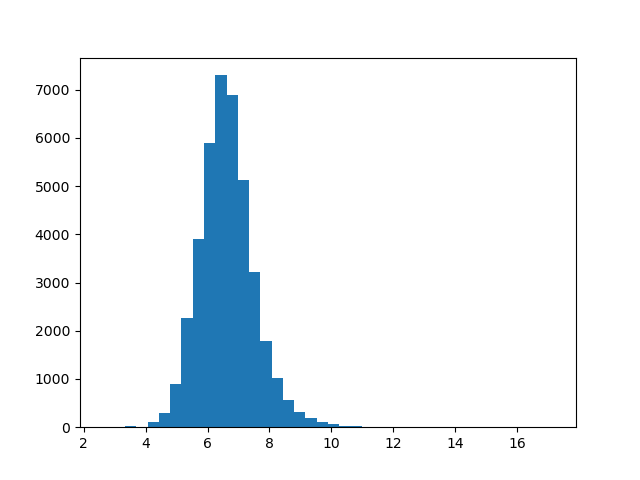

Вивчайте вставки слів GloVe за допомогою методів автоматизованого проектування, таких як кластеризація та PCA. Відкрийте для себе дивовижні упередження та ідеї в наборі даних.

Конкурс "Міс ШІ" від Fanvue коронує вигадану інстаграм-інфлюенсерку Кензу Лейлі, що викликало критику за об'єктивацію жінок у штучному інтелекті. Зростання кількості інфлюенсерів, створених штучним інтелектом, що підживлюється такими інструментами, як Stable Diffusion і Dreambooth, викликає етичні занепокоєння.

Генеральний директор Intuit оголосив про скорочення 10% працівників, планує найняти стільки ж для реструктуризації, орієнтованої на ШІ, і прогнозує трансформацію галузі. Компанія надає пріоритет інноваціям у сфері штучного інтелекту для підтримки клієнтів і стимулювання зростання, очікуючи, що загальна кількість співробітників зросте до 2025 року.

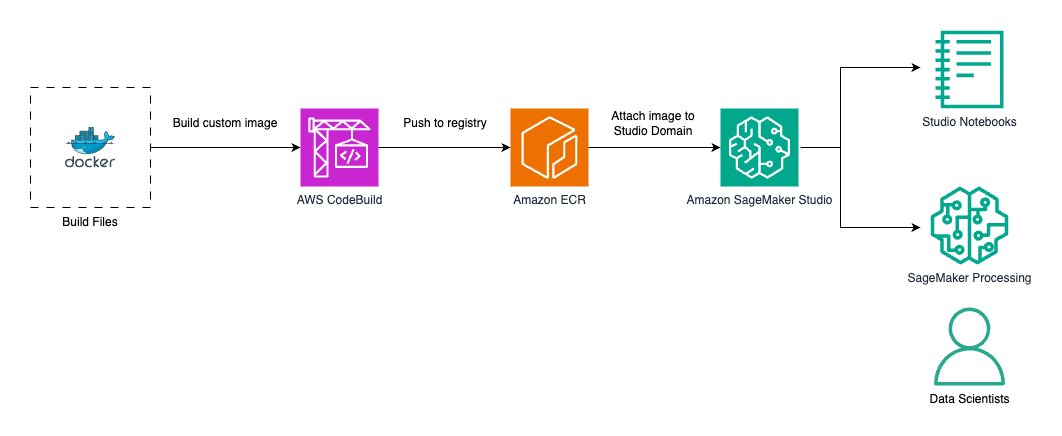

Amazon SageMaker Studio пропонує повністю керовані IDE для розробки ML, включаючи JupyterLab та RStudio. Вона дозволяє аналізувати геопросторові дані, розширюючи дистрибутив SageMaker власними зображеннями контейнерів.

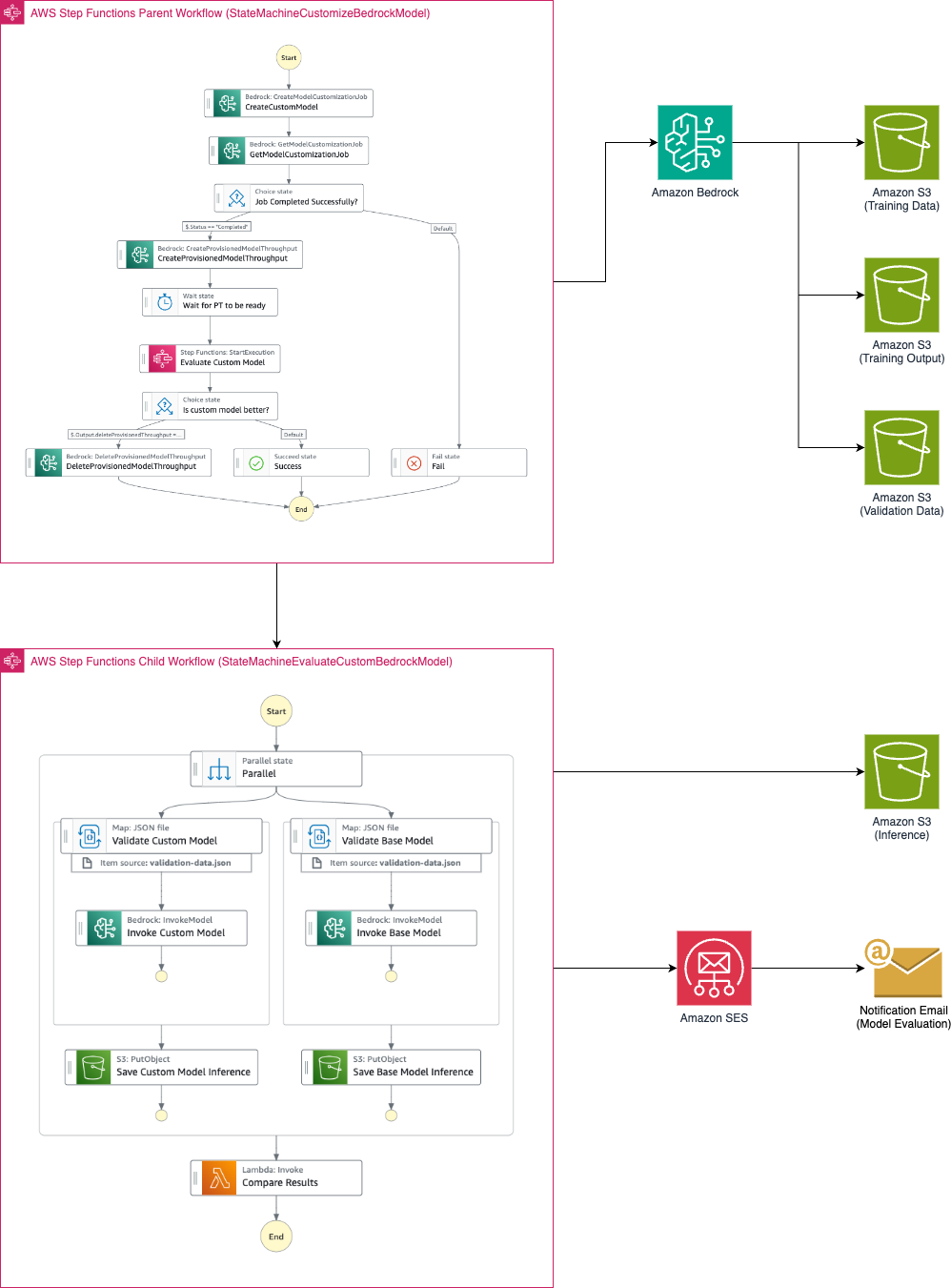

Amazon Bedrock пропонує настроювані великі мовні моделі від провідних компаній у галузі штучного інтелекту, таких як AI21 Labs і Meta, з функціями AWS Step Functions для автоматизованого налаштування моделей. Користувачі можуть адаптувати відповіді моделі до своїх унікальних бізнес-потреб, скорочуючи терміни розробки та максимізуючи цінність моделі.

Ультразвукова технологія на основі штучного інтелекту в Уганді дозволяє вагітним жінкам проходити обстеження без залучення спеціалістів, що сприяє ранньому зверненню за медичною допомогою та зменшенню кількості мертвонароджень. Цей інноваційний проєкт має на меті зробити основні медичні огляди більш доступними та покращити показники здоров'я матері та дитини.