LLMs.txt - це новий веб-стандарт, оптимізований для механізмів міркувань, який швидко поширюється завдяки підтримці Mintlify. Співзасновник Джеремі Говард запропонував LLMs.txt, щоб допомогти системам штучного інтелекту ефективніше розуміти вміст веб-сайтів.

Агентний ШІ поєднує в собі спеціалізованих агентів для розширення можливостей. Такі великі гравці, як Microsoft і Google, інвестують значні кошти в дослідження агентного ШІ.

Відомствам Уайтхолу бракує прозорості у використанні ШІ. Це викликає занепокоєння, оскільки штучний інтелект впливає на мільйони життів, прикладами чого є Міністерство праці та соціальної політики (DWP) та Міністерство внутрішніх справ (Home Office).

Сенат рекомендує окреме законодавство про ШІ та захист творчих працівників. Amazon, Google, Meta критикують за невизначеність щодо використання австралійських даних у навчанні ШІ.

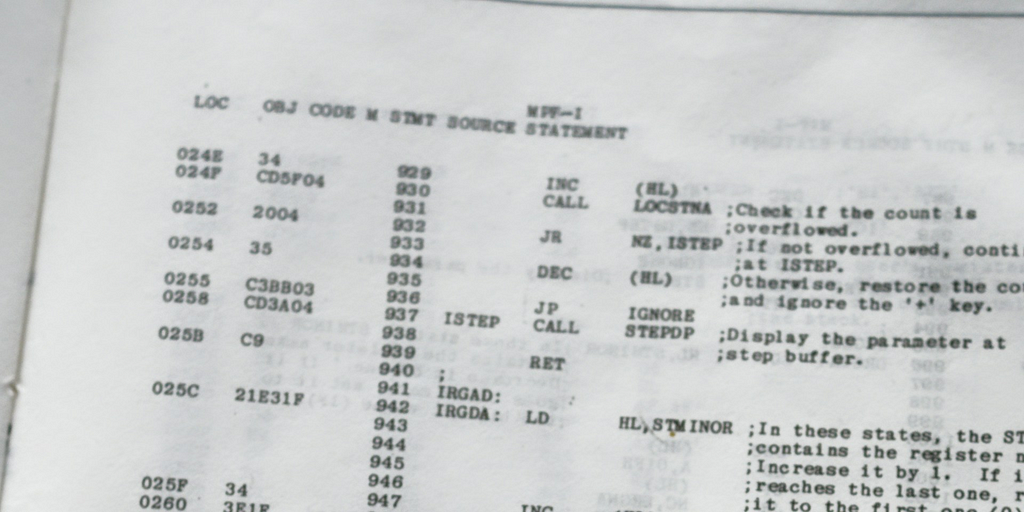

Межі квантування розширюються за допомогою ft-квантифікації, нового підходу до вирішення поточних обмежень алгоритмів. Ця техніка, що заощаджує пам'ять, стискає моделі та вектори для пошуку, популярна в LLM і векторних базах даних.

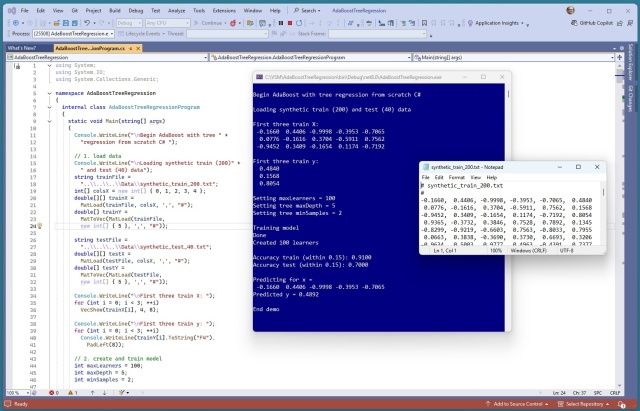

Реалізував регресію AdaBoost з нуля на C#, використовуючи k-найближчих сусідів замість дерев рішень. Дослідив оригінальний алгоритм AdaBoost. R2 Друкера, створивши унікальну реалізацію без рекурсії.

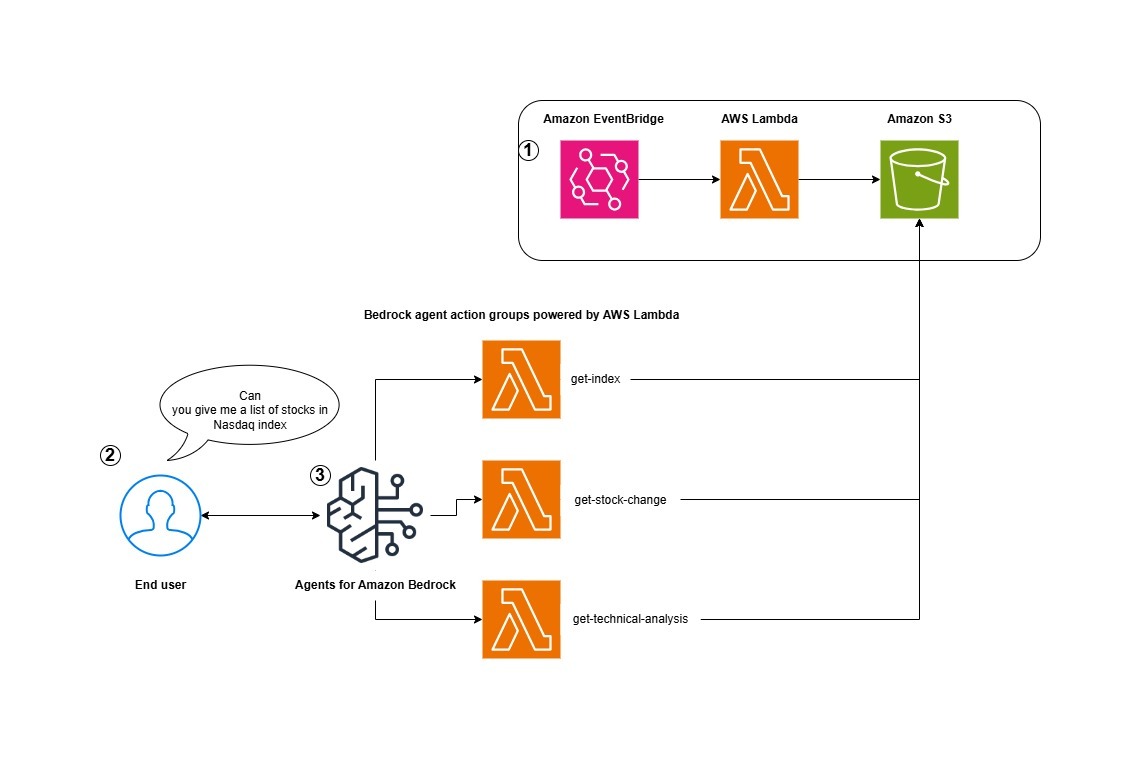

Технологія штучного інтелекту, така як Amazon Bedrock, дозволяє ефективно відповідати на складні запити технічного аналізу акцій, перетворюючи запити на природній мові на практичні дані за допомогою генеративних агентів штучного інтелекту. Завдяки Amazon Bedrock користувачі можуть безпечно створювати та масштабувати додатки штучного інтелекту, використовуючи високоефективні базові моделі від п...

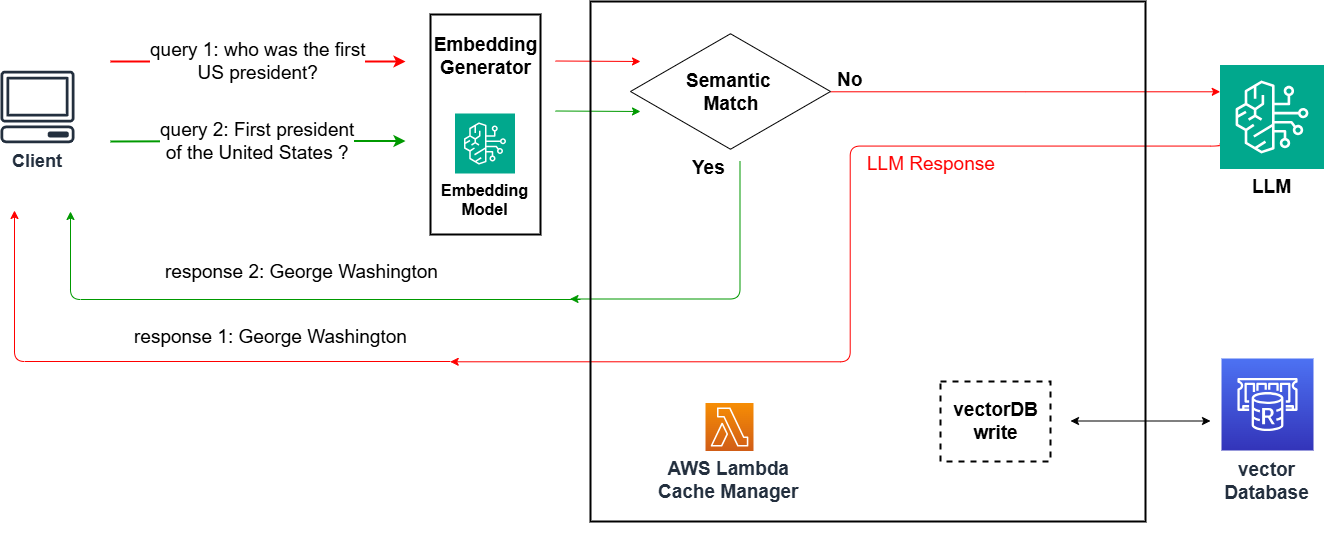

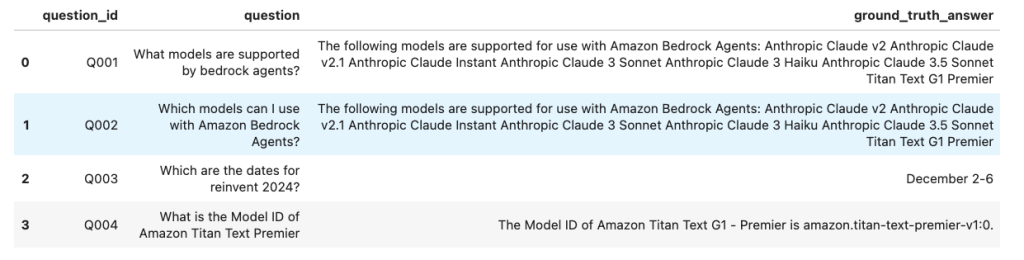

Оптимізація додатків на основі LLM за допомогою безсерверного кешування для ефективних рішень зі штучного інтелекту. Використання Amazon OpenSearch Serverless і Amazon Bedrock для збільшення часу відгуку за допомогою семантичного кешу для персоналізованих підказок і зменшення колізій кешу.

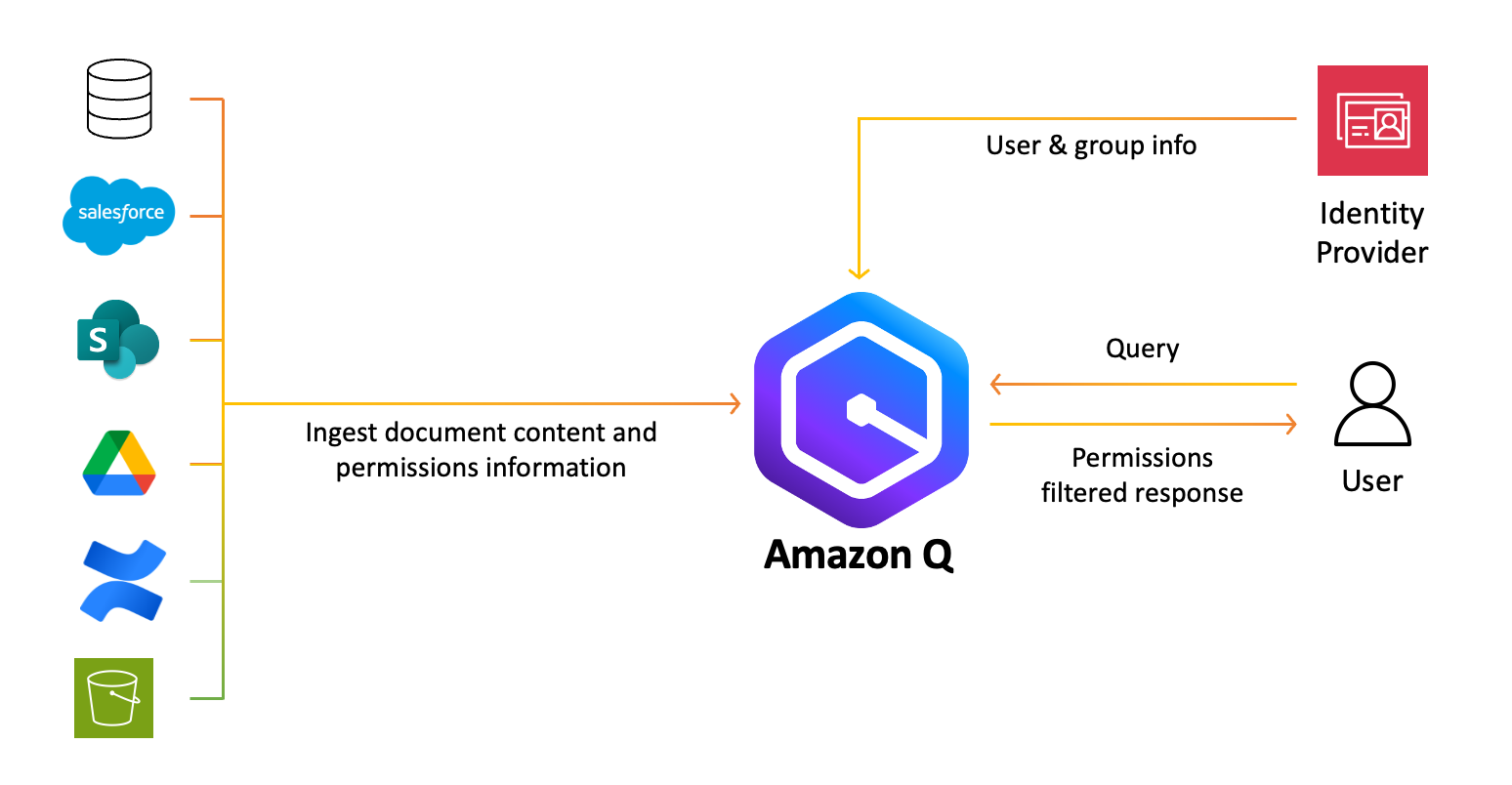

Salesforce централізує дані про клієнтів для отримання інсайтів. Amazon Q Business AI надає співробітникам можливість приймати рішення на основі даних і підвищувати продуктивність.

Флагманський продукт Rad AI, Rad AI Impressions, використовує LLM для автоматизації радіологічних звітів, заощаджуючи час і зменшуючи кількість помилок. Їхні ШІ-моделі генерують знімки для мільйонів досліджень щомісяця, приносячи користь тисячам радіологів по всій країні.

Стартап Spines зіткнувся з негативною реакцією через використання ШІ для редагування та розповсюдження книг за $1,200-5,000. Критики ставлять під сумнів якість і вплив на традиційне книговидання.

Галюцинації у великих мовних моделях (LLM) створюють ризики у виробничих додатках, але такі стратегії, як RAG і Amazon Bedrock Guardrails, можуть підвищити фактичну точність і надійність. Агенти Amazon Bedrock пропонують динамічне виявлення галюцинацій для настроюваних, адаптованих робочих процесів без реструктуризації всього процесу.

Нейроморфні обчислення переосмислюють апаратне забезпечення та алгоритми ШІ, натхненні мозком, щоб зменшити споживання енергії та вивести ШІ на новий рівень. Угода OpenAI з Rain AI на суму 51 мільйон доларів за нейроморфні чіпи свідчить про перехід до більш екологічного ШІ в центрах обробки даних.

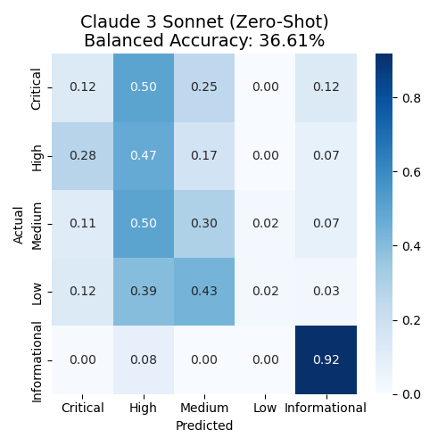

Sophos використовує ШІ та ML для захисту від кіберзагроз, налаштовуючи LLM для кібербезпеки. Amazon Bedrock підвищує продуктивність SOC за допомогою рішення Claude 3 Sonnet від Anthropic, що дозволяє боротися з втомою від постійних сповіщень.

Інтеграція Datadog з AWS Neuron оптимізує робочі навантаження ML на екземпляри Trainium та Inferentia, забезпечуючи високу продуктивність та моніторинг у реальному часі. Інтеграція з Neuron SDK забезпечує глибоке спостереження за виконанням моделі, затримками та використанням ресурсів, що сприяє ефективному навчанню та висновкам.