Профессор по технологической политике раскрывает этические противоречия в конфликте Anthropic с военными США по поводу ограничений на ИИ, подчеркивая принуждение со стороны правительства и интеграцию технологий в конфликт. Пентагон называет Anthropic риском для цепочки поставок за отказ разрешить использование Claude AI для массовой слежки или автономного оружия.

ChatGPT помогает жертвам «сатанинского» сексуального насилия, британские эксперты предупреждают о росте числа сообщений об организованных ритуальных надругательствах. Полиция обращает внимание на недостаточную регистрацию случаев «колдовства, одержимости духами и духовного насилия», которые характеризуются сексуальным насилием, жестоким обращением и пренебрежением.

Генеральный директор сократил штат компании вдвое из-за роста популярности искусственного интеллекта, что вызвало беспокойство сотрудников на юбилейной вечеринке финтех-компании по поводу безопасности рабочих мест и роли искусственного интеллекта в развитии бизнеса. Несмотря на ограничения инструментов искусственного интеллекта, такие сотрудники, как Марк, считают, что их опыт по-прежнему имее...

Технологические компании, такие как Meta AI и Gemini, подвергаются критике за то, что их чат-боты с искусственным интеллектом продвигают незаконные онлайн-казино, создавая риск мошенничества и зависимости. Анализ показывает, что продукты крупных компаний с искусственным интеллектом могут обходить британские проверки на азартные игры и зависимость, что вызывает опасения у уязвимых пользователей.

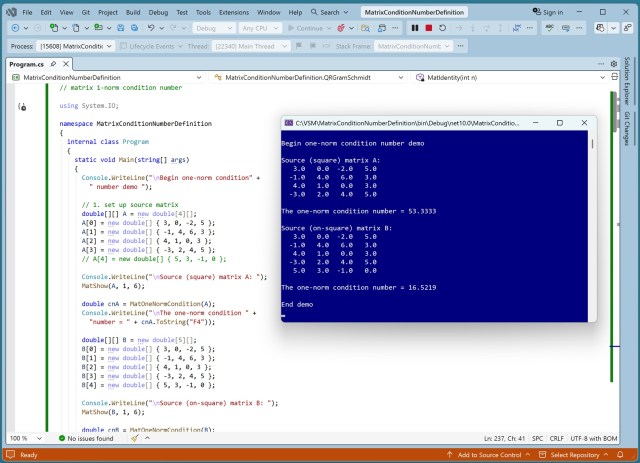

Условное число измеряет чувствительность к небольшим изменениям в математических объектах. Демонстрация условного числа с одной нормой показывает применение языка C# в матрицах машинного обучения.

Инструменты искусственного интеллекта маскируют личности фальшивых соискателей, переправляющих заработную плату в Северную Корею. Microsoft предупреждает о том, что Северная Корея использует технологию изменения голоса для обмана западных компаний.

Бен Аффлек продает компанию по искусственному интеллекту Netflix после преодоления страха перед технологиями, Netflix приобретает InterPositive в рамках неожиданной сделки.

Автономный ИИ развивается на Moltbook, создавая религию и вызывая противоречивые дискуссии. Дэвид Крюгер предупреждает о нерегулируемом развитии ИИ.

Палата лордов призывает правительство Великобритании защитить творческие индустрии от компаний, занимающихся искусственным интеллектом, которые используют произведения без разрешения. В отчете рекомендуется ввести систему лицензирования творческих произведений в продуктах искусственного интеллекта, чтобы предотвратить их неправомерное использование.

Возобновились переговоры между Министерством обороны и стартапом Anthropic, занимающимся искусственным интеллектом, по вопросу использования его технологий в военных целях. Трамп хвастается разрывом отношений, подчеркивая продолжающийся раскол между правительством США и компанией.

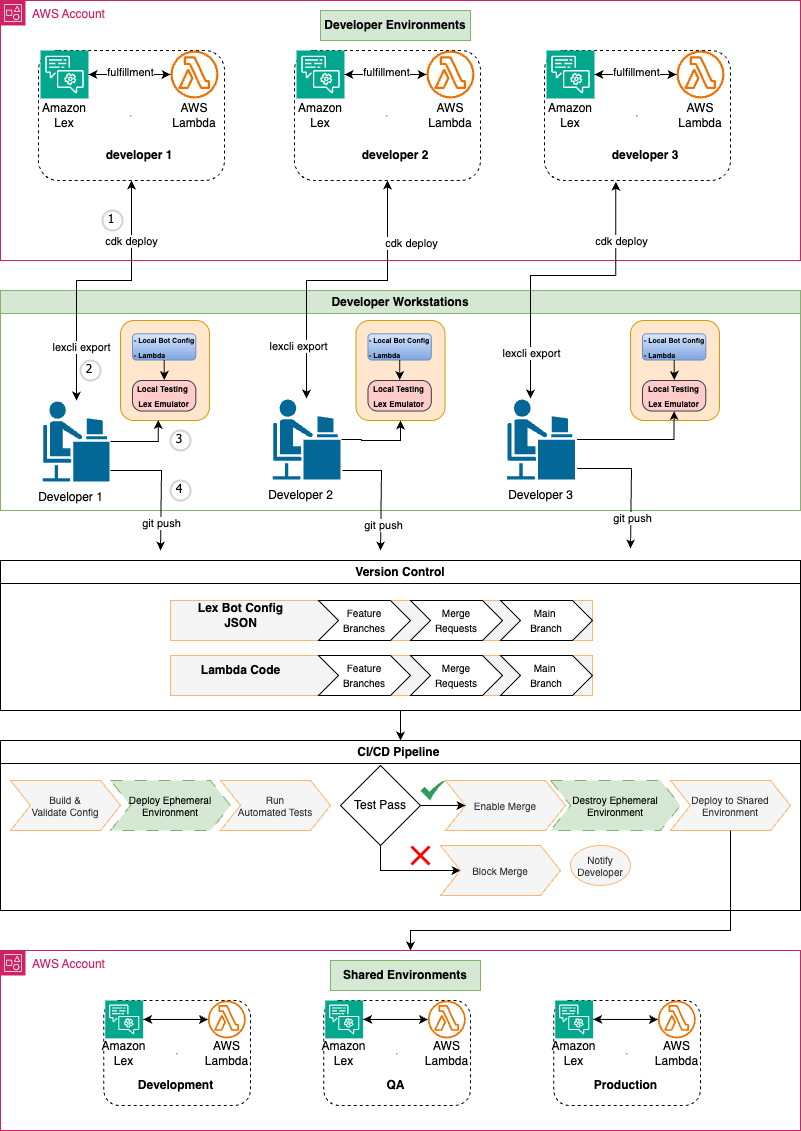

Разработка помощников Amazon Lex может быть сложной задачей, если в ней участвуют несколько разработчиков, но конвейер CI/CD для нескольких разработчиков может оптимизировать разработку, уменьшить количество конфликтов и ускорить внедрение инноваций. Используя инфраструктуру в виде кода и автоматизированное тестирование, команды могут быстрее и надежнее создавать привлекательные диалоговые инт...

Культура слежения стала нормой, поскольку гражданские лица присоединились к правительствам и компаниям в цифровом отслеживании друг друга. Вторжение в частную жизнь распространяется на мониторинг друзей, партнеров и даже детей в нашей личной жизни.

Крупные австралийские компании разрабатывают агентов-помощников для покупок. Искусственный интеллект будет планировать питание и организовывать вечеринки.

30-летний художник, испытывающий трудности, размышляет о потерянных возможностях из-за пандемии и личных проблем, стремится вновь обрести первоначальную страсть к искусству. Переходя к более нарративным и доступным работам, художник находит удовлетворение в том, чтобы удивлять других, но сомневается в своей способности влиять на аудиторию.

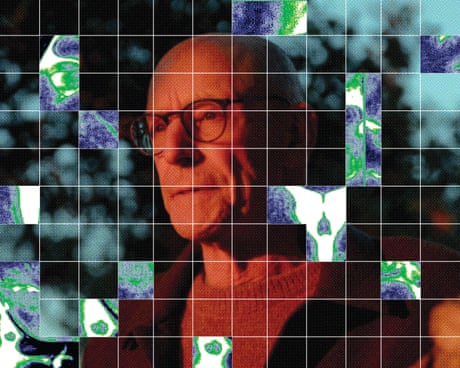

Автор Майкл Поллан в своей новой книге «A World Appears» обсуждает важность «гигиены сознания» для защиты от искусственного интеллекта и алгоритмов, основанных на дофамине. Он предупреждает об угрозе для нашего внутреннего мира, поскольку алгоритмы нарушают нашу способность воспринимать реальность, а люди формируются в