Технічний директор Meta Ендрю Босворт (Andrew Bosworth) приєднується до армії США разом з компаніями Palantir та OpenAI, об'єднуючи технологічний та військовий досвід. Босворт, відомий як «Боз», має честь стати частиною загону 201, який об'єднує провідних технологічних фахівців у військові інновації.

Проєкт LOBSTgER Морського гранту Массачусетського технологічного інституту використовує штучний інтелект і підводну фотографію для документування та поширення інформації про вразливе життя океану в Менській затоці. Ініціатива поєднує мистецтво, науку та технології, щоб поглибити зв'язок громадськості зі світом природи за допомогою інноваційного візуального сторітелінгу.

Нещодавні випускники британських університетів стикаються з найскладнішим ринком праці з 2018 року: кількість оголошених вакансій скоротилася на 33% порівняно з минулим роком. Роботодавці використовують штучний інтелект для скорочення витрат, що призводить до найнижчого рівня можливостей працевлаштування для випускників за останні сім років.

Американський суддя вирішив, що Anthropic справедливо використовував книги для навчання ШІ, але зберігання піратських книг у бібліотеці порушувало авторські права. Магістр Клод з Anthropic навчався на творах авторів без дозволу.

MIT Generative AI Impact Consortium (MGAIC) отримав 180 заявок, фінансує інноваційні проекти зі штучного інтелекту в Массачусетському технологічному інституті (MIT). Серед основних тем презентації - репетитори, керовані штучним інтелектом, та музична співпраця між людиною та штучним інтелектом у реальному часі.

BBC погрожує судовим позовом проти Perplexity AI за вилучення контенту для навчання АІ-моделі. Perplexity AI звинувачують у використанні контенту BBC без дозволу.

Метт Кліффорд, автор плану дій уряду Великої Британії з розвитку штучного інтелекту, йде у відставку з особистих причин. Цар ШІ Кейр Стармер пішов у відставку після 6 місяців на посаді.

Навчання з підкріпленням налаштовує ШІ-системи зі зворотним зв'язком з людиною, борючись з галюцинаціями. МакКафрі попереджає про ризики упередженості в системах з людським зворотним зв'язком.

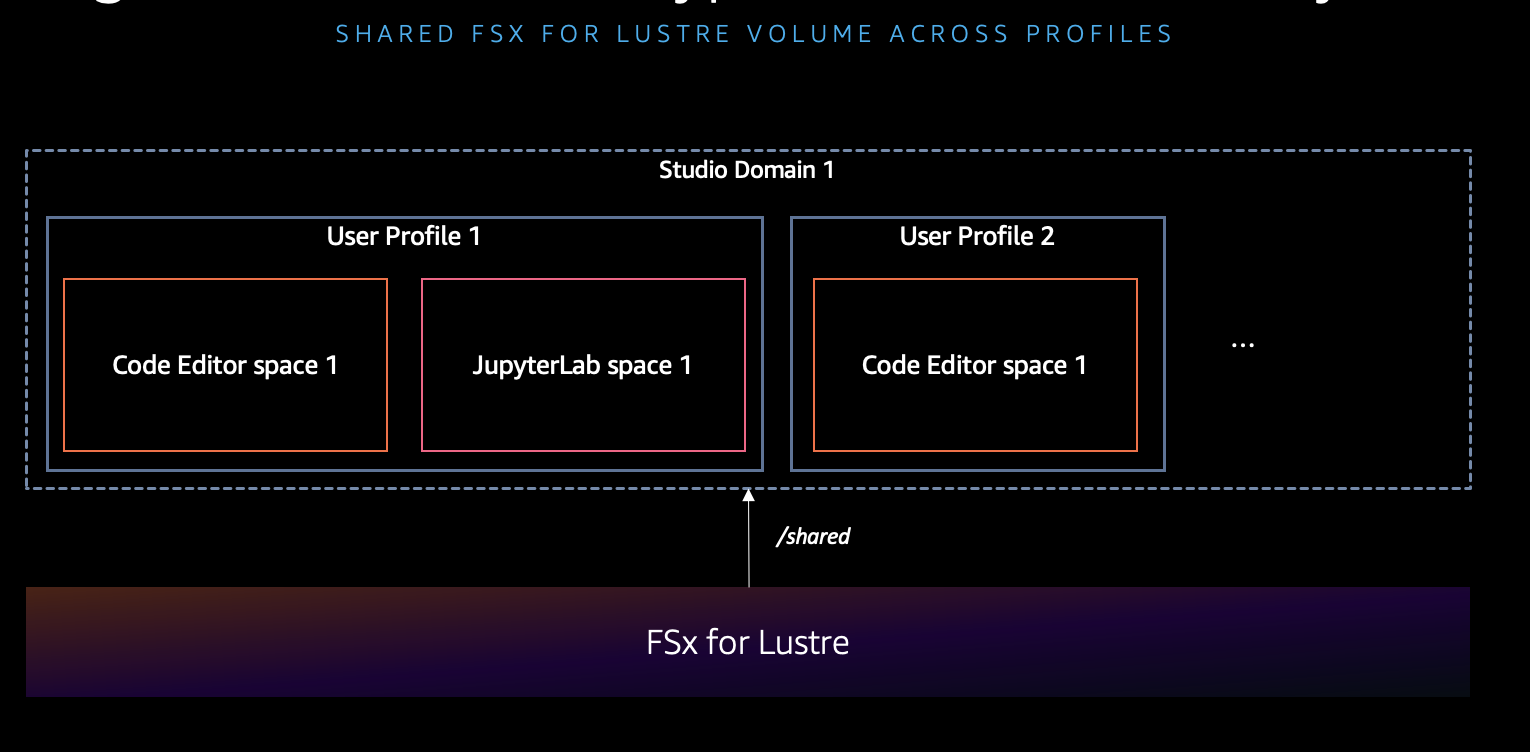

Генеративні моделі ШІ потребують величезних обчислювальних масштабів для попереднього навчання. Amazon SageMaker HyperPod пропонує відмовостійке рішення для великомасштабного навчання ШІ, автоматизуючи ремонт екземплярів з мінімальними перебоями.

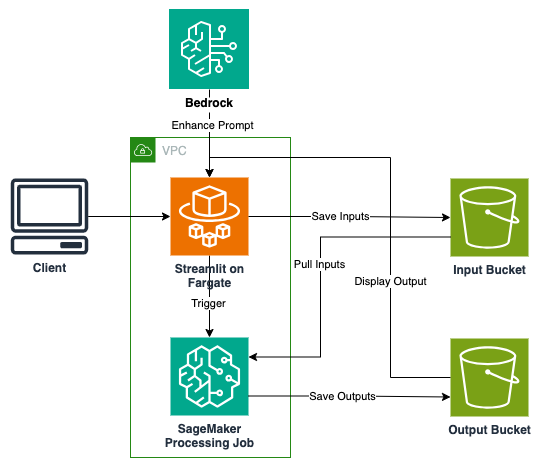

Технологічні досягнення AI/ML революціонізують створення цифрового контенту завдяки можливостям генерації відео. Рішення на базі AWS з використанням моделі CogVideoX трансформує бізнес за допомогою масштабованої, безпечної генерації відео.

Студентський портал AWS DeepRacer переходить на рішення AWS до 15 вересня 2025 року, пропонуючи еволюцію освіти в галузі штучного інтелекту та машинного навчання. Удосконалена програма AWS AI & ML Scholars тепер зосереджена на генеративному ШІ, готуючи студентів до кар'єри в галузі ШІ.

Журналісти австралійських видань Руперта Мердока висловлюють занепокоєння щодо внутрішнього інструменту штучного інтелекту NewsGPT. Інструмент дозволяє авторам використовувати різні стилі, підвищуючи креативність на робочому місці.

Генеральний директор Amazon Ендрю Джасі попереджає білих комірців, що технологія штучного інтелекту може замінити робочі місця в найближчому майбутньому. Очікується, що ШІ-агенти та генеративні ШІ-системи, такі як чат-боти, зменшать потребу в працівниках на певних посадах.

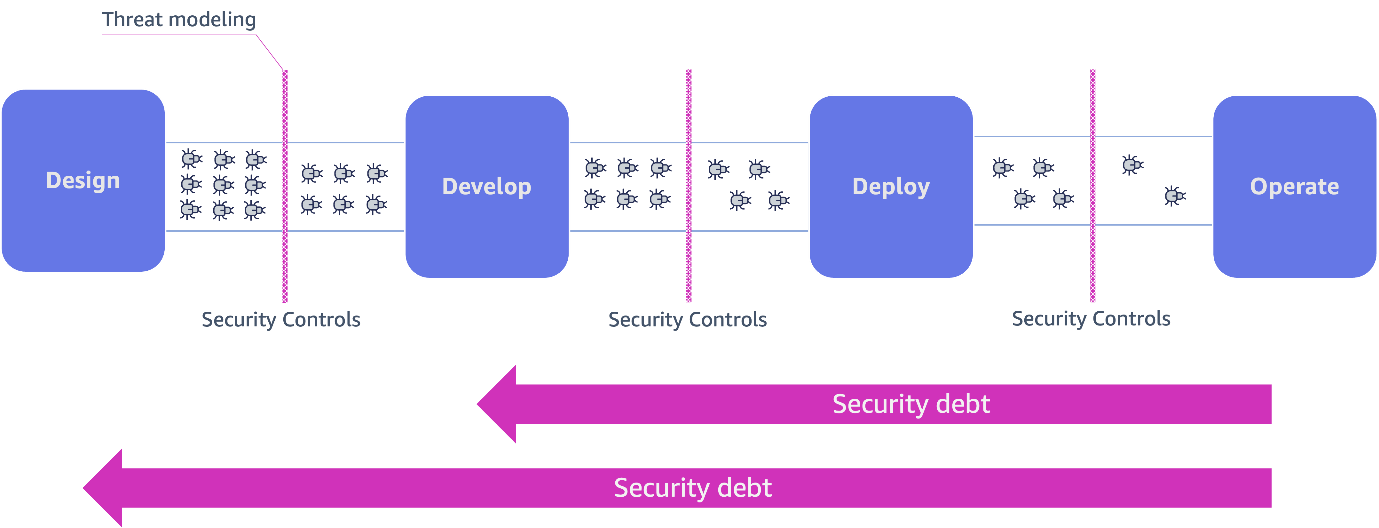

Генеративний ШІ трансформує моделювання загроз, автоматизуючи виявлення вразливостей, генеруючи сценарії атак і пропонуючи контекстні стратегії пом'якшення наслідків. На відміну від традиційних методів, моделі ШІ здатні розуміти складні системні взаємозв'язки, міркувати про нові вектори атак і адаптуватися до унікальних архітектурних патернів, що робить автоматизоване моделювання загроз практи...

Асистент штучного інтелекту Meta підвів користувача, який намагався зателефонувати на гарячу лінію залізничної компанії, надавши неправильний номер, що призвело до незручної ситуації. Незважаючи на похвалу генерального директора Марка Цукерберга, ця помилка чат-бота підкреслює обмеженість його інтелекту.