Експерти з штучного інтелекту з Массачусетського технологічного інституту (MIT) обговорюють вплив штучного інтелекту на суспільство, закликаючи перейти до цілеспрямованих моделей ШІ меншого масштабу. Журналістка Карен Хао наголошує на необхідності етичного розвитку ШІ, звертаючи увагу на людські та екологічні витрати, пов’язані з нинішніми практиками у сфері ШІ.

Колишній співробітник компанії в Сіднеї відзначає корисність штучного інтелекту, але наголошує, що він не може замінити людей. Звільнений співробітник Atlassian прагне розібратися в ситуації після того, як його звільнили без пояснень.

MIT та HPI запускають Центр штучного інтелекту та творчості з метою поглиблення співпраці у сферах штучного інтелекту та дизайну, формуючи майбутнє інновацій. Ця ініціатива спрямована на розвиток міждисциплінарних досліджень, освітніх програм та залучення викладачів на стику людської творчості та штучного інтелекту.

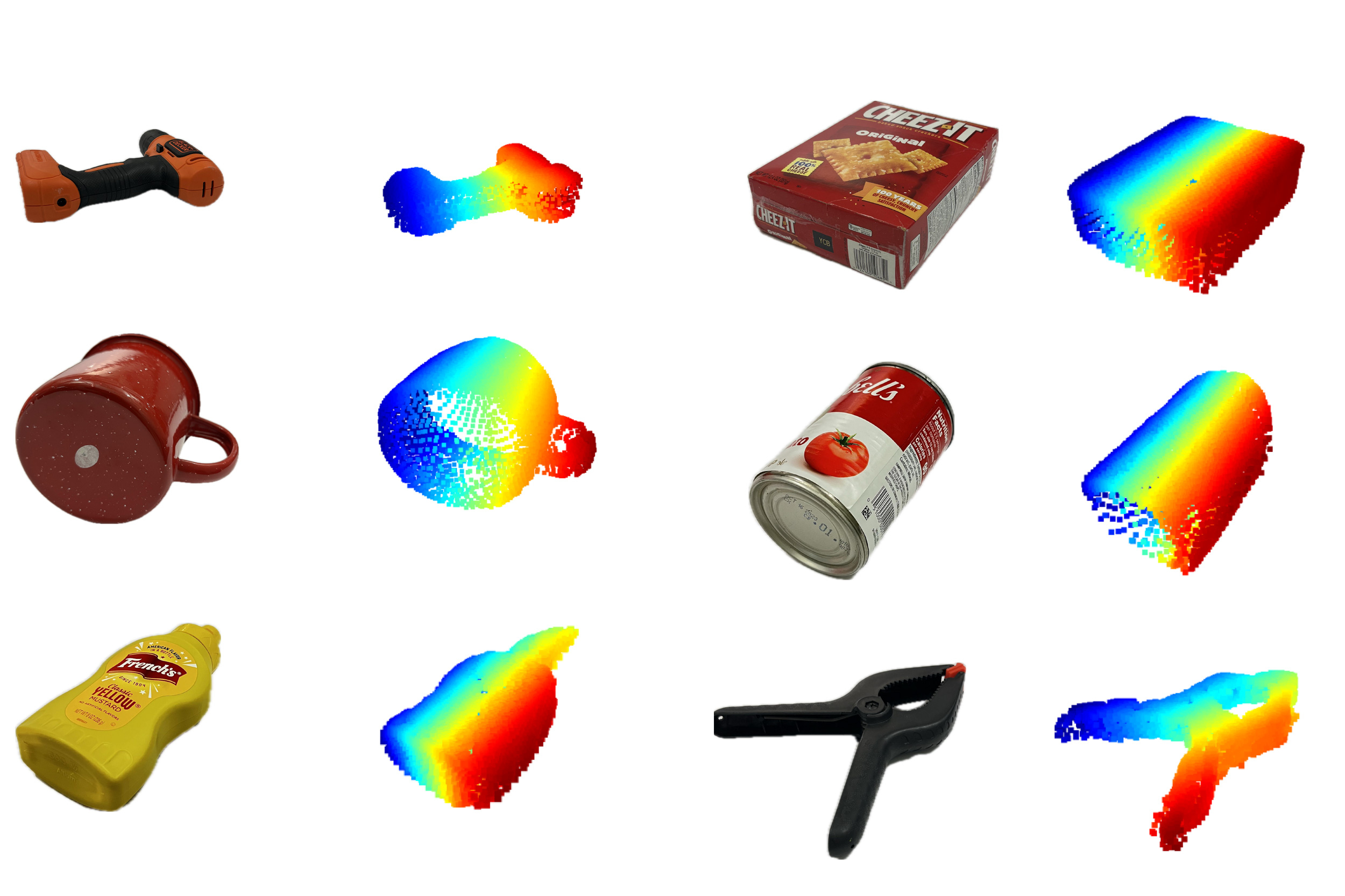

Дослідники з Массачусетського технологічного інституту використовують генеративні моделі штучного інтелекту для вдосконалення здатності роботів знаходити приховані об’єкти за допомогою бездротових сигналів. Ця нова технологія дозволяє відтворювати приховані об’єкти та цілі кімнати, що відкриває можливості для застосування у роботах на складах та у «розумних» будинках.

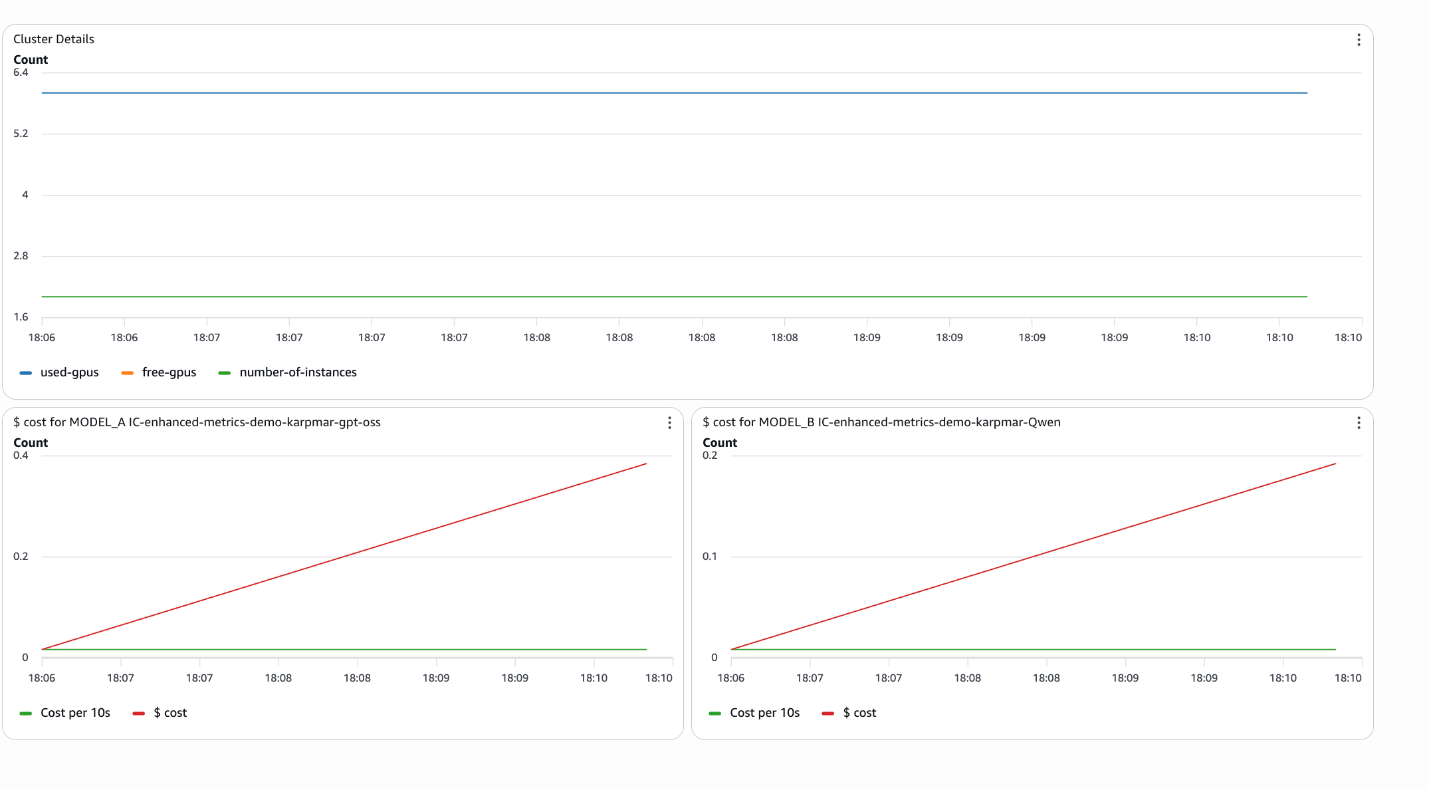

Amazon SageMaker AI тепер пропонує розширені показники, що забезпечують детальний огляд виробничих кінцевих точок, включаючи інформацію про окремі екземпляри та контейнери. Це дозволяє користувачам відстежувати показники конкретних копій моделей та розраховувати вартість на одну модель, що сприяє покращенню процесу усунення несправностей та ефективнішому використанню ресурсів.

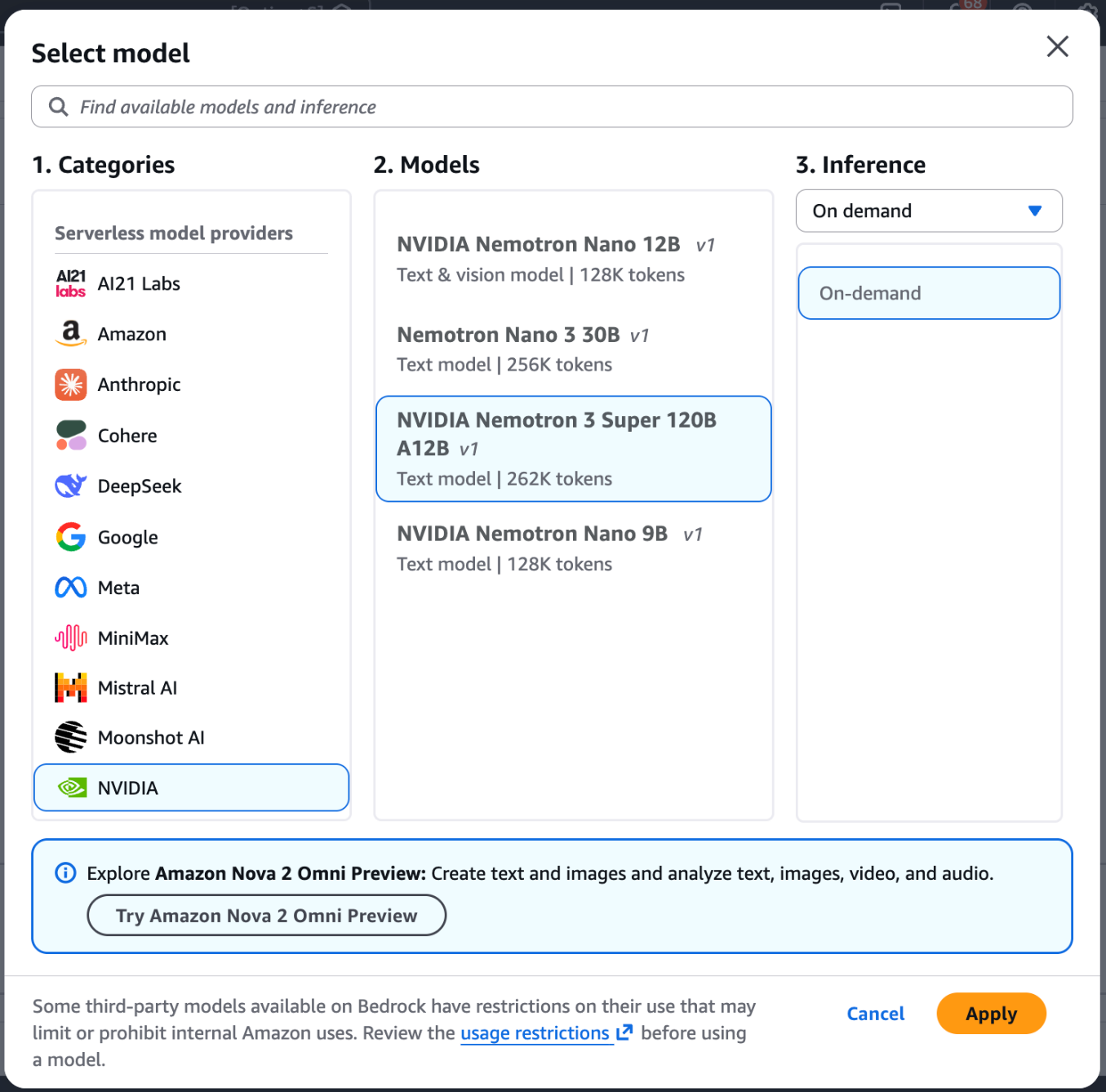

NVIDIA Nemotron 3 Super, доступна на Amazon Bedrock, забезпечує найвищу ефективність і точність для додатків на основі генеративної штучного інтелекту. Модель має гібридну архітектуру MoE та підтримує прогнозування з кількома токенами, що забезпечує підвищену продуктивність при виконанні завдань логічного міркування.

У статті VSM «Регресія методом випадкового лісу на C#» пояснюється, як система на основі методу випадкового лісу може підвищити точність прогнозування завдяки навчанню на різних підмножинах даних. У демонстраційному прикладі показано цей процес, підкреслюючи точність системи та її потенціал для прогнозування складних структур у синтетичних даних.

Генеральний директор PricewaterhouseCoopers застерігає, що керівний склад повинен прийняти штучний інтелект, інакше його замінять. Гріггс наголошує на важливості того, щоб у консалтинговій фірмі «бути параноїдально налаштованими на пріоритет штучного інтелекту».

Мексиканська молодь у TikTok використовує штучний інтелект, щоб зобразити агентів DFS 1970-х років, що викликало дискусію щодо героїзації корупції та безкарності. Цей тренд перетворює користувачів на агентів, відомих тортурами, вбивствами та зникненнями людей під час «брудної війни» в Мексиці.

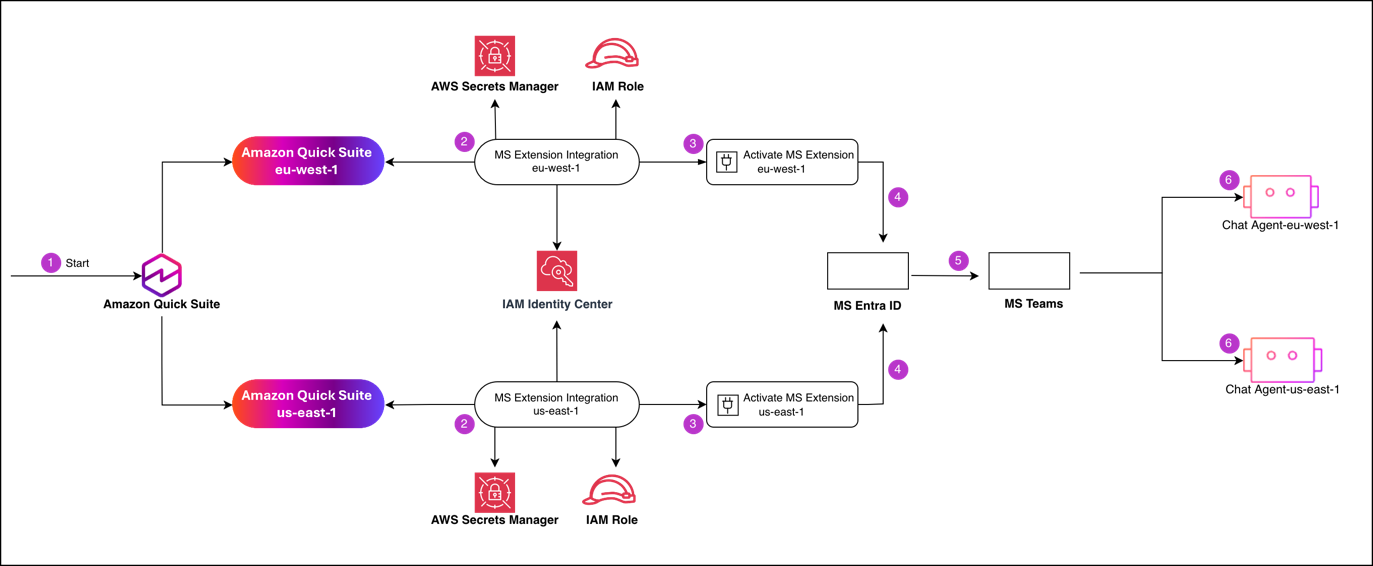

Amazon Quick з Microsoft 365 підтримує регіональну маршрутизацію для забезпечення відповідності вимогам щодо зберігання даних, допомагаючи таким галузям, як фінанси та охорона здоров’я, зберігати дані в межах певних географічних кордонів. Інтеграція з Microsoft Teams забезпечує користувачам доступ до операторів чату та ресурсів у призначеному регіоні Amazon Quick, що сприяє дотриманню вимог що...

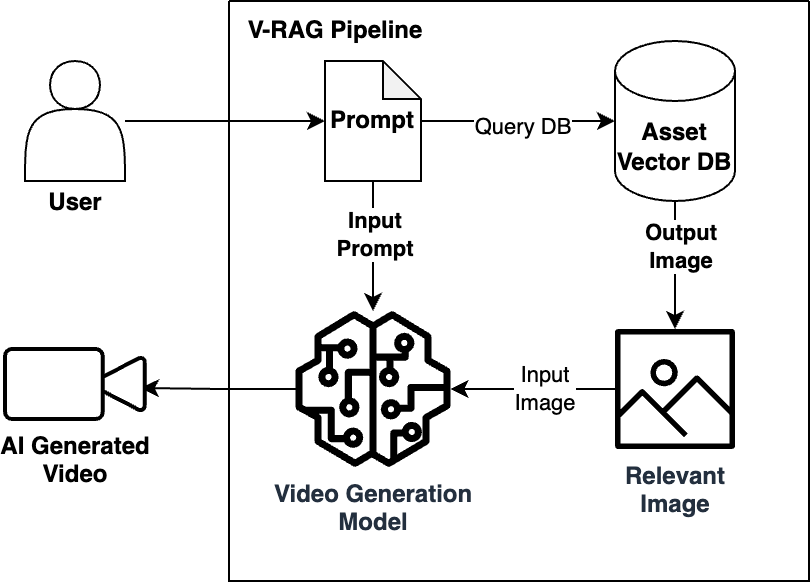

Створення відео за допомогою штучного інтелекту спрощує процес створення контенту, пропонуючи ефективні та надійні рішення. Інструменти перетворення тексту у відео та налаштування забезпечують більший контроль і точність у візуальному оповіданні, кардинально змінюючи процес створення цифрового контенту.

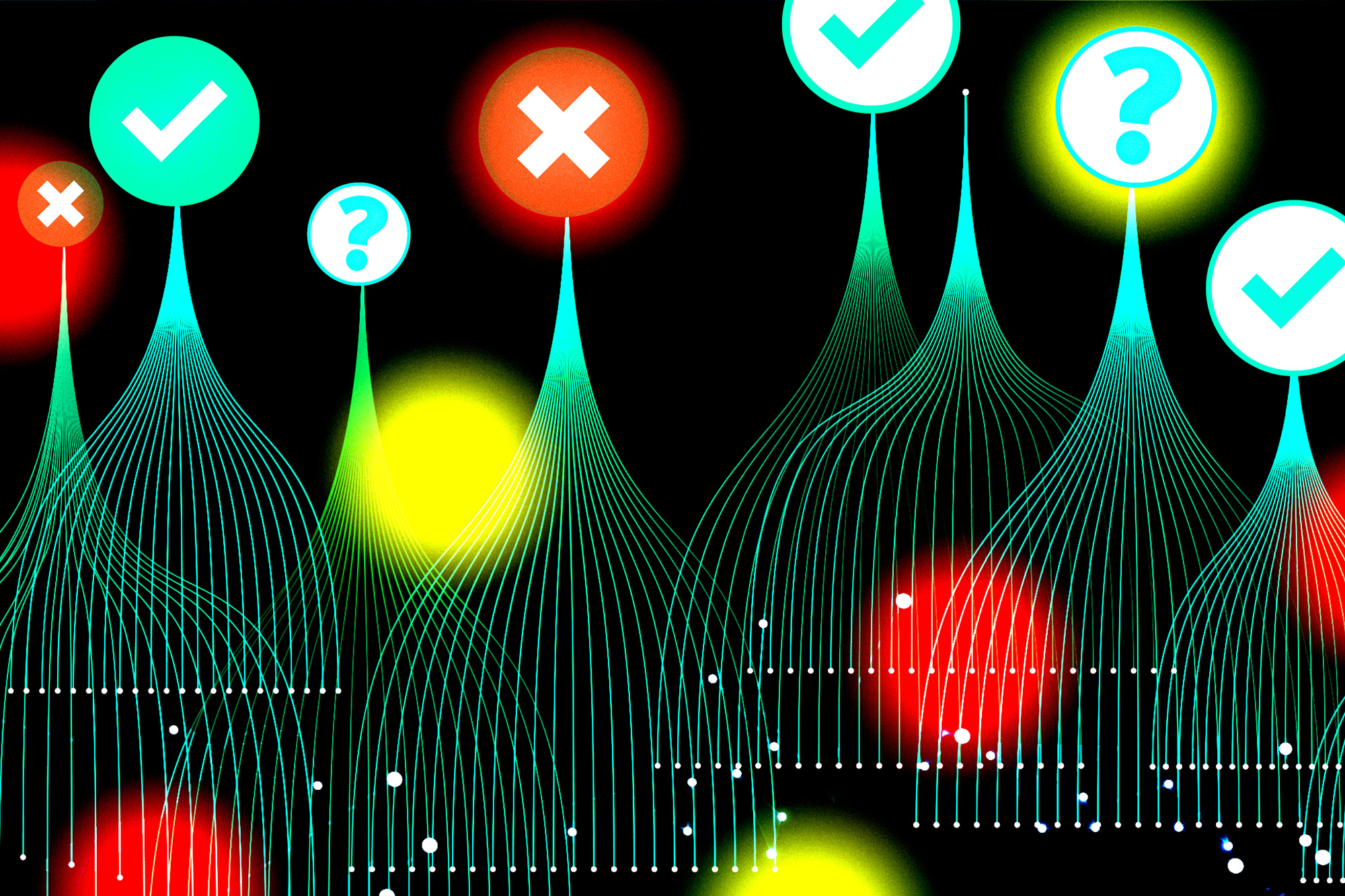

Дослідники з Массачусетського технологічного інституту (MIT) представили новий метод вимірювання невизначеності у великих мовних моделях (LLM), що дозволяє виявляти впевнені, але неправильні відповіді. Порівнюючи відповіді групи схожих LLM, вони створюють показник загальної невизначеності, який перевершує традиційні підходи, підвищуючи надійність у сферах з високими ризиками, таких як охорона ...

Чат-бот не вирішить сімейних конфліктів, але може допомогти зрозуміти справжні наміри. Приєднуйтесь до «AI for the People», щоб дізнатися більше про динаміку спілкування.

У лондонському театрі «Sadler’s Wells East» відбудеться подвійна вистава з використанням новітніх технологій, у рамках якої хореограф Александр Вітлі у своєму новому дуеті «Mirror» досліджує напругу між живими виконавцями та цифровими аватарами. Ця вражаюча вистава демонструє танцюристів, що вигинаються у спіралі та симетричні фігури, а їхні рухи перериваються появою сяючих цифрових двійників,...

Чень Лян, засновник компанії Guchi Robotics, прагне автоматизувати процес кінцевого складання на автомобільних заводах, зменшивши частку ручної праці. Компанія Guchi вже співпрацює з провідними китайськими автомобільними брендами, такими як BYD і Nio, і планує подальшу автоматизацію.