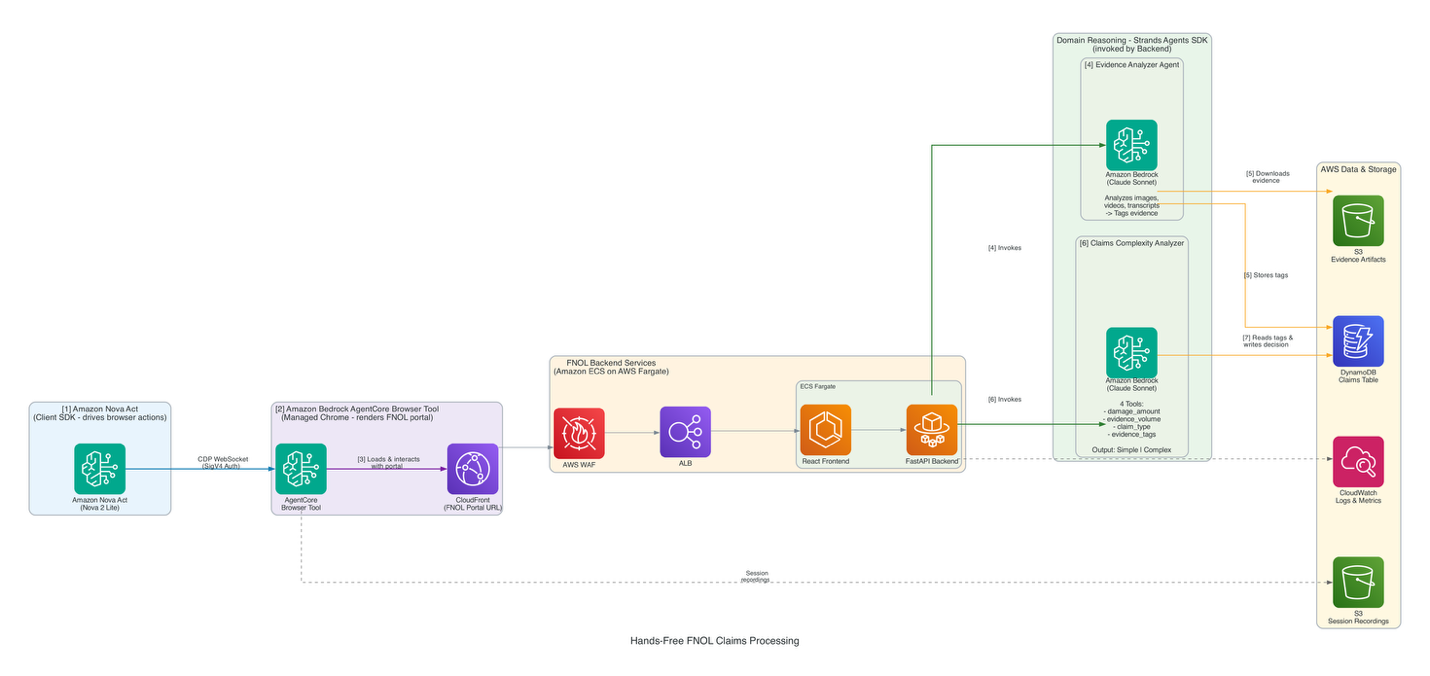

Новая технология оптимизирует процесс приема первичных уведомлений о страховых случаях (FNOL) для страховых экспертов, сокращая количество рутинных задач и повышая эффективность работы. Система «hands-free» объединяет Strands Agents SDK и Amazon Bedrock, что позволяет ускорить и повысить точность обработки страховых заявлений.

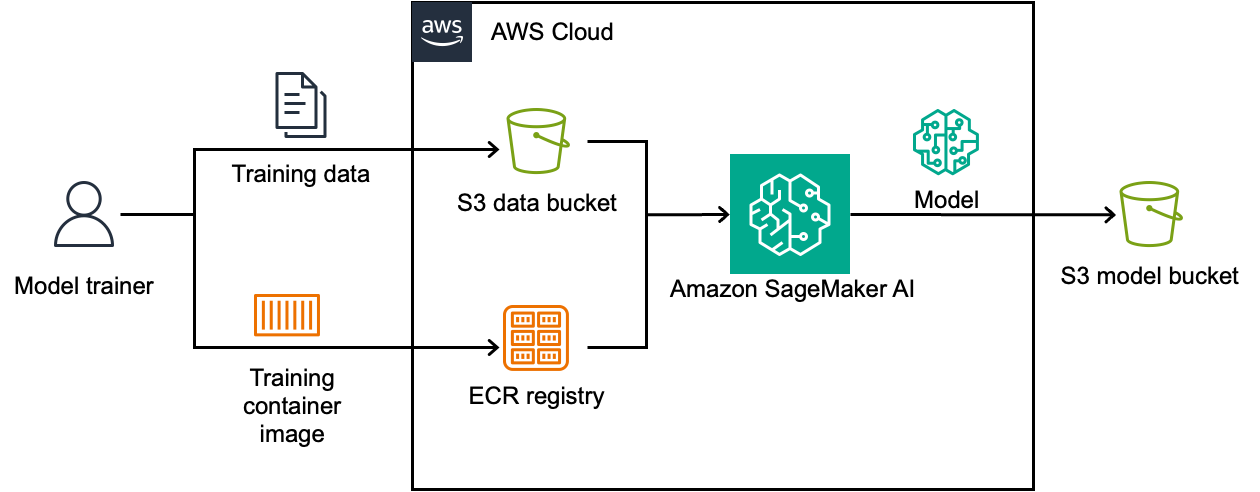

Физический ИИ переходит из стадии исследований в стадию промышленного применения: перед внедрением роботы проходят обучение в высокодетализированных симуляторах. Amazon SageMaker AI оптимизирует вычислительную инфраструктуру для обучения роботов методом подкрепления, обеспечивая отказоустойчивость с помощью SageMaker HyperPod.

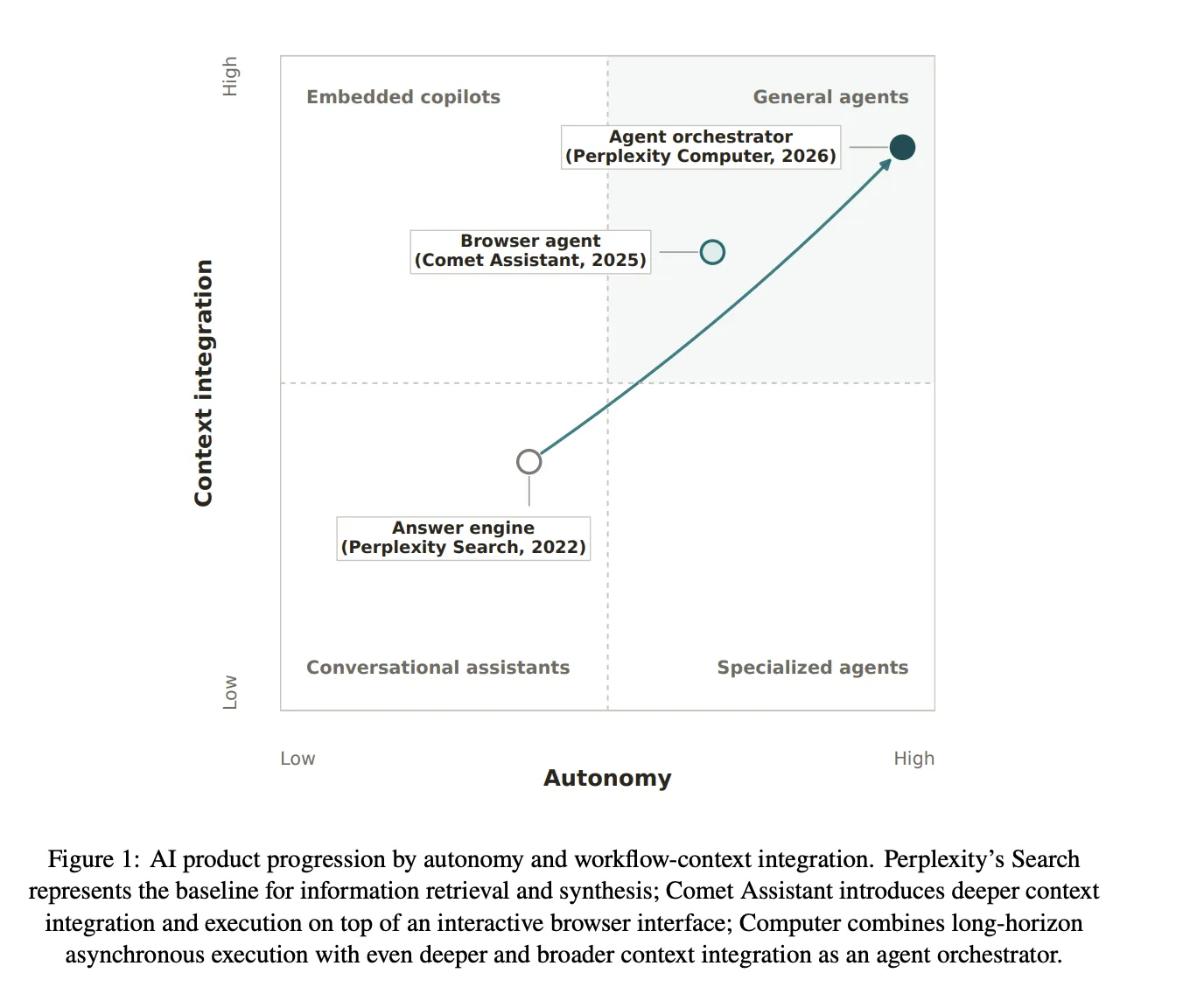

Исследование, проведённое Perplexity и Гарвардским университетом, показывает, что ИИ-агенты преобразуют сферу интеллектуального труда, повышая эффективность и уровень внедрения. Исследование показало, что автономная работа Computer позволяет сэкономить время и повысить удовлетворённость пользователей по сравнению с поисковыми системами.

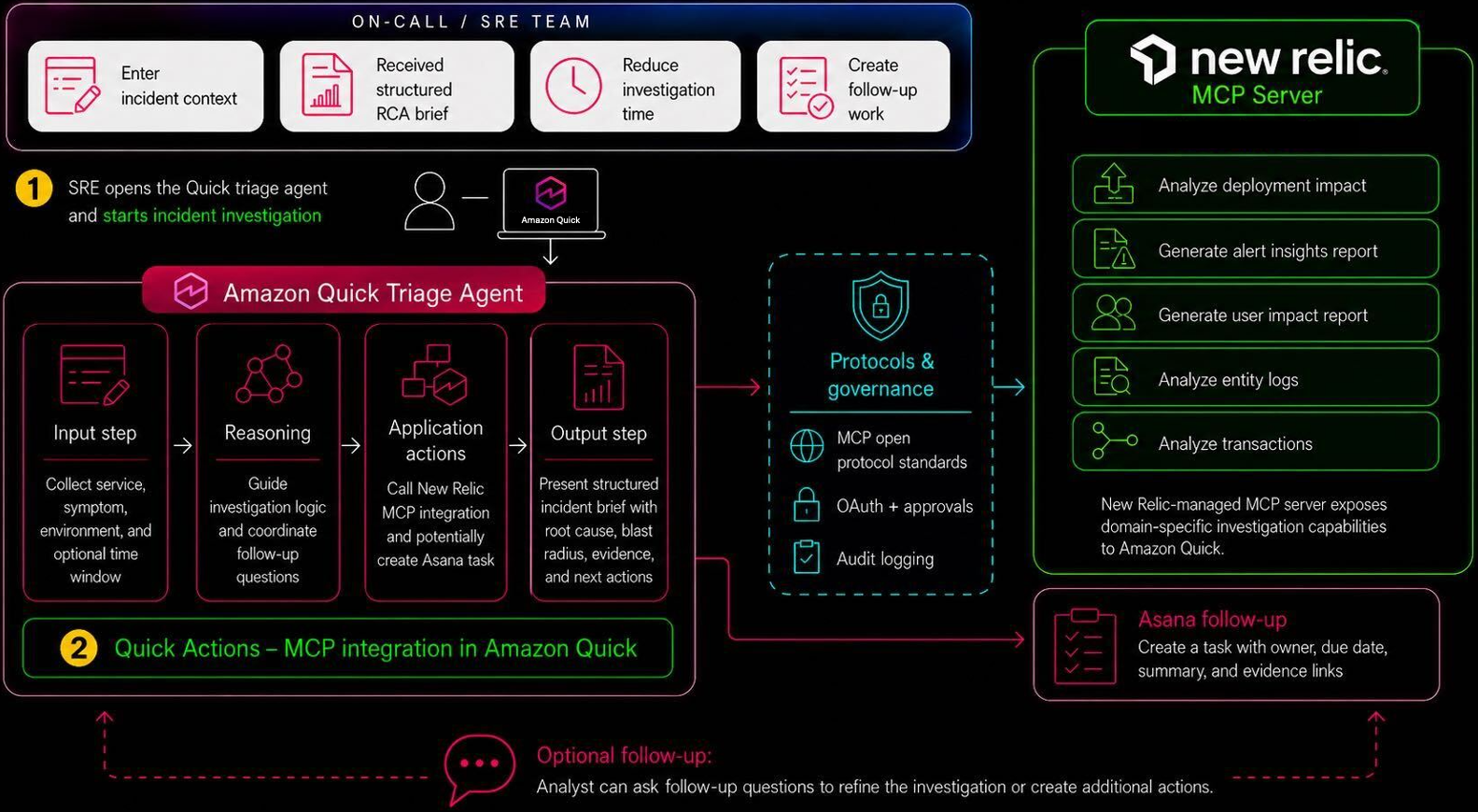

Amazon Quick и New Relic оптимизируют процесс сортировки инцидентов за счет создания настраиваемого помощника-агента, что позволяет быстрее устранять неполадки и снижать риски. Этот агент координирует расследование, анализ первопричин и создание задач в рамках одного запроса, сокращая среднее время устранения неполадок.

Крупные языковые модели, такие как ChatGPT, всё чаще используются для чтения новостей. Исследование Массачусетского технологического института (MIT) выявило парадокс зависимости от ИИ: без помощи ИИ пользователи хуже распознают дезинформацию.

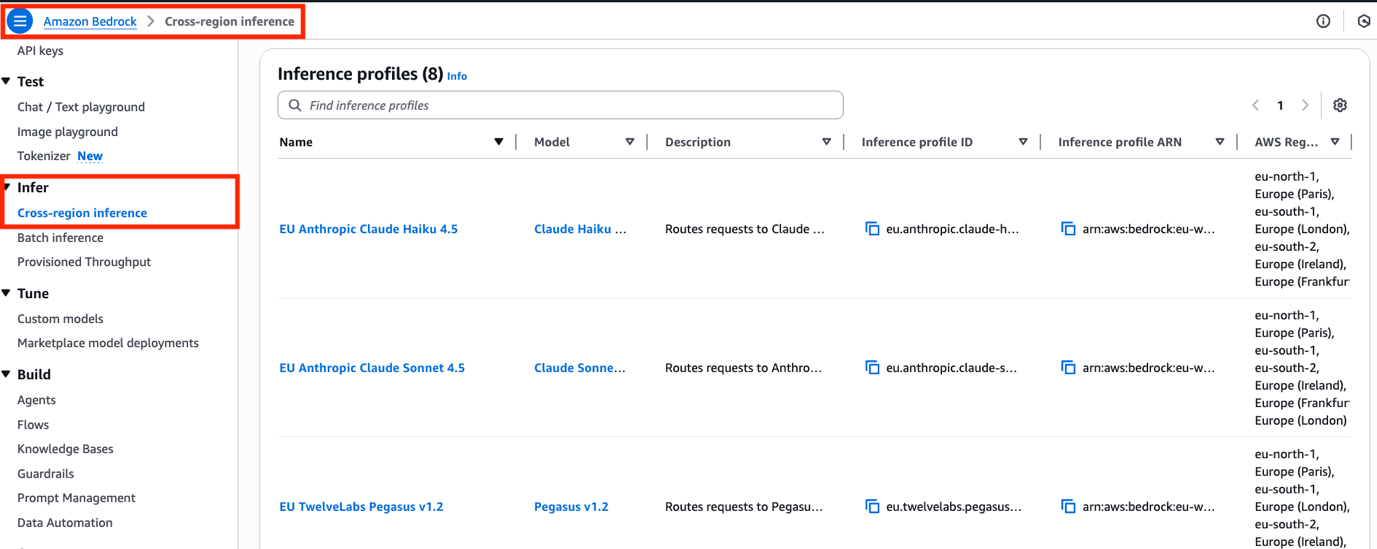

AWS представляет функцию Cross-Region Inference (CRIS) в Amazon Bedrock, которая позволяет клиентам распределять запросы к генеративному ИИ по нескольким регионам AWS, обеспечивая необходимую пропускную способность и безопасность. Профили CRIS оптимизируют пропускную способность моделей, предлагая глобальный и европейский географические диапазоны для соблюдения нормативных требований и повышен...

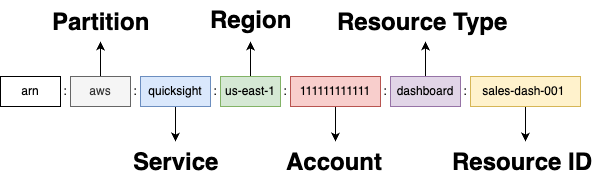

Администраторы Amazon Quick сталкиваются с проблемами, связанными с правами доступа и пространствами имён. Понимание принципов работы ARN имеет решающее значение для успешного развёртывания и обеспечения безопасности ресурсов.

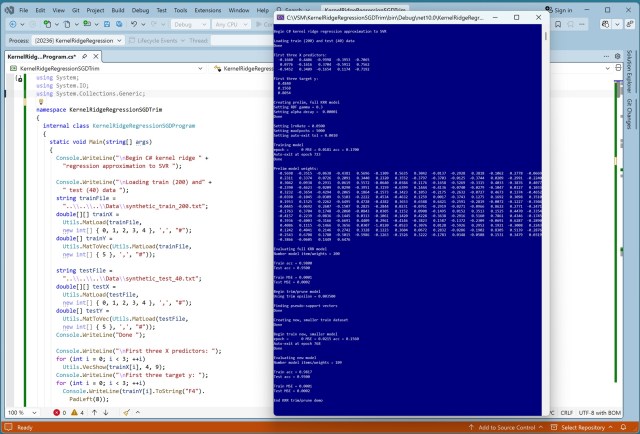

Эффективная регрессия на опорных векторах с использованием регрессии с обрезанным ядром Риджа на C#

Проводится сравнение методов регрессионного анализа на основе машинного обучения, таких как регрессия с ядром Риджа (KRR) и регрессия на опорных векторах (SVR), для прогнозирования числовых значений. Новый подход, сочетающий в себе KRR и SVR, позволяет получить упрощённую модель, обладающую преимуществами обоих методов, что демонстрируется на примере реализации на языке C#.

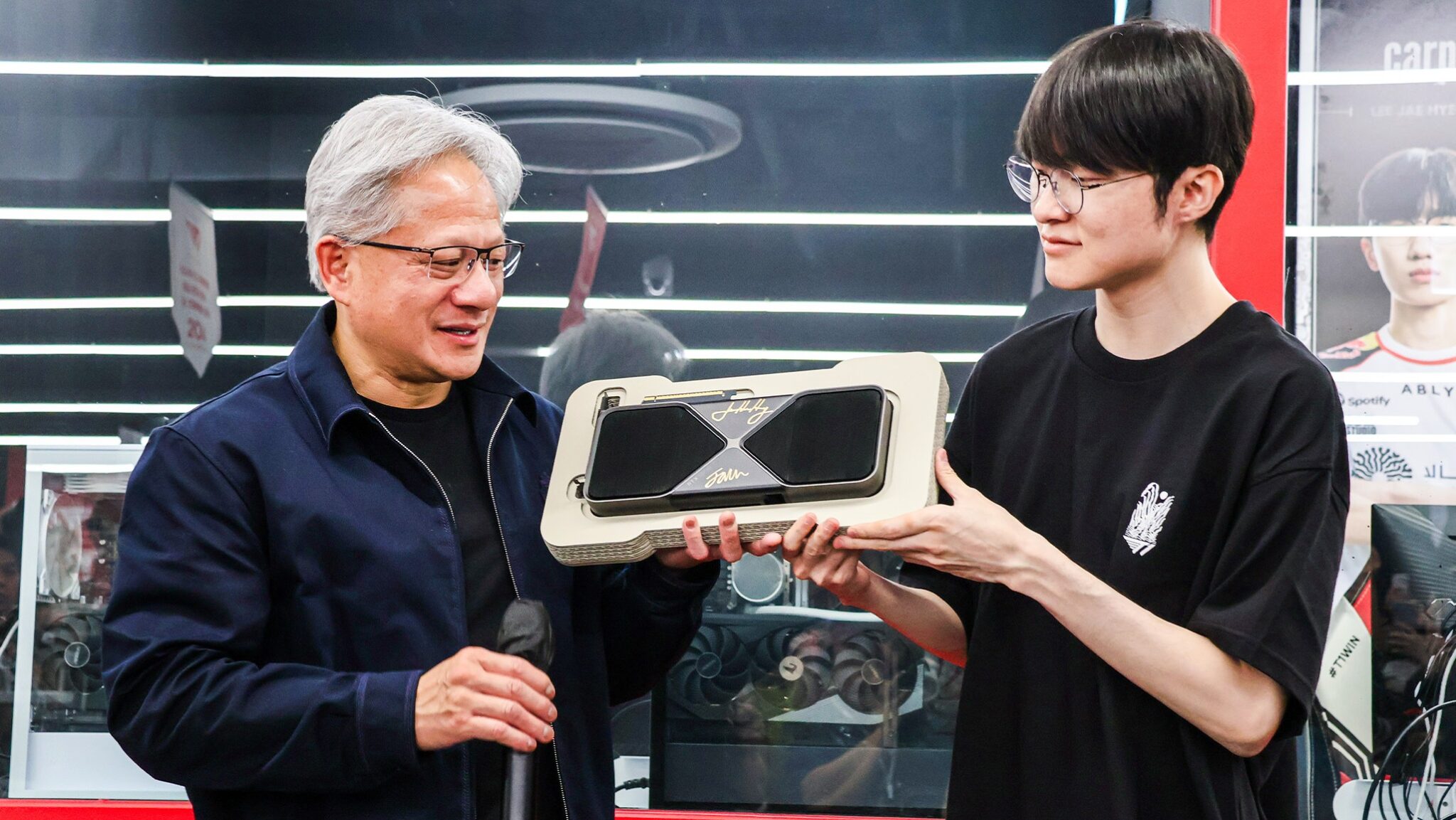

Генеральный директор NVIDIA Дженсен Хуанг посетил Южную Корею, где высоко оценил лидерство страны в области искусственного интеллекта и игровое сообщество. Компания наладила партнерские отношения с LG, SK, Hyundai, Naver и Doosan с целью развития инфраструктуры искусственного интеллекта.

Разработчики отказываются от ноутбуков в пользу Amazon Bedrock AgentCore Runtime, который обеспечивает изолированные среды для эффективной работы агентов-программистов. Попрощайтесь с угрозами безопасности и конфликтами благодаря выделенному рабочему пространству, полнофункциональной оболочке и беспроблемной интеграции с такими инструментами, как GitHub и Jira.

Компания NVIDIA и её партнёры демонстрируют достижения Великобритании в области искусственного интеллекта на London Tech Week: отмечается рост числа облачных внедрений ИИ, а платформа Isambard-AI способствует развитию амбициозных исследований и стартапов. Фонд Sovereign AI Fund, созданный правительством Великобритании, оказывает поддержку местным компаниям, таким как Ineffable Intelligence, а ...

Теперь Amazon SageMaker AI поддерживает вычисления машинного обучения с использованием полностью гомоморфного шифрования (FHE), благодаря чему данные остаются зашифрованными на протяжении всего процесса. Такой подход обеспечивает безопасность облачных приложений машинного обучения в таких сферах, требующих особого внимания к безопасности данных, как здравоохранение, энергетика и телекоммуникации.

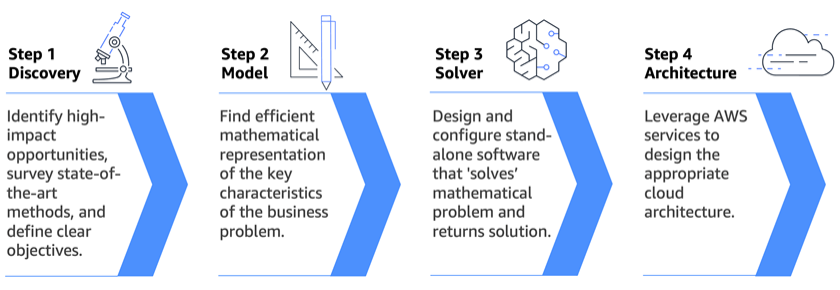

Ведущие организации обращаются к математической оптимизации для принятия оптимальных решений в сложных ситуациях. Центр инноваций в области генеративного ИИ AWS предлагает научную экспертизу для решения важных задач с помощью ИИ и оптимизации, обеспечивая ощутимые бизнес-результаты.

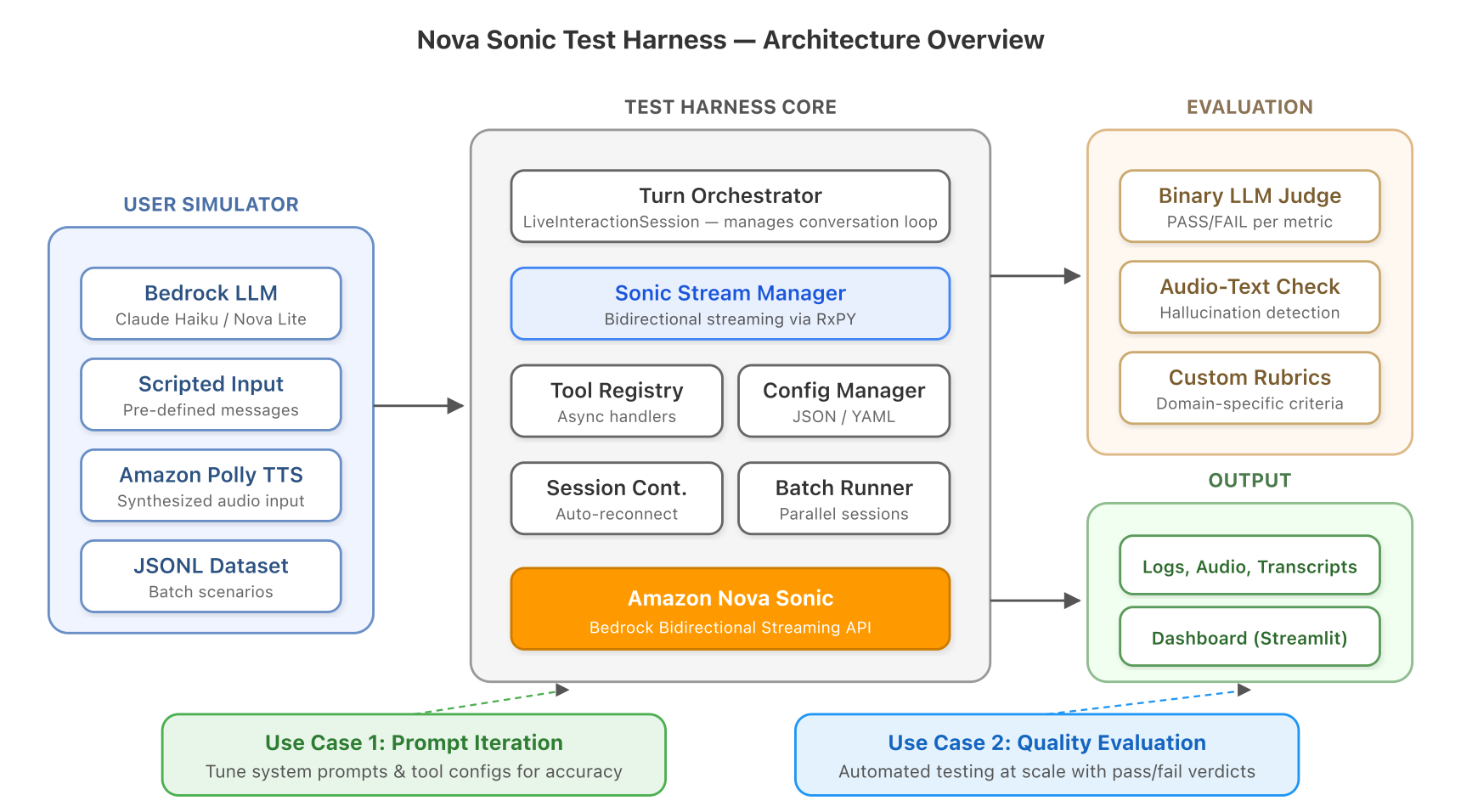

Голосовые агенты кардинально меняют характер взаимодействия с клиентами, однако их тестирование сопряжено с рядом сложностей. Nova Sonic Test Harness предлагает решение, позволяющее быстро проводить итерации и всестороннюю оценку качества работы голосовых агентов без использования микрофона.

Компания NVIDIA представляет RTX Spark — суперчип для ПК под управлением Windows, обеспечивающий улучшенный игровой опыт благодаря технологиям искусственного интеллекта и трассировки лучей. Сотрудничество с ведущими корейскими разработчиками игр, включая KRAFTON и NC, позволит выпустить популярные игры для систем на базе RTX Spark, что вызвало большой ажиотаж в игровом сообществе.