Симпозиум SERC в Массачусетском технологическом институте (MIT) был посвящен влиянию искусственного интеллекта на общество; в его рамках прошли доклады по прогнозированию загрязнения воздуха и этическим аспектам внедрения ИИ. В ходе панельных дискуссий были затронуты проблемы согласования ИИ с человеческими ценностями и вопросы управления системами искусственного интеллекта.

В этом месяце GeForce NOW предлагает 18 новых игр, в том числе долгожданную NTE: Neverness to Everness. Отправляйтесь в путешествие по сюрреалистическим мирам и играйте в классические ремейки мгновенно благодаря облачному стримингу — никаких загрузок не требуется.

Массачусетский технологический институт (MIT), Университет штата Джорджия и их партнеры запускают программу PATH, направленную на организацию обучения в области искусственного интеллекта для общественных колледжей с учетом потребностей отрасли, уделяя особое внимание практическому обучению и сотрудничеству. Программа нацелена на формирование практических навыков и подходов в области искусствен...

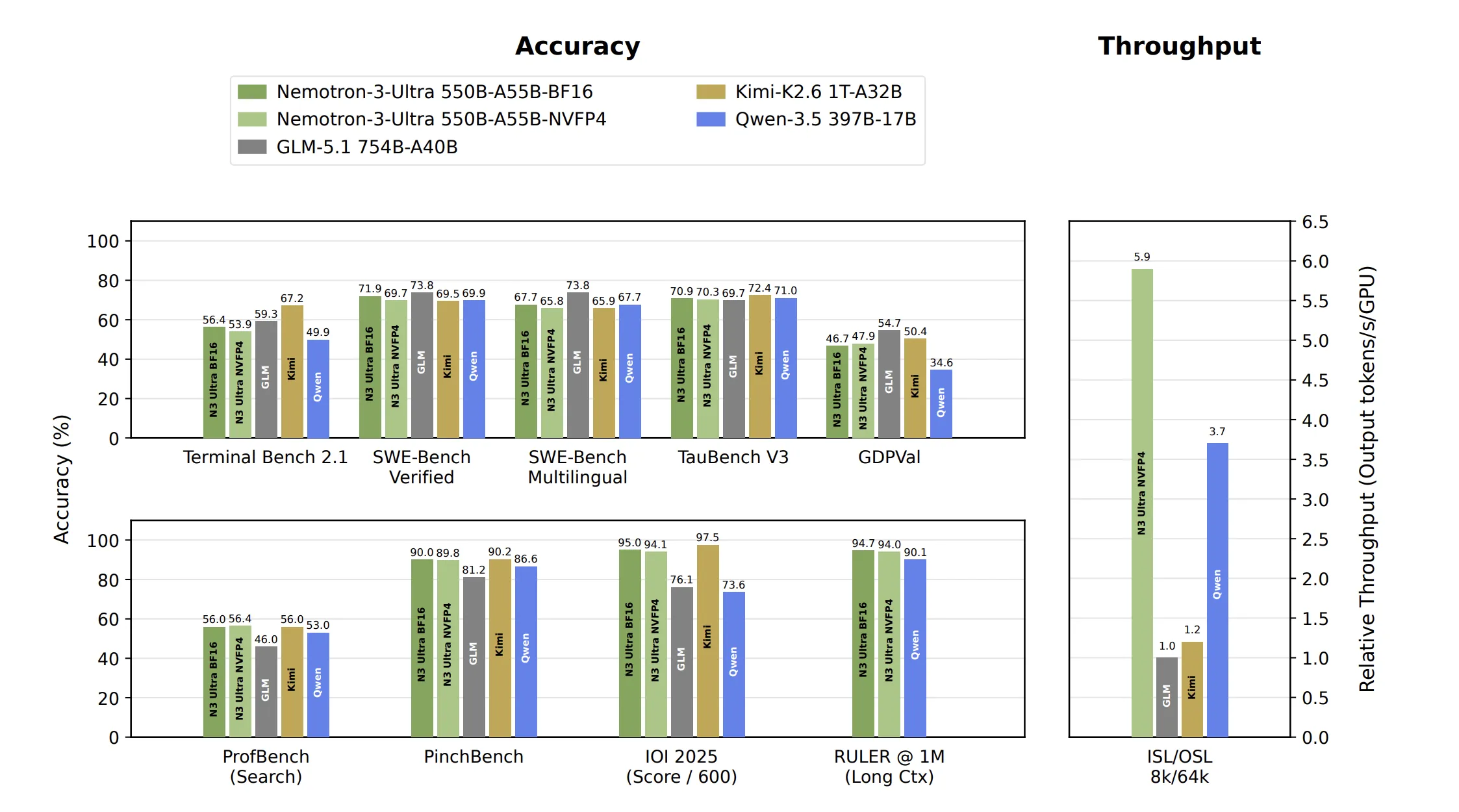

Компания NVIDIA представляет Nemotron 3 Ultra — модель с 550 миллиардами параметров и гибридной архитектурой Mamba-Attention, обеспечивающую в 6 раз более высокую пропускную способность при инференции. Модель использует технологию Multi-Token Prediction для ускорения генерации и обеспечивает стабильное и точное обучение благодаря типу данных NVFP4.

Национальный научный фонд (NSF) продлил финансирование проекта IAIFI Массачусетского технологического института (MIT), уделяя особое внимание тому, как искусственный интеллект способствует развитию физики, а физика — совершенствованию искусственного интеллекта. Совместные исследования в области физики и искусственного интеллекта приводят к революционным открытиям и появлению инновационных науч...

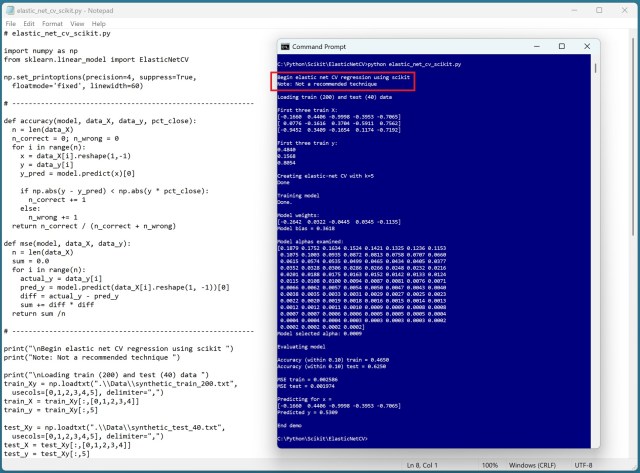

Опытный специалист считает перекрестную валидацию в машинном обучении неэффективной из-за многочисленных недостатков как метода k-кратного разбиения, так и метода «оставь один». Отсутствие обобщаемости и ненадежность настройки гиперпараметров делают перекрестную валидацию

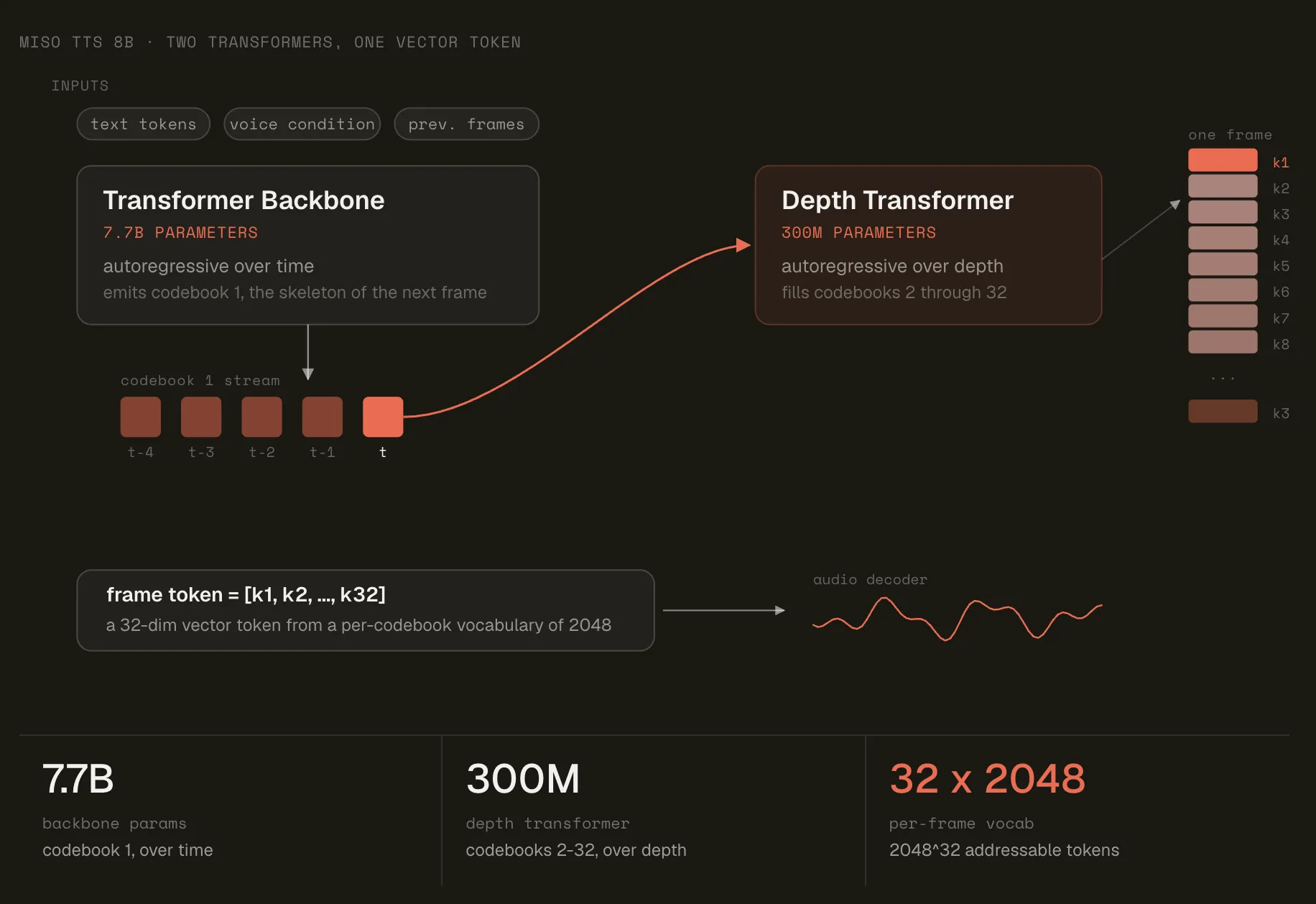

Компания Miso Labs представляет MisoTTS — модель преобразования текста в речь с 8 миллиардами параметров, использующую алгоритм RVQ для расширения звукового диапазона и адаптации к интонации говорящего. Решая проблемы, связанные с объемом словарного запаса и обучением, MisoTTS обеспечивает поддержку 2048³² токенов без увеличения количества параметров, превосходя конкурентов по показателям заде...

Тод Мачовер, пионер в области музыкальных технологий из MIT Media Lab, удостоен медали Джорджа Пибоди за новаторские работы в сфере искусственного интеллекта и интерактивной оперы. Мачовер, известный как музыкальный визионер, расширяет границы музыки и открывает её потенциал для всех.

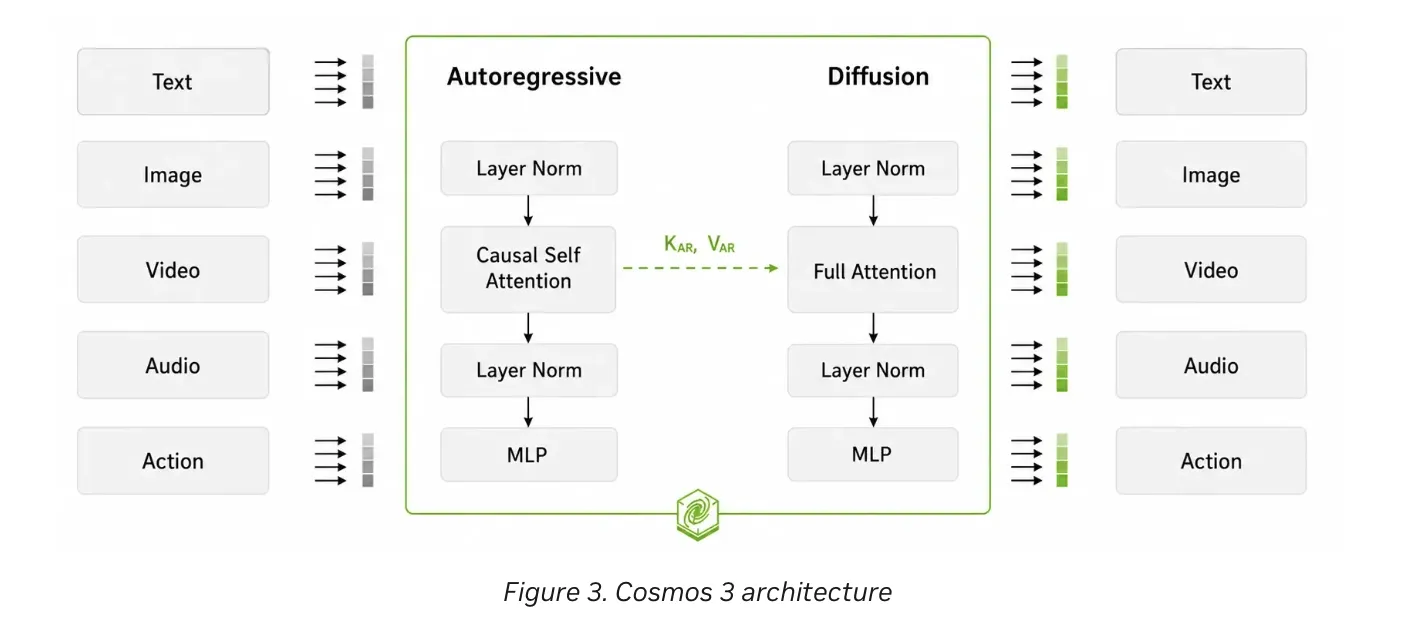

Команда NVIDIA AI выпустила Cosmos 3 — унифицированную модель для физического искусственного интеллекта. Она объединяет физическое мышление, генерацию окружающего мира и генерацию действий для робототехники и автономных транспортных средств.

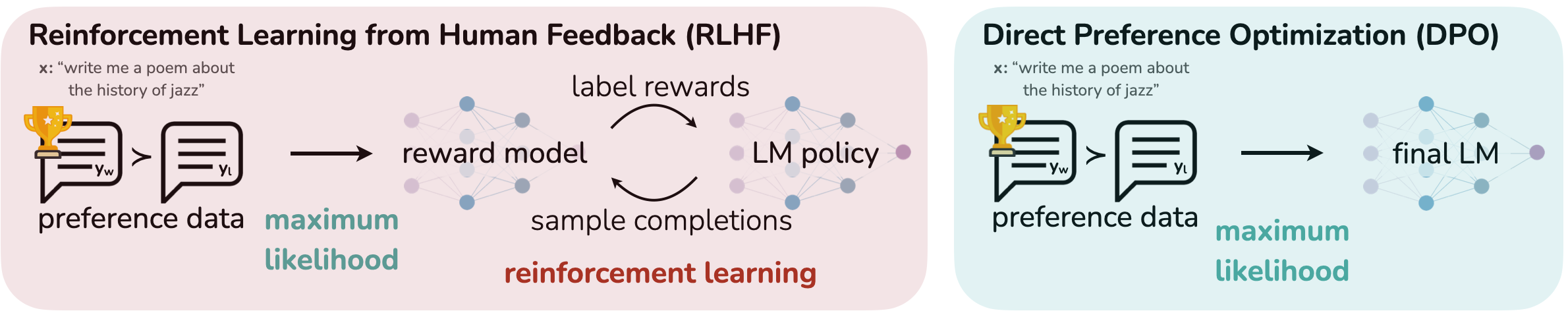

ИИ-агенты должны выбирать подходящие инструменты для выполнения задач, чтобы избежать ошибок и задержек. Узнайте, как SFT и DPO повышают точность вызова инструментов в языковых моделях для обеспечения надежной автоматизации.

AMI Deep Learning и контейнеры AWS Deep Learning теперь поддерживают инструмент SOCI Snapshotter и индекс SOCI для эффективного управления образами контейнеров. Функция отложенной загрузки SOCI снижает нагрузку на сетевую пропускную способность и сокращает время запуска контейнеров, что приносит пользу организациям, управляющим большими образами контейнеров в облачных средах.

Исследователи из Массачусетского технологического института (MIT) и Исследовательской лаборатории вычислительной техники MIT-IBM разработали ChartNet — набор данных и ряд моделей с открытым исходным кодом, которые превосходят коммерческие модели искусственного интеллекта в таких задачах, как интерпретация графиков. Этот прорыв может позволить...

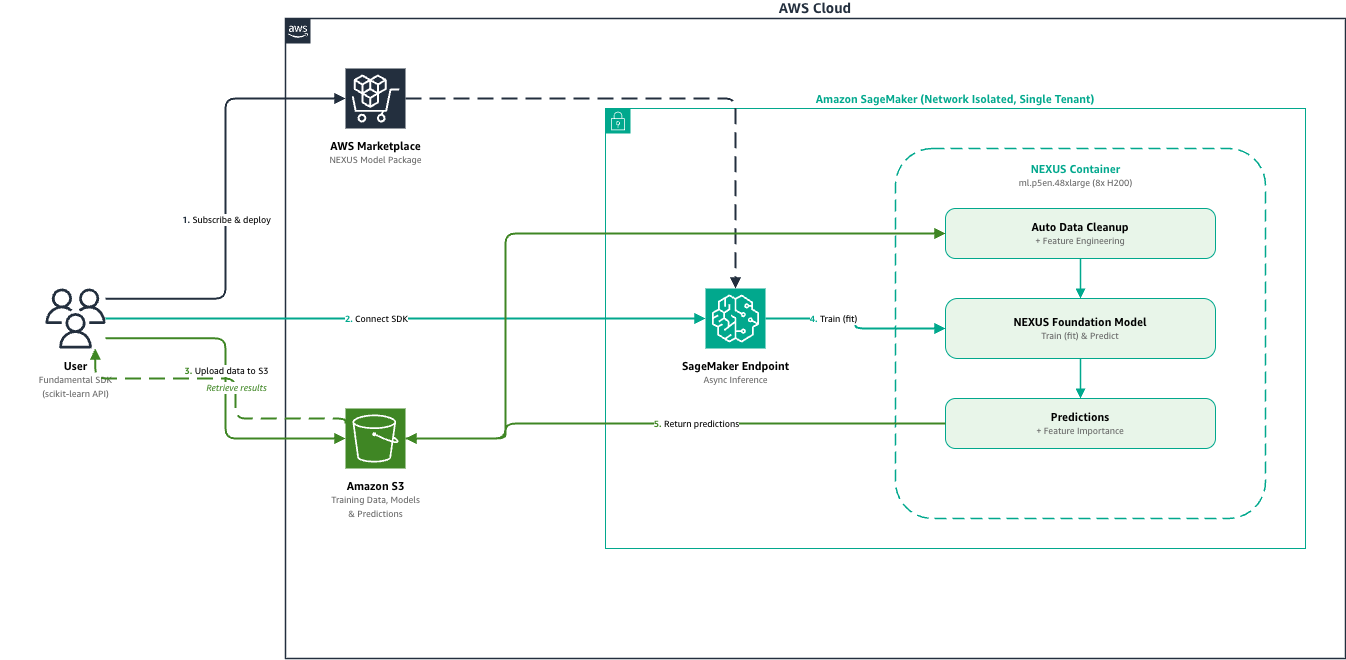

Amazon SageMaker AI теперь поддерживает модель NEXUS от Fundamental, позволяющую с высокой точностью прогнозировать табличные данные за считанные дни. NEXUS обеспечивает детерминированные результаты, встроенное понимание табличных данных и несеквенциальное логическое мышление для анализа структурированных данных.

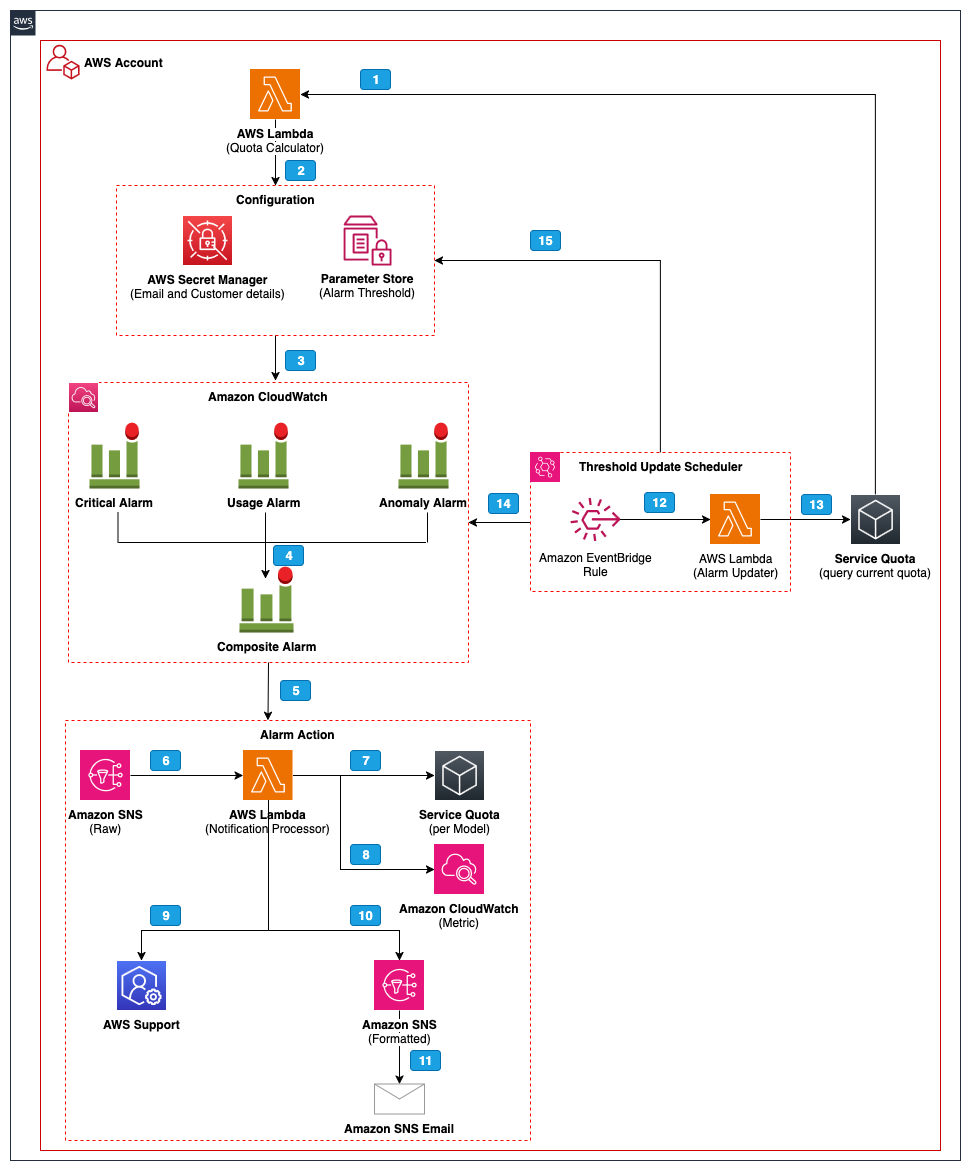

Amazon Bedrock предоставляет возможности генеративного ИИ более чем 100 000 организациям по всему миру, предлагая комплексные инструменты для реализации смелых инноваций. Представляем Amazon Bedrock Ops Alert — решение для проактивного мониторинга, обеспечивающее надежное операционное управление рабочими нагрузками ИИ и позволяющее командам добиваться реальных результатов для бизнеса.

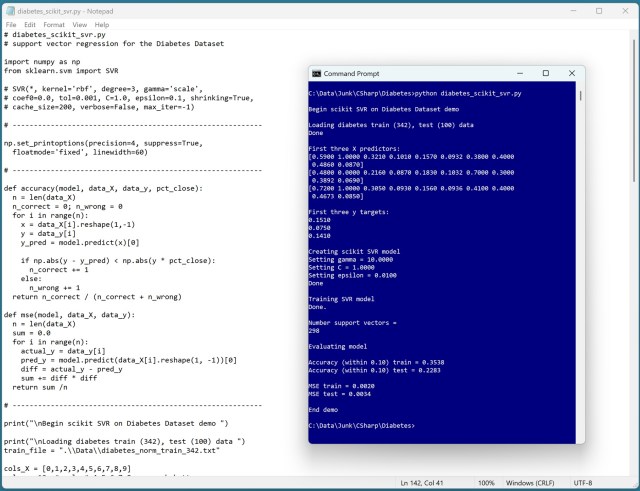

При тестировании кода на наборе данных по диабету модель scikit SVR продемонстрировала низкую точность прогнозирования. Модель Kernel SVR превзошла линейную модель SVR благодаря своей мощности и масштабируемости, что тесно связано с алгоритмом KRR.