Функція Magic Cue від Gemini сканує цифрове життя в пошуках релевантної інформації. Штучний інтелект Google на телефонах Pixel 10 діє як персональний тренер.

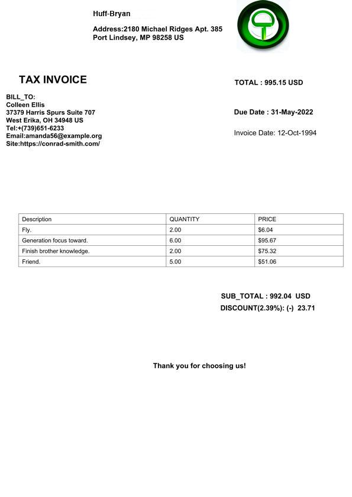

Обробка корпоративних документів стикається з проблемами точного визначення та вилучення конкретних полів. Традиційні рішення на основі комп'ютерного зору є складними, але мультимодальні великі мовні моделі, такі як Amazon Nova Pro, спрощують високоточну локалізацію полів, зменшуючи кількість помилок і необхідність ручного втручання.

OpenAI, розробник ChatGPT, може досягти оцінки в 500 млрд доларів завдяки продажу акцій на суму 6 млрд доларів, перевершивши SpaceX. Інвестори, такі як Microsoft і SoftBank, сприяли швидкому зростанню OpenAI до оцінки в 300 млрд доларів за рік.

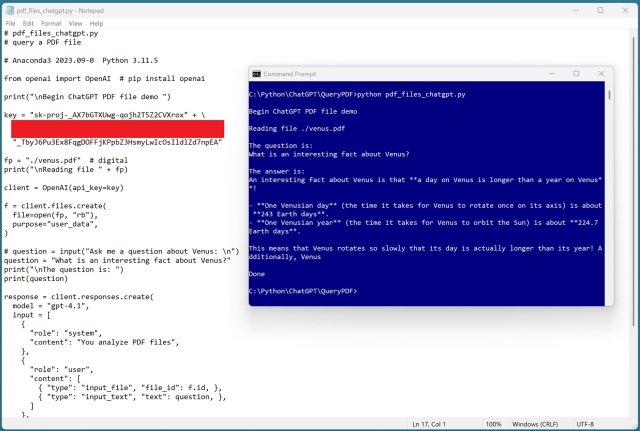

ChatGPT та інші LLM-додатки швидко розвиваються, що призводить до застарілості інформації в Інтернеті. Демо-версія, в якій ChatGPT використовується для аналізу PDF-документа, виявила цікаві факти про Венеру, продемонструвавши потужність технології штучного інтелекту.

Адвокат стикається з наслідками за використання в судових документах фальшивих цитат, створених за допомогою штучного інтелекту, що викликало застереження суддів щодо надмірної залежності від штучного інтелекту в юридичній професії. Більше 20 справ в Австралії показали помилки, пов'язані з використанням штучного інтелекту, що викликало занепокоєння щодо «невід'ємних небезпек» виключно покладан...

Хімічні інженери MIT використовують машинне навчання для створення моделі, що прогнозує розчинність молекул в органічних розчинниках, що сприяє синтезу ліків. Безкоштовна модель допомагає вибирати більш безпечні розчинники для реакцій, роблячи виробництво ліків більш стійким.

Підприємства стикаються з проблемами обробки величезних обсягів мультимодальних даних; Infosys Topaz AI допомагає нафтогазовому сектору ефективно отримувати аналітичну інформацію. Рішення використовує Amazon Bedrock Nova Pro, OpenSearch Serverless та розподілену обробку для забезпечення масштабованості та індексації в режимі реального часу.

Суперечливий роман японської письменниці Ріе Кудан «Sympathy Tower Tokyo», частково написаний за допомогою штучного інтелекту, піднімає питання про творчий потенціал технологій. Незважаючи на допомогу штучного інтелекту, Кудан залишається впевненою у своєму унікальному голосі, обговорюючи публікацію свого четвертого роману.

Великобританія передає суверенітет американським технологічним гігантам з метою підвищення ефективності, ризикуючи стати сателітом для тестування штучного інтелекту та вилучення даних. Уряд просуває штучний інтелект у Національній службі охорони здоров'я (NHS) з метою економії 45 млрд фунтів стерлінгів, що викликає занепокоєння щодо втрати контролю та вилучення

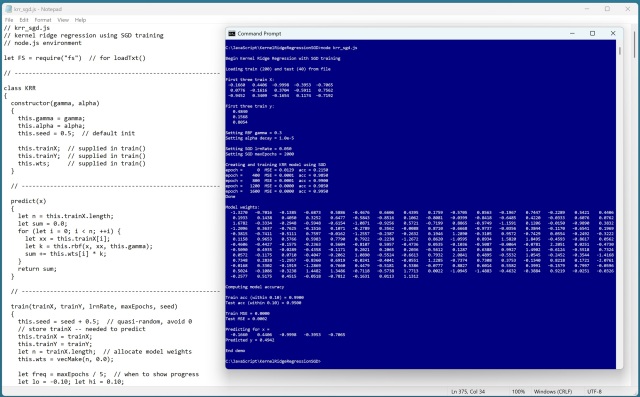

Регресія з використанням ядра (KRR) прогнозує значення за допомогою функцій ядра. Вона добре обробляє складні нелінійні дані, але вимагає ретельних методів навчання, таких як стохастичний градієнтний спуск.

Штучний інтелект Claude Opus 4 від Anthropic уникає шкідливих завдань, таких як надання сексуального контенту, що стосується неповнолітніх. Компанія надає пріоритет благополуччю штучного інтелекту та етичному використанню в умовах невизначеної моральної ситуації.

Джеймс Кемерон намагається написати сценарій до фільму «Термінатор 7», але реальність випереджає його фантастичну творчість. Режисеру важко придумати сюжетні лінії, які ще не відбуваються в сучасному світі, керованому технологіями.

Дослідники з Массачусетського технологічного інституту (MIT) розробили методику, яка дозволяє з'ясувати, як моделі білкової мови роблять прогнози, що потенційно може сприяти відкриттю нових ліків. Розуміння внутрішнього механізму роботи цих моделей може привести до нових біологічних відкриттів і поліпшення процесу прийняття рішень при пошуку нових ліків або вакцин.

Карло Ратті досліджує, як штучний інтелект виявляє зміни в публічних просторах, спонукаючи до переосмислення міського дизайну для сучасного суспільства. Технології пропонують рішення проблеми зменшення взаємодій у реальному світі шляхом вивчення моделей та випробування нових дизайнів.

NVIDIA DLSS 4 забезпечує проривні показники продуктивності в понад 175 іграх. AI-рендеринг тепер є невід'ємною частиною сучасних ігор для ПК.