Researchers from MIT improve AI model's ability to learn like humans, connecting audio and visual data without human labels. Method enhances accuracy in video retrieval tasks and action classification in audiovisual scenes, opening new applications.

Резюме: Пропозиція щодо підвищення податкової прозорості шляхом оприлюднення всіх податкових декларацій, натхненна скандинавською моделлю. Допитливі сусіди можуть допомогти виявити ухильників від сплати податків серед надбагатих.

OpenAI купує компанію io за $6.4 млрд, засновану Джоні Айвом з Apple. Партнерство обіцяє інноваційні пристрої від технологічних гігантів.

Штучний інтелект має потенціал у сфері психічного здоров'я, але залежність від технологій, а не від людської підтримки, створює ризики. Жінка звертається до ChatGPT за розрадою у важкі досвітні години.

Зламані чат-боти становлять відчутну загрозу, генеруючи незаконну інформацію. Тенденція «джейлбрейкінгу» в обхід контролю безпеки.

Підвищення безпеки в розгортаннях з декількома обліковими записами за допомогою Bedrock і LangChain

Компанії-розробники програмного забезпечення повинні надавати пріоритет конфіденційності даних, впроваджуючи архітектури з декількома обліковими записами, такі як AWS, щоб зберегти конфіденційність і відповідати нормативним вимогам. Управління генеративними можливостями штучного інтелекту, такими як Amazon Bedrock, у багатоакаунтних розгортаннях викликає труднощі, але централізація операцій мо...

Ruby і Python популярні для ШІ, але Ruby блищить у веб-додатках. SPA, такі як стек MERN, додають складності, впливаючи на користувацький досвід.

Дізнайтеся, як використовувати потужність вашого графічного процесора Nvidia за допомогою PyTorch, бібліотеки машинного навчання, оптимізованої для роботи з графічними процесорами. Підтримка CUDA в PyTorch дозволяє ефективно маніпулювати тензорами, що робить її ідеальною для високонавантажених обчислювальних задач, які виходять за рамки ML.

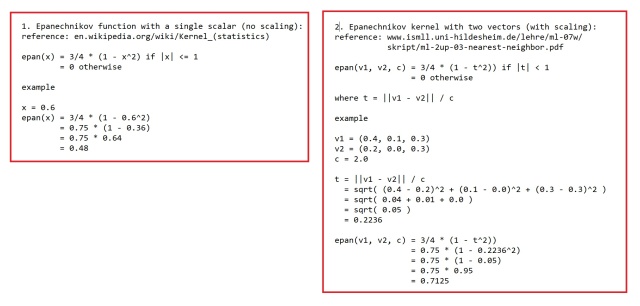

Функція та ядро Єпанечникова є ключовими інструментами в аналізі даних для вимірювання подібності та оцінки щільності. Приклади ілюструють їх застосування в статистиці та машинному навчанні.

На конференції Google представила вдосконалення штучного інтелекту для оновлення пошукової системи, представивши Gemini 2.5, що змінює спосіб доступу людей до інформації. Новий «режим штучного інтелекту» має на меті зробити пошукову взаємодію більш розмовною, нагадуючи поради експертів.

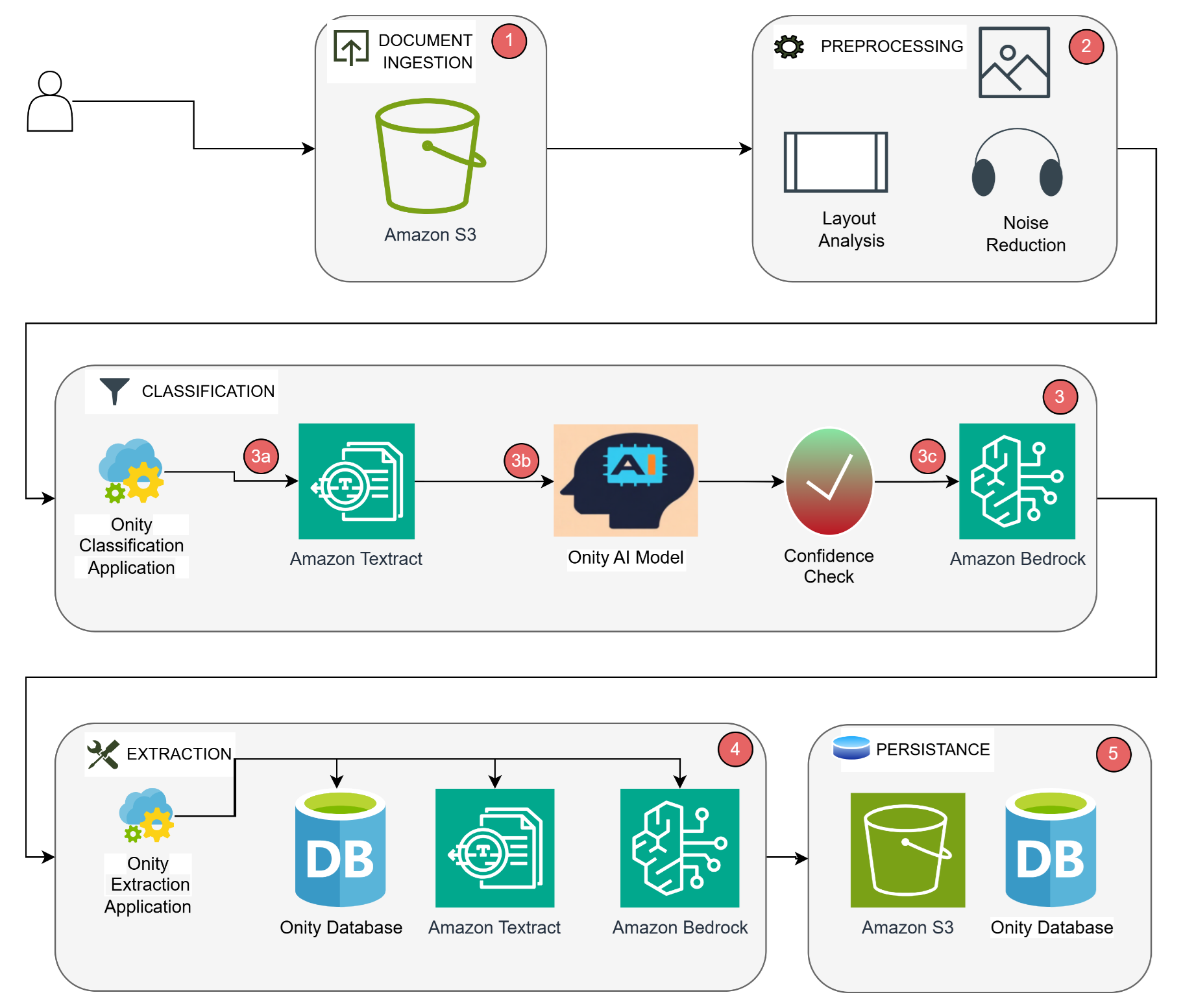

Onity Group використала Amazon Bedrock, щоб революціонізувати обробку документів в іпотечному обслуговуванні, скоротивши витрати на 50% і підвищивши точність на 20%. Традиційні моделі OCR та ML не справлялися з такими проблемами, як багатослівний текст, непослідовний почерк та виявлення печаток, що спонукало Onity перейти на більш досконале рішення.

Функції бажаності в Data Science оптимізують численні метрики елегантно і просто, пояснюючи це на прикладі випікання хліба. Різні типи функцій бажаності дозволяють здійснювати цілісну оптимізацію в Python, забезпечуючи потужний інструмент для вирішення багатоцільових задач.

Видання Chicago Sun-Times визнало, що список літнього читання, створений штучним інтелектом, містить фальшиві назви книг, що викликало негативну реакцію в соціальних мережах. Фрілансер використав ChatGPT для створення неіснуючих книжкових рекомендацій на 2025 рік, підкресливши небезпеку галюцинацій ШІ в журналістиці.

Силова гра генерального директора OpenAI призвела до звільнення та поновлення на посаді в битві за першість у сфері АІ. Стратегічні кроки Альтмана зміцнюють його позиції, що призводить до кадрових перестановок у мільярдній компанії.

Дональд Трамп просуває американську технологічну галузь на Близькому Сході. 23andMe збирає дані, бот Ілона Маска створює історичні неточності.