Автоматизовані робочі процеси часто потребують схвалення людини; масштабована система ручного схвалення була побудована з використанням крокових функцій AWS, Slack, Lambda і SNS. Рішення включає в себе машину станів з паузою для прийняття рішення людиною та повідомленням Slack для затвердження.

Президент України запросив Папу Римського Лева XIV до України, закликавши ЗМІ припинити поляризацію мови. Лев виступає за відповідальне використання штучного інтелекту в журналістиці.

Навчання лінійного SVR є складним завданням через його недиференційовану функцію втрат, що призвело до вивчення PSO замість еволюційних алгоритмів. Використання PSO для навчання лінійного SVR дало чудові результати, демонструючи важливість налаштування параметрів для оптимізації прогнозуючих моделей.

WebAssembly розширює можливості браузера Бібліотека Pyodide дозволяє запускати код на Python у браузері, що є корисним для дослідників даних та фахівців з машинного навчання.

Останні великі мовні моделі, такі як o1/o3 від OpenAI та R1 від DeepSeek, використовують ланцюжок думок (CoT) для глибокого мислення. Новий підхід, PENCIL, кидає виклик цьому методу, дозволяючи моделям стирати думки, підвищуючи ефективність міркувань.

Палата лордів підтримала поправку до законопроекту про дані, яка змушує ШІ-компанії розкривати інформацію про використання матеріалів, захищених авторським правом, всупереч бажанням уряду. Депутати вимагають прозорості в моделях штучного інтелекту, що є ударом по планах уряду щодо захисту авторських прав.

Ширу Перлмуттер, керівника офісу з авторських прав США, звільнили після звіту про добросовісне використання ШІ. Бібліотекар Конгресу також звільнений.

Протокол Model Context Protocol (MCP) необхідний для інтеграції користувацьких інструментів з Claude Desktop, забезпечуючи централізований спосіб керування інструментами через різні інтерфейси. У порівнянні з традиційними методами, такими як RAG, MCP забезпечує безперешкодну інтеграцію без необхідності створювати власний сервер з нуля.

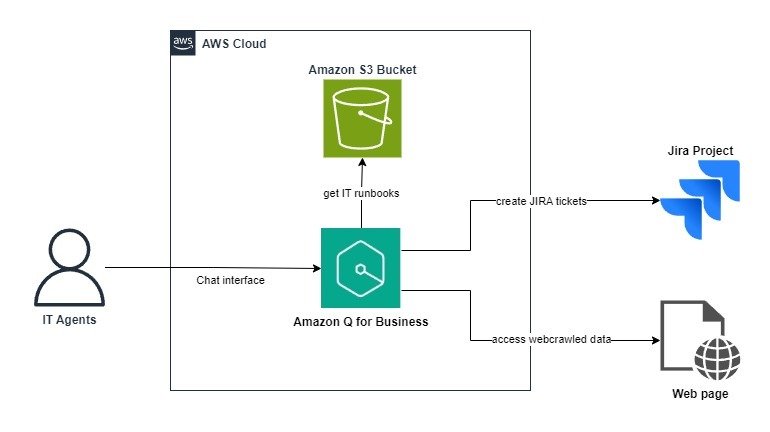

Amazon Q Business пропонує масштабовану допомогу зі штучним інтелектом для команд ІТ-підтримки, підвищуючи продуктивність завдяки розумінню природної мови та персоналізованим відповідям. Інтегруючись з Jira та налаштовуючи бази знань, Amazon Q впорядковує процеси усунення несправностей, скорочуючи час і зусилля на вирішення ІТ-викликів.

Захисник безпеки ШІ Макс Тегмарк закликає оцінювати екзистенційні загрози перед випуском потужних систем ШІ, проводячи паралелі з розрахунками Оппенгеймера перед першим ядерним випробуванням. Дослідження Тегмарка вказує на 90% ймовірність того, що високорозвинений ШІ може становити катастрофічний ризик, підкреслюючи важливість розрахунків безпеки, подібних до тих, що були проведені перед випро...

Режим харчування має таке ж значення, як і те, що ми їмо. Модифіковане динамічне викривлення часу (MDTW) допомагає аналізувати час прийому їжі та її поживну цінність.

Стиснення моделей має важливе значення в епоху великих мовних моделей. Дізнайтеся про обрізання, квантування, низькорангову факторизацію та методи дистиляції знань у машинному навчанні.

Англійська з африканським акцентом є складним завданням для систем ASR, але AccentFold пропонує унікальне рішення, вивчаючи вставки акценту з більш ніж 100 африканських акцентів. Цей метод допомагає системам розпізнавання мови узагальнювати раніше невідомі їм акценти, що робить значний внесок у дослідження в галузі машинного розпізнавання мови.

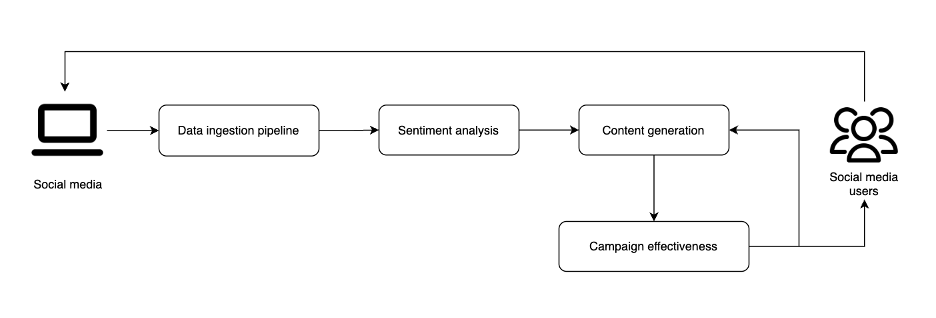

Маркетингові кампанії мають вирішальне значення в медіа та індустрії розваг, але розуміння їхньої ефективності є ключовим. Інноваційне рішення з використанням генеративного ШІ та LLM трансформує маркетингову аналітику, поєднуючи аналіз настроїв, генерацію контенту та прогнозування кампаній для оптимізації результатів.

Генеральний директор CrowdStrike скорочує 5% персоналу, покладаючись на ефективність штучного інтелекту для прийняття рішень. Джордж Курц оголосив про скорочення 500 посад по всьому світу.