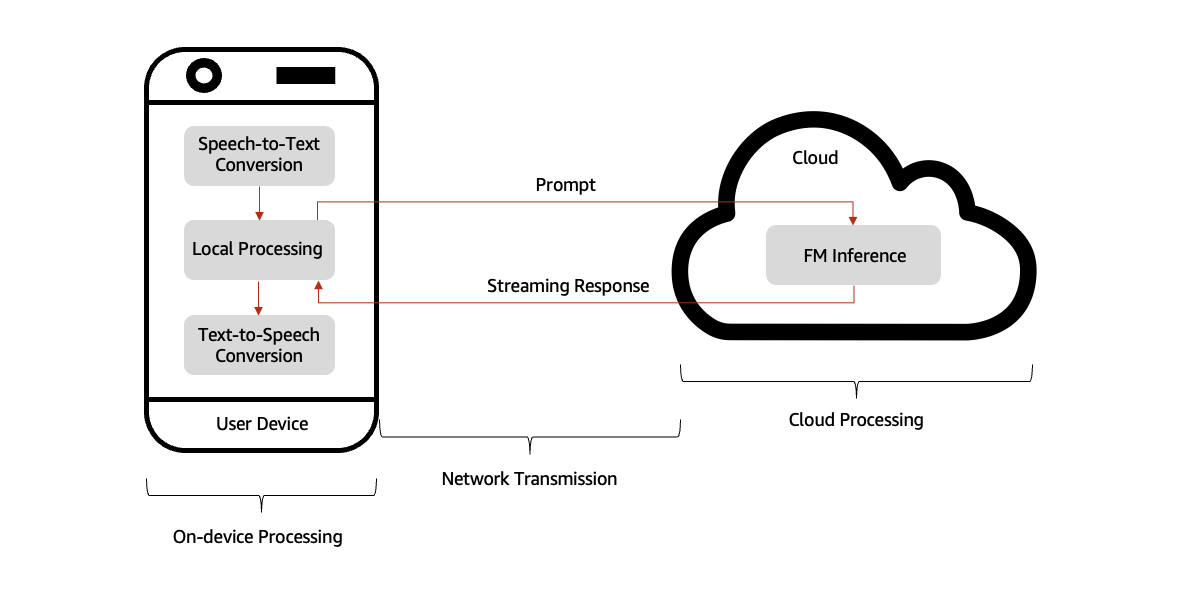

Досягнення в галузі генеративного ШІ сприяють створенню розмовних асистентів ШІ з можливістю взаємодії в режимі реального часу в різних галузях. Баланс між потужністю хмарного FM і швидкістю відгуку локального пристрою є ключовим для зменшення затримки відгуку нижче 200 мс.

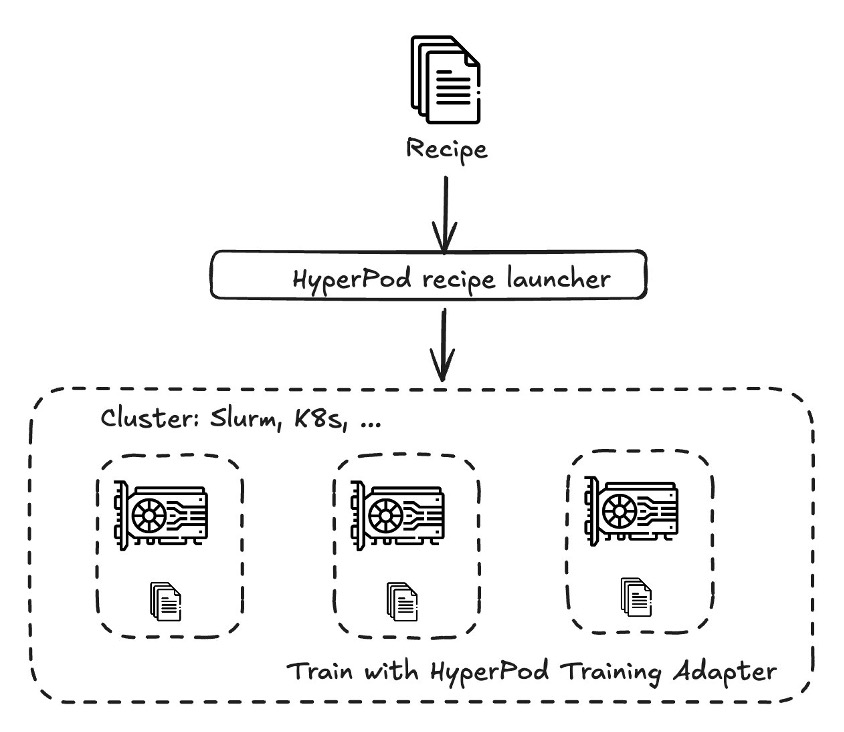

Організації налаштовують ШІ-моделі DeepSeek для конкретних випадків використання, стикаючись з проблемами в управлінні обчислювальними ресурсами. Рецепти Amazon SageMaker HyperPod спрощують кастомізацію моделей DeepSeek, досягаючи до 49% покращення результатів за шкалою Rouge 2.

У Парижі в годину пік для зменшення заторів і забруднення обмежують пішохідну зону для спільного користування автомобілями. Смуга відкрита для громадського транспорту, таксі та екстрених служб.

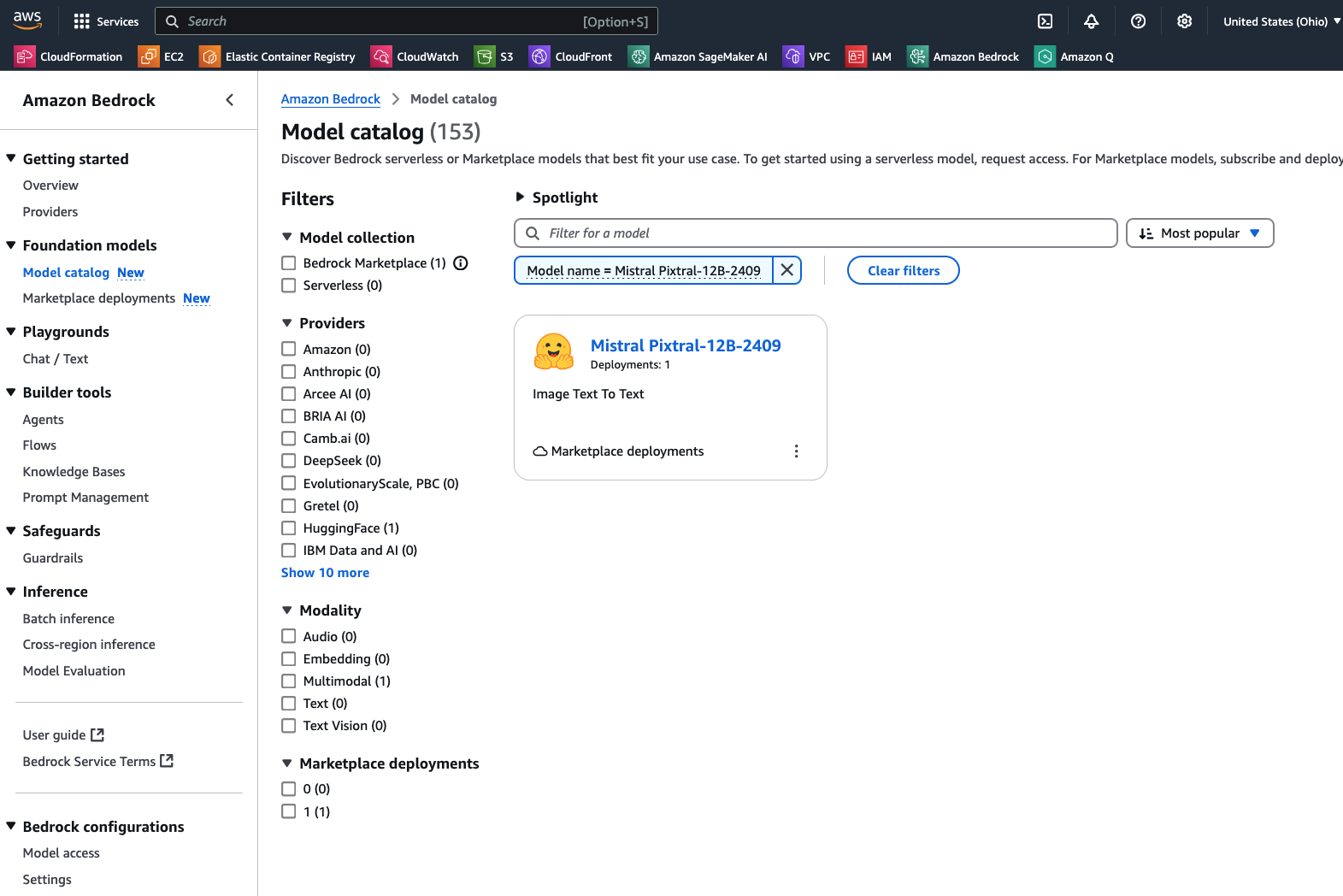

Pixtral 12B, найсучасніший ШНМ Mistral AI з 12 мільярдами параметрів, чудово справляється з текстовими та мультимодальними завданнями, доступний на Amazon Bedrock Marketplace. Нова архітектура моделі забезпечує високопродуктивне розуміння зображень і документів, перевершуючи відкриті моделі в різних тестах.

Реакція, згенерована штучним інтелектом, наполягає на тому, що ШІ демократизує сторітелінг, протиставляючи аргумент LA Times як «лівоцентристський». Співдиректори Альянсу архівних продюсерів висловлюють занепокоєння щодо генеративних інструментів ШІ в кіноіндустрії.

Адміністрація Трампа звільняє 6 700 працівників Податкової служби під час податкового сезону, що спричиняє хаос. Порушення роботи ШІ матиме далекосяжні наслідки, які не обмежаться лише звільненням працівників податкової служби.

МКП закликає посилити захист авторських прав та ШІ, щоб запобігти експлуатації креативних індустрій технологічними босами. Профспілки наголошують на необхідності належного захисту працівників перед обличчям технологічного прогресу.

Нова книга Карпа та Заміської досліджує ШІ, національну безпеку та вплив Кремнієвої долини. Співзасновник компанії Palantir, Карп має багатий досвід та зв'язки, що викликають інтригу в технологічній індустрії.

Професор Ендрю Моран та доктор Бен Вілкінсон обговорюють розвиток штучного інтелекту в університетських есе, кидаючи виклик традиційним джерелам знань. «Тіндерфікація» знань змінює суспільний дискурс і підриває критичне мислення.

Вільям Бойд прогнозує хвилю спін-оффів про Джеймса Бонда після того, як Amazon придбає права на франшизу. Він очікує, що з'являться романи, написані штучним інтелектом, тематичні парки тощо.

Професор Вандербільта вчить сина використовувати ChatGPT і Dall-E для практичного застосування ШІ, трансформуючи повсякденні завдання та навчання. Син Уайта тепер вправно інтегрує штучний інтелект у повсякденне життя - від створення ігор до перевірки фактів у Книзі рекордів Гіннеса.

Експерт Sky Sports похвалив за точну оцінку махінацій з Трофеєм чемпіонів в Індії. Говорити правду в спортивних коментарях вважається революційним, що підкреслюється пристрасною подачею матеріалу на камеру.

Amazon Bedrock пропонує високопродуктивні FM-приймачі для генеративних додатків ШІ. Claude Sonnet 3.5 LLM від Anthropic покращує навички вирішення проблем та критичного мислення для працівників сфери знань.

Інструмент генерації відео Sora від OpenAI викликає дебати про авторські права у Великій Британії, оскільки Бібан Кідрон наголошує на важливості навчальних даних. Зіткнення між технологічними та креативними індустріями загострюється через те, що фірми, які займаються АІ, використовують роботи художників без дозволу.

Двоє австралійців заарештовані в рамках глобальної операції з розповсюдження згенерованих штучним інтелектом зображень насильства над дітьми. 25 осіб заарештовано в рамках розслідування сексуальної експлуатації дітей.