В результаті «людської помилки» з компанії Anthropic стався витік внутрішніх файлів, зокрема вихідного коду для Claude Code, що призвело до стрімкого поширення на GitHub проектів нових продуктів штучного інтелекту. Anthropic подала вимоги про видалення контенту з порушенням авторських прав, щоб обмежити поширення викраденого коду, що привернуло мільйони переглядів.

Досвідчений телевізійний продюсер Майкл Патрік Кінг разом із співавтором Лізою Кудроу відроджує культовий ситком «Повернення», досліджуючи можливості штучного інтелекту у написанні сценаріїв. Унікальне поєднання гумору та драми у серіалі зачаровує глядачів, коли Валері Черіш намагається впоратися з викликами слави та стосунків.

Книга Ліз Трус «Десять років, щоб врятувати Захід» викликала бурхливу реакцію ЗМІ, але за перший тиждень у Великій Британії було продано лише 2 228 примірників. Ажіотаж навколо нової книги Метта Гудвіна порівнюють із культурною битвою, від якої залежить дуже багато.

Видавництво Penguin Random House подало позов проти OpenAI за те, що ChatGPT скопіювало серію книг «Кокос — маленький дракон». Позов подано до суду в Мюнхені.

Газета «Нью-Йорк Таймс» припинила співпрацю з журналістом, який, подібно до «Гардіан», використовував штучний інтелект для написання рецензій на книги. Алекс Престон визнав, що припустився «серйозної помилки», після того як читач виявив схожість у рецензіях.

Професор Рубен Саакян та професорка Шейла Роуен критикують підхід Британського агентства з досліджень та інновацій до фінансування Ради з наукових і технологічних об’єктів, звертаючи увагу на раптове припинення успішної ініціативи «Квантові технології для фундаментальної фізики» без чіткого плану заміни або належних консультацій. Втрата молодих науковців, підготовлених у стратегічно важливій г...

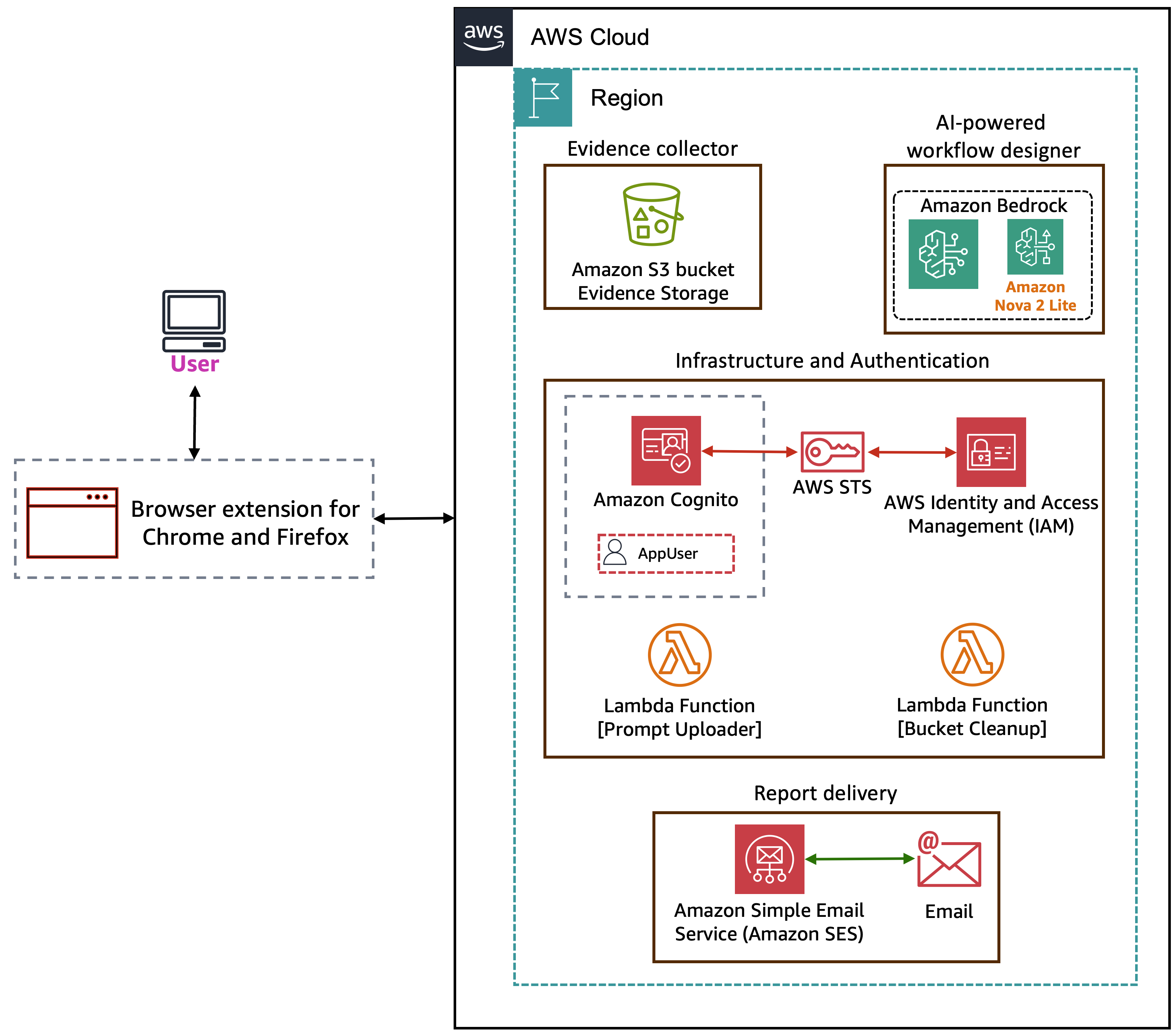

Автоматизуйте аудити відповідності вимогам за допомогою автоматизації дій у браузері з використанням Amazon Bedrock та Amazon Nova 2 Lite. Знімайте знімки екрана, аналізуйте документи та створюйте робочі процеси без зайвих зусиль.

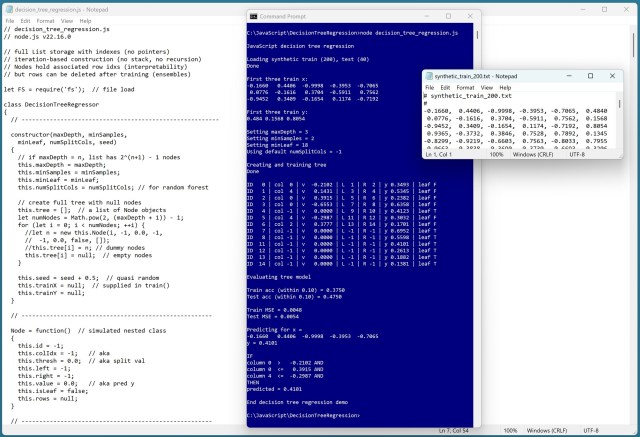

Регресія на основі дерева рішень прогнозує значення на основі правил «якщо-то» у вигляді деревоподібної структури. Ця реалізована на JavaScript модель мінімізує дисперсію та забезпечує високу точність прогнозування синтетичних даних.

16-річний Лука Челла Уокер перед смертю звернувся до ChatGPT за порадою щодо самогубства. Трагічний випадок із учнем приватної школи підкреслює небезпеку, яку становлять онлайн-чатботи.

Автори контенту хвалять смарт-окуляри Meta з вбудованою камерою, тоді як скептики називають їх «окулярами для збоченців». Користувачі взаємодіють з голосовим помічником на базі штучного інтелекту, озвученим Джуді Денч, який надає поради та інформацію, що викликає сумніви щодо необхідності ще одного високотехнологічного пристрою для носіння.

Компанія OpenAI, оцінювана в 850 млрд доларів, відчуває тиск з боку ринку щодо вдосконалення своєї бізнес-моделі з метою можливого виходу на IPO. Інвестиції цього гіганта у сфері штучного інтелекту в інфраструктуру на суму 600 млрд доларів до 2030 року свідчать про перехід до стратегічної дисципліни.

AWS представляє агенти Frontier, зокрема AWS Security Agent, які трансформують тестування безпеки та усунення інцидентів завдяки автономним можливостям штучного інтелекту. Ці агенти працюють автономно, скорочуючи тривалість тестування з тижнів до годин та сприяючи швидшому усуненню інцидентів, що революціонізує безпеку додатків та операційну ефективність.

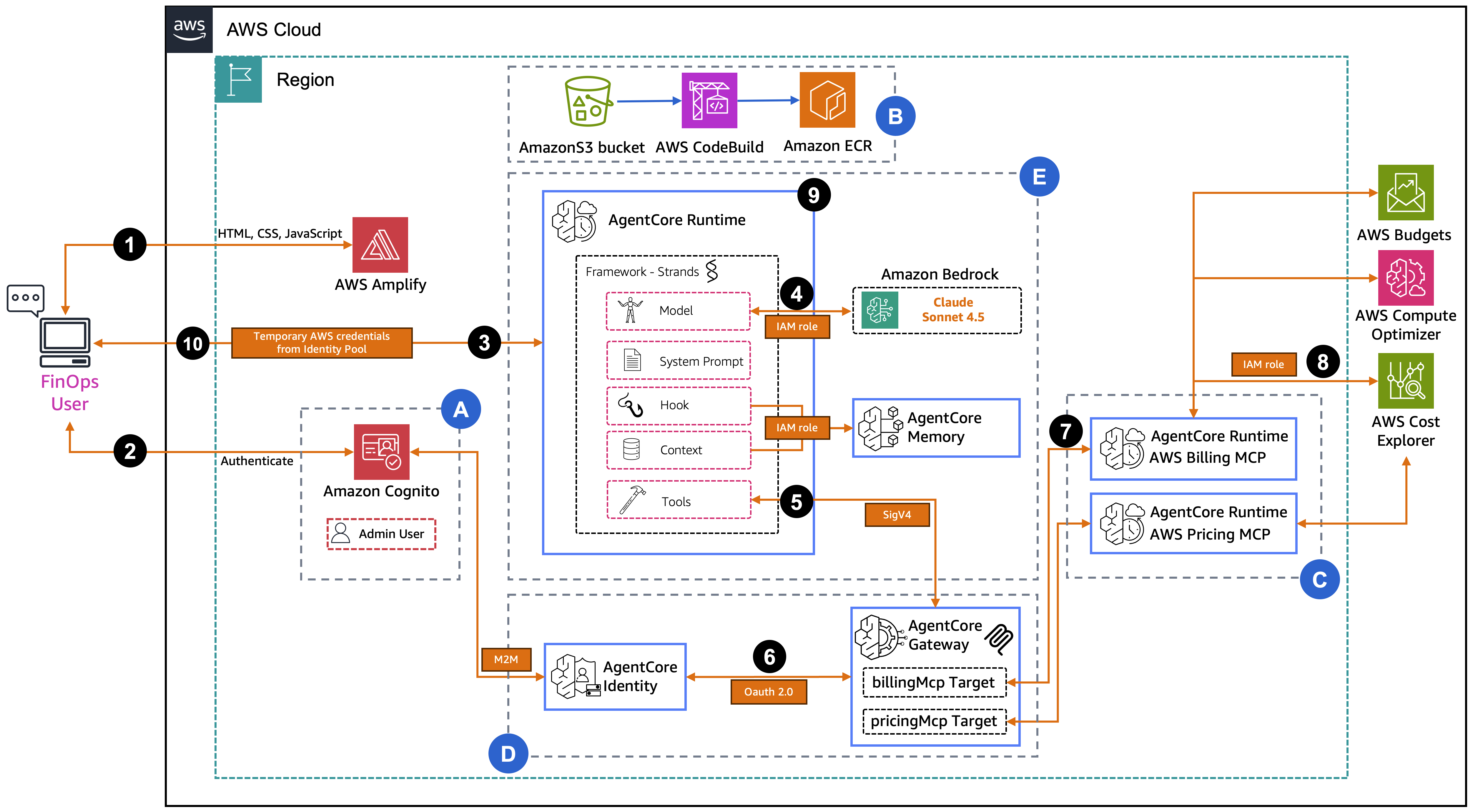

Створіть агент FinOps за допомогою Amazon Bedrock AgentCore для консолідації даних про витрати в AWS. Запити природною мовою та збереження даних у пам’яті спрощують управління витратами в декількох облікових записах.

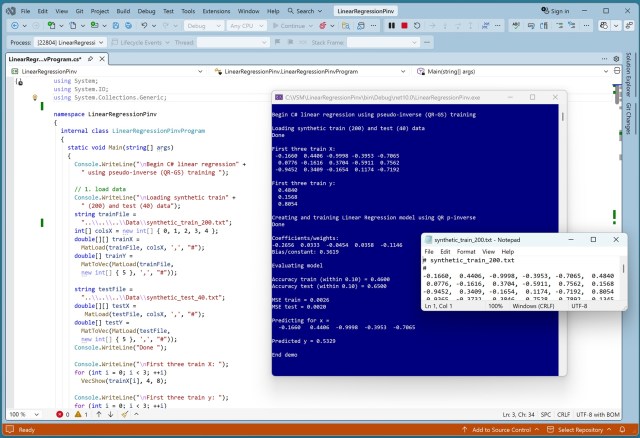

Лінійна регресія — це ключовий метод машинного навчання для прогнозування числових значень із використанням ваг та зміщення. Методи навчання включають стохастичний градієнтний спуск та псевдообернену матрицю, отриману за допомогою SVD або QR-розкладу, кожний із яких має різну складність та ефективність.

Дослідники з Массачусетського технологічного інституту (MIT) розробили модель штучного інтелекту для неінвазивної класифікації та кількісної оцінки дефектів у матеріалах, що дозволяє підвищити експлуатаційні характеристики продукції. Модель здатна одночасно виявляти до шести типів дефектів, забезпечуючи інженерам і виробникам більш повне уявлення про стан матеріалів.