Главный экономист ВТО предупреждает, что влияние войны в Иране на цены на энергоносители и удобрения представляет собой основной риск для мировой экономики. Высокие цены на нефть могут повлиять на бум в сфере искусственного интеллекта.

Новая функция Amazon Alexa+ придает устройствам индивидуальность, чтобы вновь заинтересовать британцев. Этот голосовой помощник стремится быть передовым решением, а не просто таймером.

Калифорнийский стартап Memvid предлагает 800 долларов за то, чтобы «задира» с помощью ИИ выявил несоответствия в работе чат-бота. Задача состоит в том, чтобы провоцировать ИИ на конфликты, чтобы проверить его память и терпение.

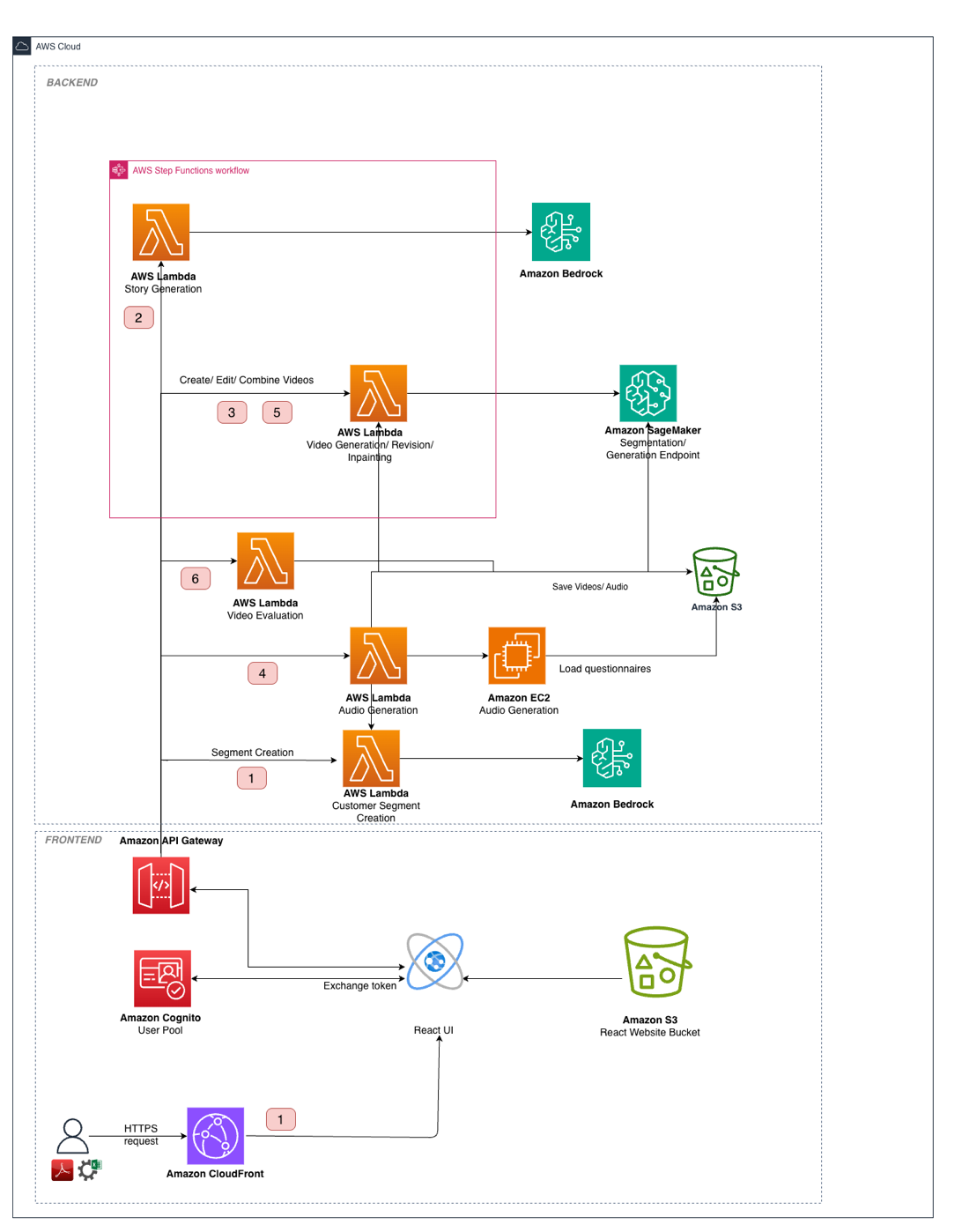

Компании Bark.com и AWS совместно сократили время производства видеоконтента с нескольких недель до нескольких часов с помощью Amazon SageMaker. Это решение на базе искусственного интеллекта позволило повысить качество и степень персонализации рекламы в социальных сетях, продемонстрировав при этом универсальный подход к созданию контента.

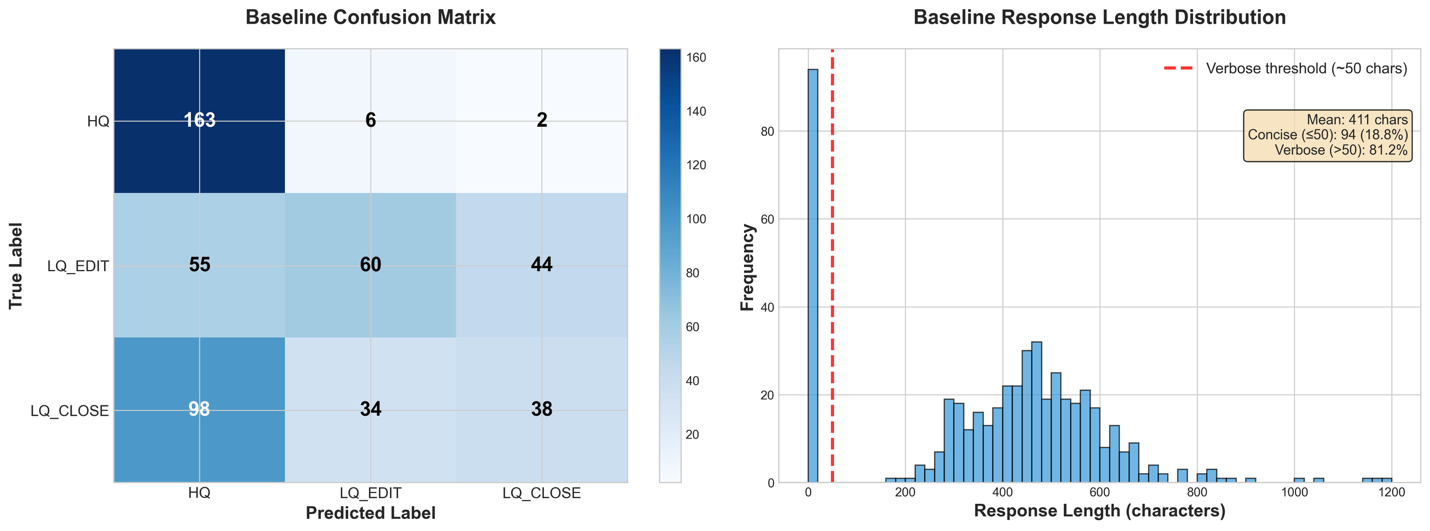

Nova Forge SDK упрощает настройку языковых моделей, обеспечивая удобный переход между платформами. В примере из практики демонстрируется автоматическая классификация вопросов на Stack Overflow с помощью Amazon Nova Forge SDK, что позволяет повысить качество оценки публикаций.

Искусственный интеллект меняет характер офисной работы в США, затрагивая как преподавателей, так и сотрудников Amazon. В новом выпуске программы «TechScape» также рассматриваются «фантомные» центры обработки данных в Великобритании.

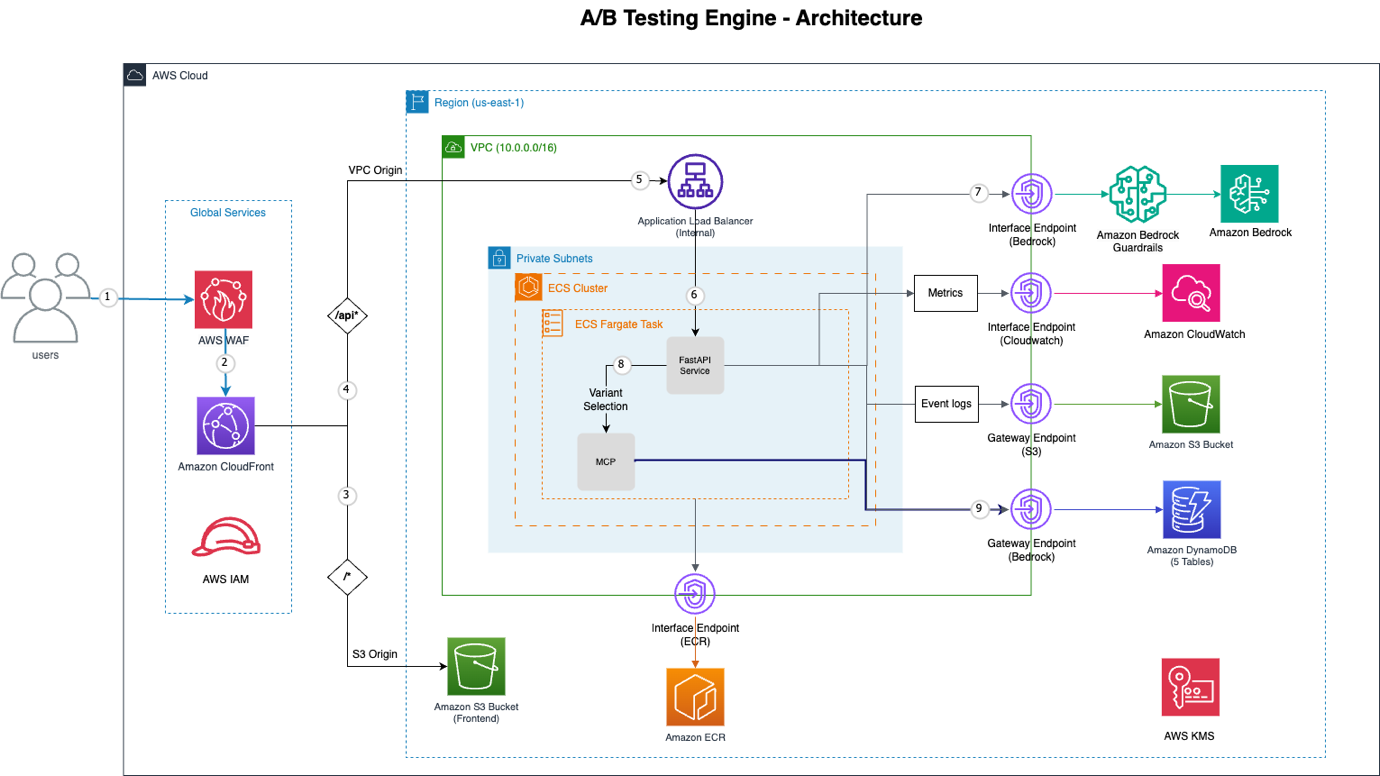

Традиционное A/B-тестирование может быть медленным и неэффективным, однако A/B-тестирование на базе искусственного интеллекта с использованием Amazon Bedrock, Elastic Container Service и DynamoDB позволяет анализировать контекст пользователя для принятия более обоснованных решений, сокращая количество ложных срабатываний и быстрее выявляя надежные варианты. Благодаря использованию контекста по...

ИИ может стать ценным инструментом для генерации идей, но пользователям следует полагаться на собственное суждение. Треть взрослого населения США уже пользуется ChatGPT, причем за последние два года количество пользователей в возрасте до 30 лет удвоилось.

Модели Amazon Nova 2 обеспечивают улучшенные возможности логического мышления и использования инструментов, а версия Nova 2 Lite отличается повышенной точностью и более быстрым временем отклика. Переход на Nova 2 Lite на платформе Amazon Bedrock открывает доступ к более разнообразным возможностям обучения, расширенным функциям логического мышления и средствам интерпретации кода, что позволяет ...

Правительство Великобритании пошло на уступки в отношении использования компаниями, занимающимися искусственным интеллектом, произведений, защищенных авторским правом, без разрешения, после резкой критики со стороны художников. Министр по вопросам технологий Лиз Кендалл объявила, что у правительства больше нет «предпочтительного варианта» реформы авторского права.

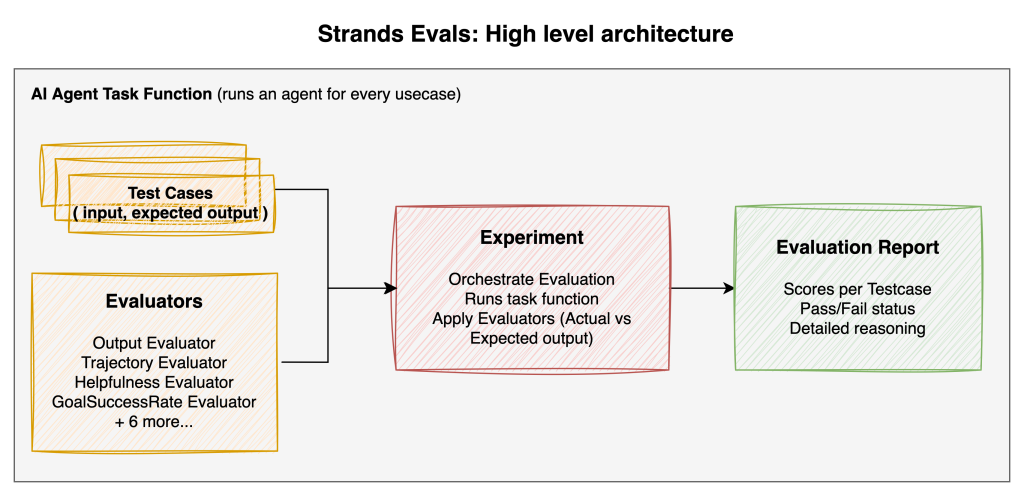

Традиционные методы тестирования сталкиваются с трудностями при оценке агентов искусственного интеллекта из-за их недетерминированной природы. Strands Evals предлагает структурированную платформу для систематической оценки, включая многоходовую симуляцию и оценку на основе языковых моделей.

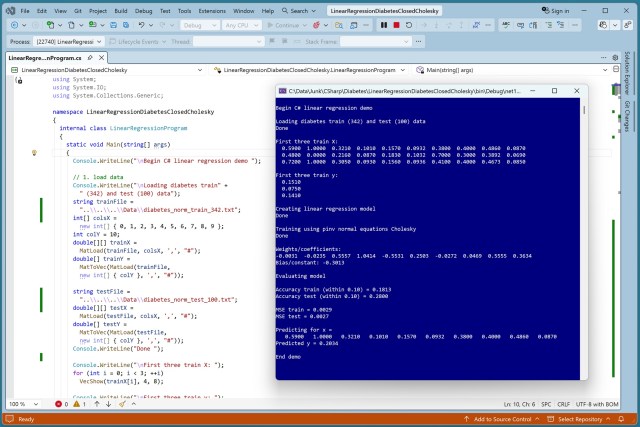

К набору данных по диабету была применена модель линейной регрессии с низкой точностью, которая послужила базовым вариантом для сравнения с другими методами регрессии. Модель, реализованная на языке C#, продемонстрировала точность всего 18,13 % на обучающих данных и 28,00 % на тестовых данных.

Умерший голливудский актёр Вэл Килмер будет «воскрешён» с помощью искусственного интеллекта в готовящейся драме «As Deep As the Grave» при поддержке его наследников. Килмер должен был сыграть главную роль в этом фильме, но скончался от рака горла в возрасте 65 лет.

Правительство Великобритании выделяет 1 млрд фунтов стерлингов на разработку квантовых компьютеров для различных отраслей, стремясь предотвратить «утечку мозгов» в США в гонке за лидерство в области искусственного интеллекта. Лиз Кендалл подчеркивает важность удержания специалистов в области квантовых технологий, чтобы не уступать конкурентам.

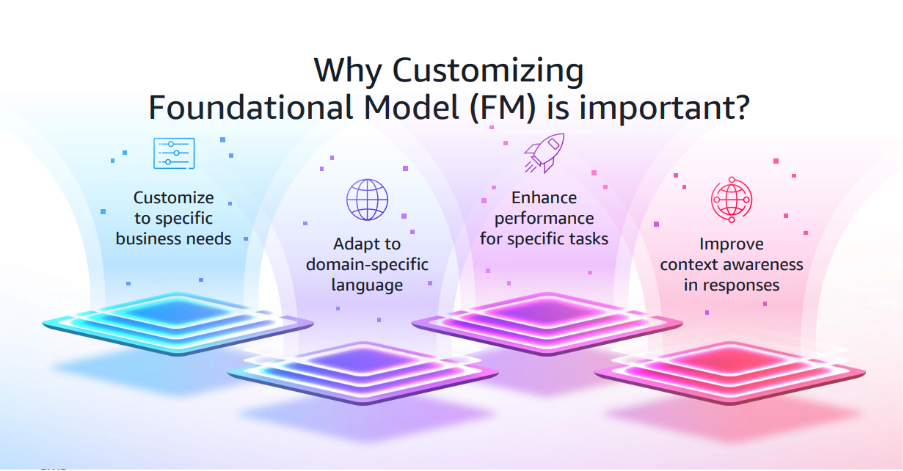

Компания Atos сотрудничает с AWS с целью развития навыков в области искусственного интеллекта посредством практического обучения с элементами геймификации в рамках программы AWS AI League, что способствует ускоренному освоению практических навыков и их применению в реальных условиях. Участники занимаются настройкой крупных языковых моделей, чтобы приобрести практический опыт и содействовать вн...