Amazon Bedrock Custom Model Import дозволяє безперешкодно інтегрувати налаштовані моделі, такі як Llama, Mistral і Qwen, з безсерверним досвідом і автоматичним масштабуванням. Підтримка ймовірності логарифму покращує оцінку моделі, оцінку надійності та методи фільтрування, надаючи інформацію про поведінку моделі для вдосконалення додатків штучного інтелекту.

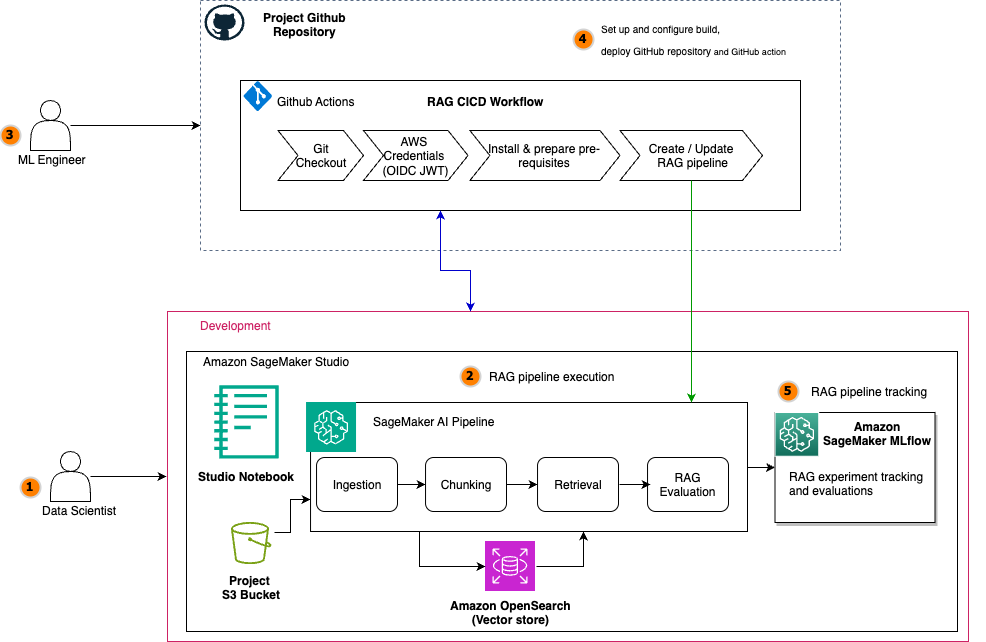

Розробка RAG передбачає тестування численних конфігурацій, що ускладнює ручне управління. Штучний інтелект Amazon SageMaker оптимізує життєвий цикл RAG, покращуючи співпрацю та оперативну ефективність.

Прем'єр-міністр Албанії Рама представляє Diella, цифрового помічника для боротьби з корупцією в державних тендерах. Diella, перший міністр кабінету міністрів з штучним інтелектом, допомагає користувачам орієнтуватися в державних онлайн-сервісах за допомогою голосових команд.

Виявлення об'єктів з відкритим набором (OSOD) покращує аналіз відео в реальному світі, виявляючи як відомі, так і невідомі об'єкти, адаптуючись до визначених користувачем цілей без повторного навчання. Amazon Bedrock Data Automation використовує OSOD для вилучення інформації з відеоконтенту, підтримуючи виявлення на рівні кадрів і настроюваний вивід для точності.

У статті висвітлюється метод регресії ядра (KRR) для прогнозування числових значень. KRR використовує функцію ядра для вимірювання схожості даних, з опціями навчання, що включають обернену матрицю ядра та стохастичний градієнтний спуск (SGD).

Оцінювачі штучного інтелекту стикаються з важкими умовами, низькою оплатою праці та нечіткими завданнями під час навчання чат-ботів. Робота Рейчел Сойєр як аналітика з написання текстів перетворилася на оцінювання контенту, створеного штучним інтелектом для Google Gemini.

Стюарт Макінес закликає криміналізувати створення контенту за допомогою штучного інтелекту без розкриття інформації, щоб боротися з дипфейками. Маркус Бірд попереджає про підрив довіри суспільства у зв'язку з поширенням складних технологій створення дипфейків.

Співзасновник ChatGPT Сем Альтман пропонує, щоб компанія повідомляла владу, коли користувачі обговорюють самогубство, що потенційно може врятувати життя. Щотижня до 1500 людей можуть довіряти боту свої таємниці перед тим, як покінчити з життям.

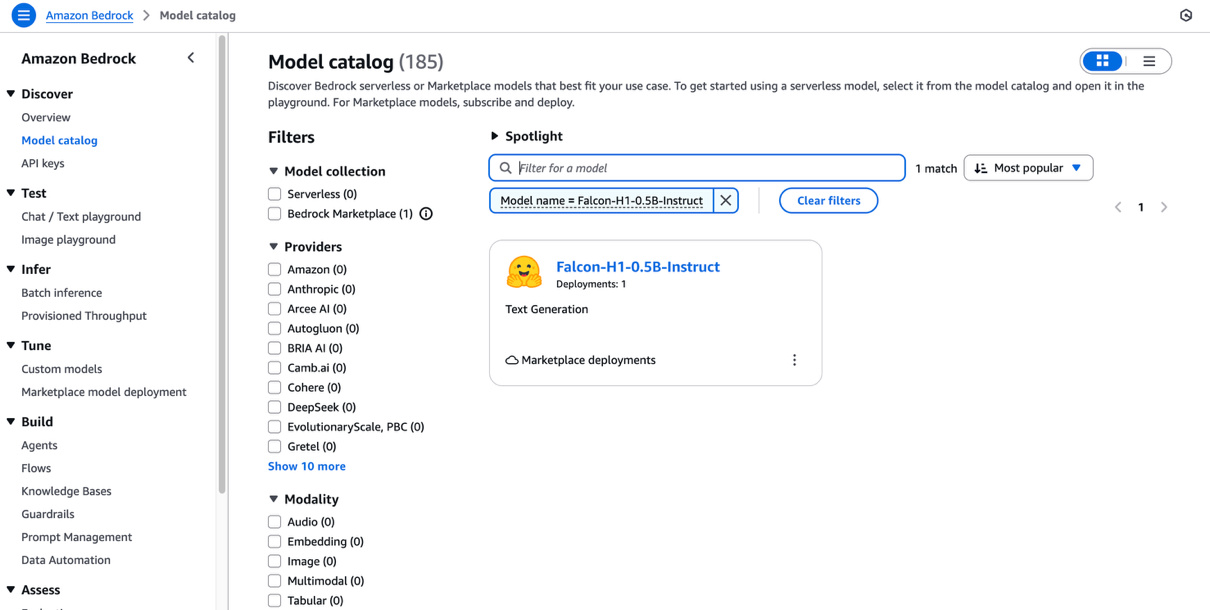

Моделі Falcon-H1 від TII тепер доступні на Amazon Bedrock Marketplace та SageMaker JumpStart, пропонуючи гібридну архітектуру для виняткової продуктивності штучного інтелекту. Співпраця між TII та AWS має на меті забезпечити ефективні генеративні програми штучного інтелекту в усьому світі за допомогою моделей серії Falcon-H1.

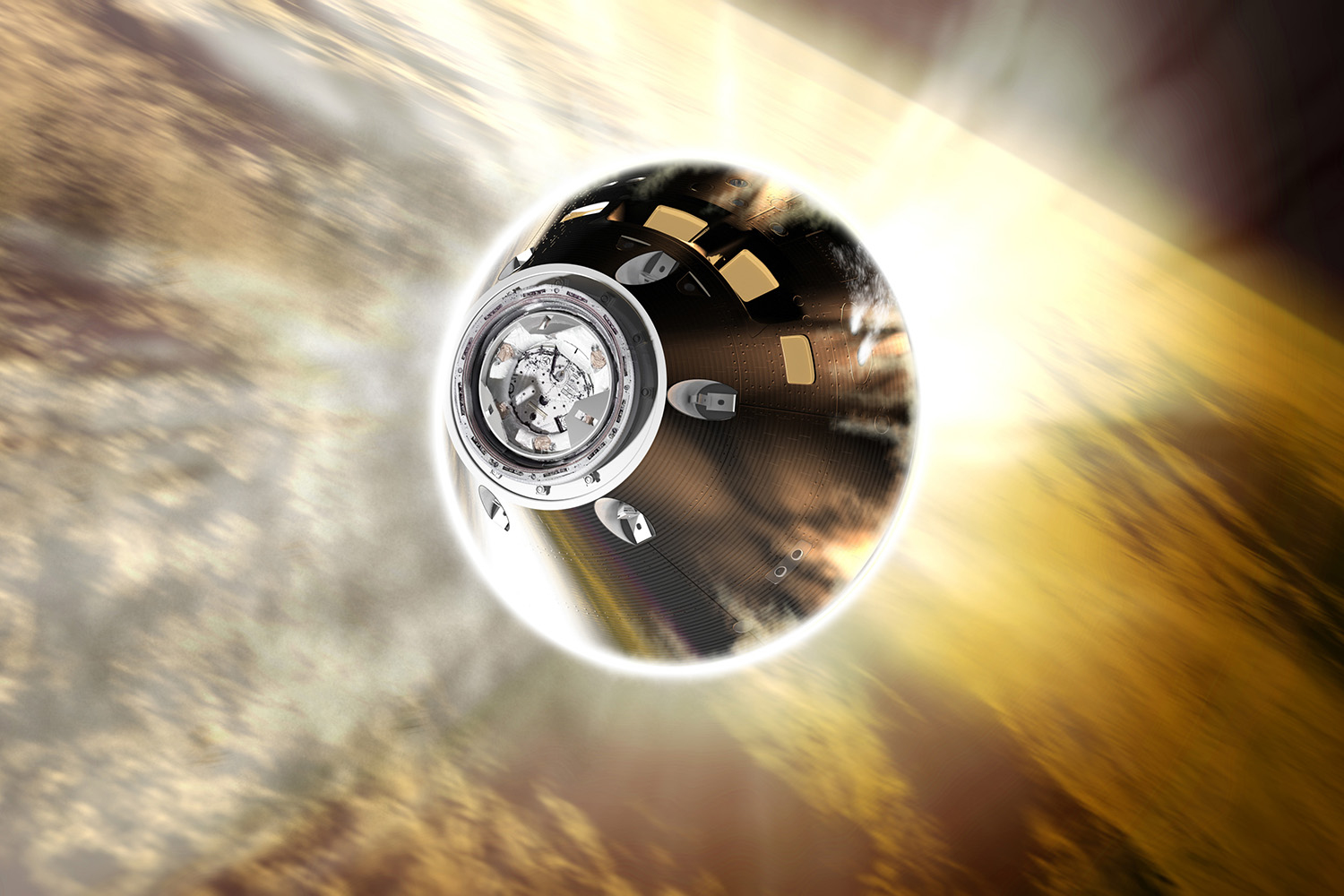

MIT обраний DOE/NNSA для створення CHEFSI, дослідницького центру, що спеціалізується на моделюванні екстремальних умов для національної безпеки та космічних досліджень. Використовуючи екзафлопні суперкомп'ютери, CHEFSI прагне вдосконалити прогнозне моделювання взаємодій рідини та твердого тіла з високою ентальпією для створення стійких інженерних систем.

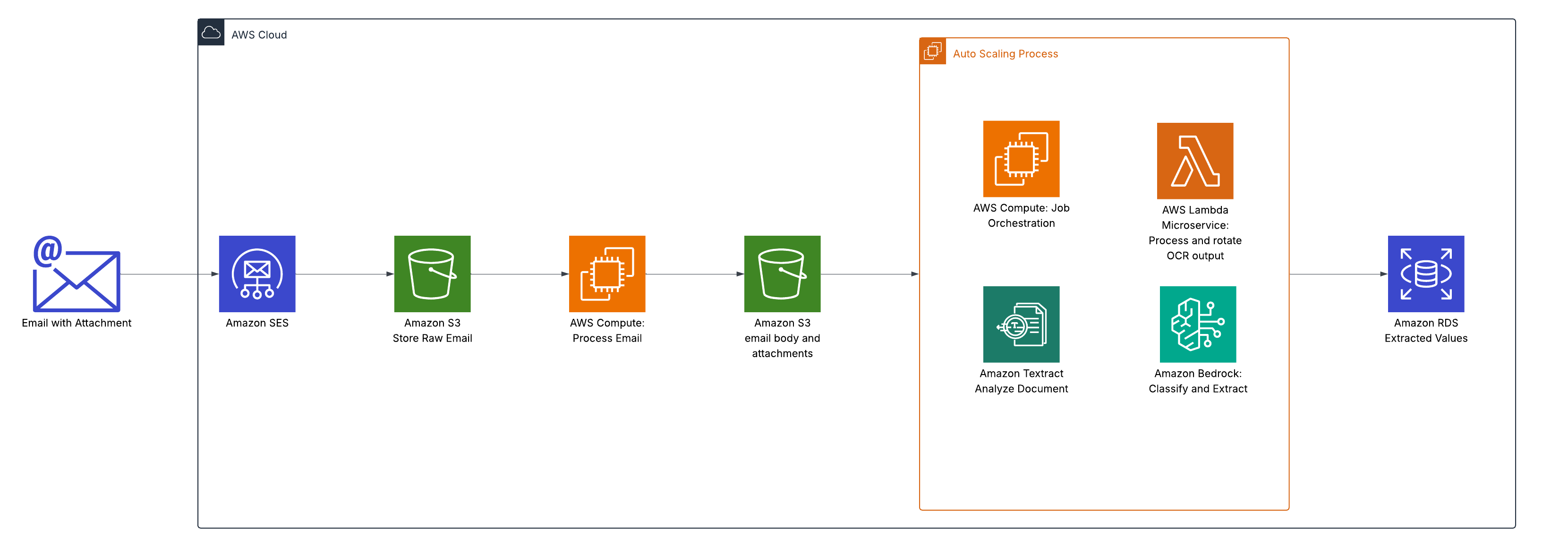

Oldcastle APG уклала партнерську угоду з AWS з метою оптимізації робочого процесу обробки документів за допомогою Amazon Bedrock та Amazon Textract. Завдяки автоматизації обробки 100 000–300 000 суднових квитків щомісяця компанія значно підвищила точність і зменшила обсяг ручної роботи, продемонструвавши масштабоване рішення для подібних завдань в області обробки документів.

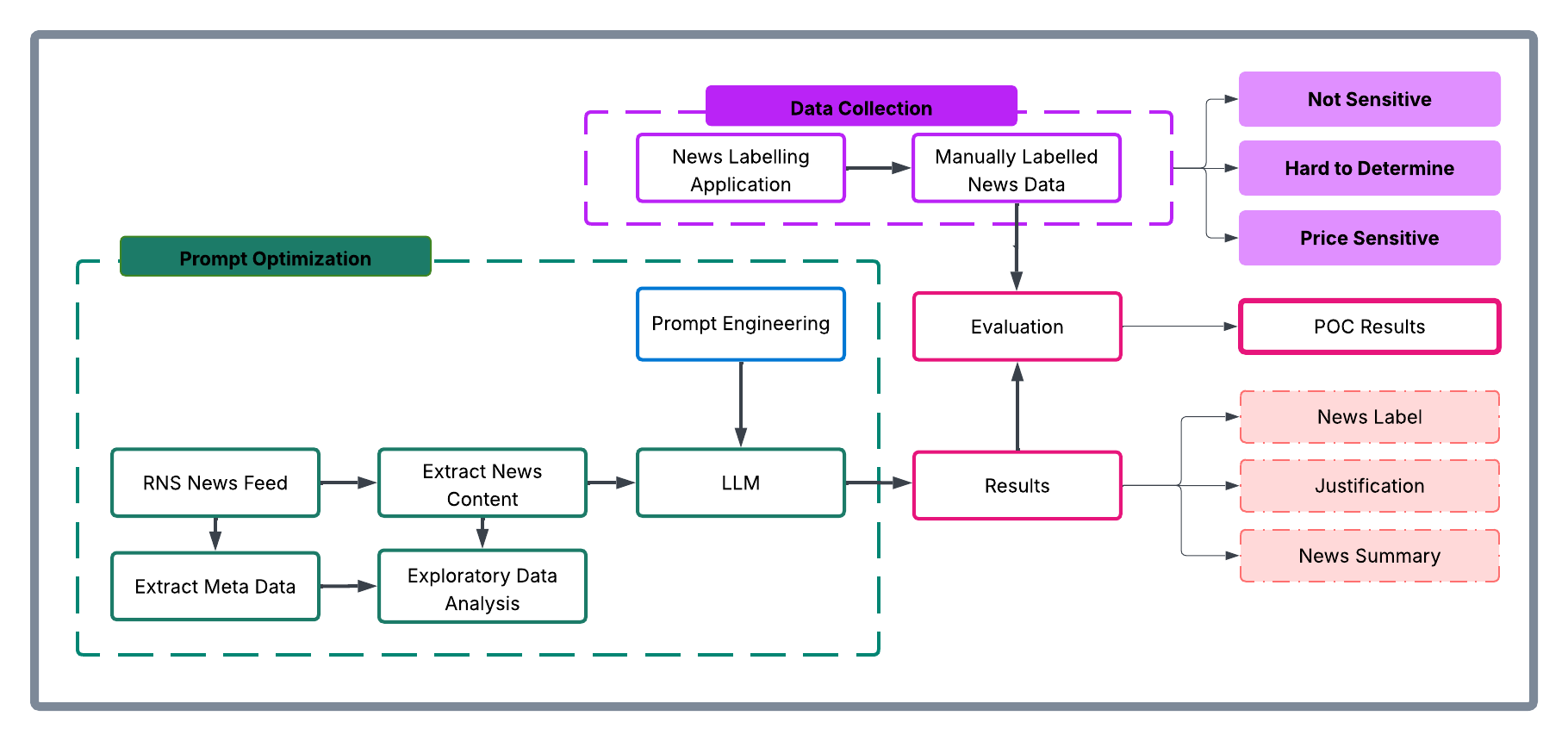

Лондонська фондова біржа (LSEG) використовує Amazon Bedrock для автоматизації ринкового нагляду, підвищуючи ефективність і точність. Наглядовий посібник LSEG, що працює на базі штучного інтелекту, аналізує чутливість новин для виявлення зловживань на ринку, покращуючи дотримання нормативних вимог.

Великомасштабні системи штучного інтелекту базуються на несанкціонованому використанні цифрового контенту, що загрожує демократії. Технологічні компанії стикаються з негативною реакцією за порушення конфіденційності та крадіжку авторських робіт.

Глибокі підробки, створені за допомогою штучного інтелекту, стають нормою в політиці, про що свідчать вірусні реп-відео з Анжелою Рейнер. Сатиричні пісні про політичних діячів, створені штучним інтелектом Crewkerne Gazette, набирають мільйони переглядів і привертають увагу всієї країни, викликаючи дискусії про вплив «штучного інтелекту-пропаганди» на онлайн-дискусії.

Віце-президент NVIDIA Алі Кані на виставці IAA Mobility акцентує увагу на штучному інтелекті «хмара-автомобіль», який переводить транспортні засоби з потужності коней на обчислювальну потужність. Комплексне рішення NVIDIA для автономного руху, включаючи систему безпеки Halos, встановлює нові стандарти в розробці транспортних засобів.