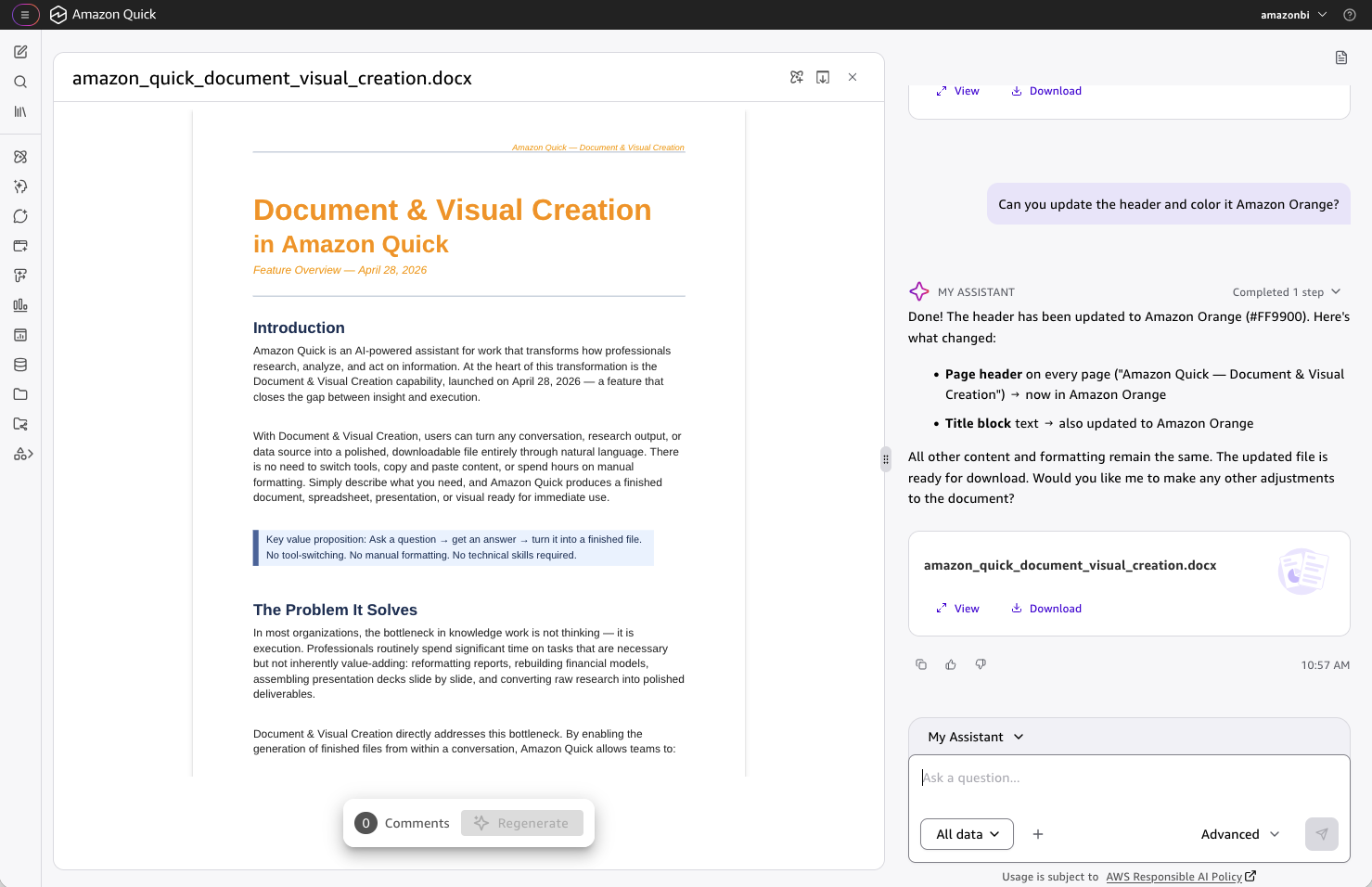

Amazon Quick позволяет специалистам создавать отформатированные документы и визуальные материалы на основе актуальных данных, что позволяет сэкономить время на рутинных задачах. Результаты могут быть выведены в форматах Word, Excel, PowerPoint, PDF, а также в виде бизнес-визуализаций, причем все они полностью доступны для редактирования, что позволяет продолжать работу без необходимости повтор...

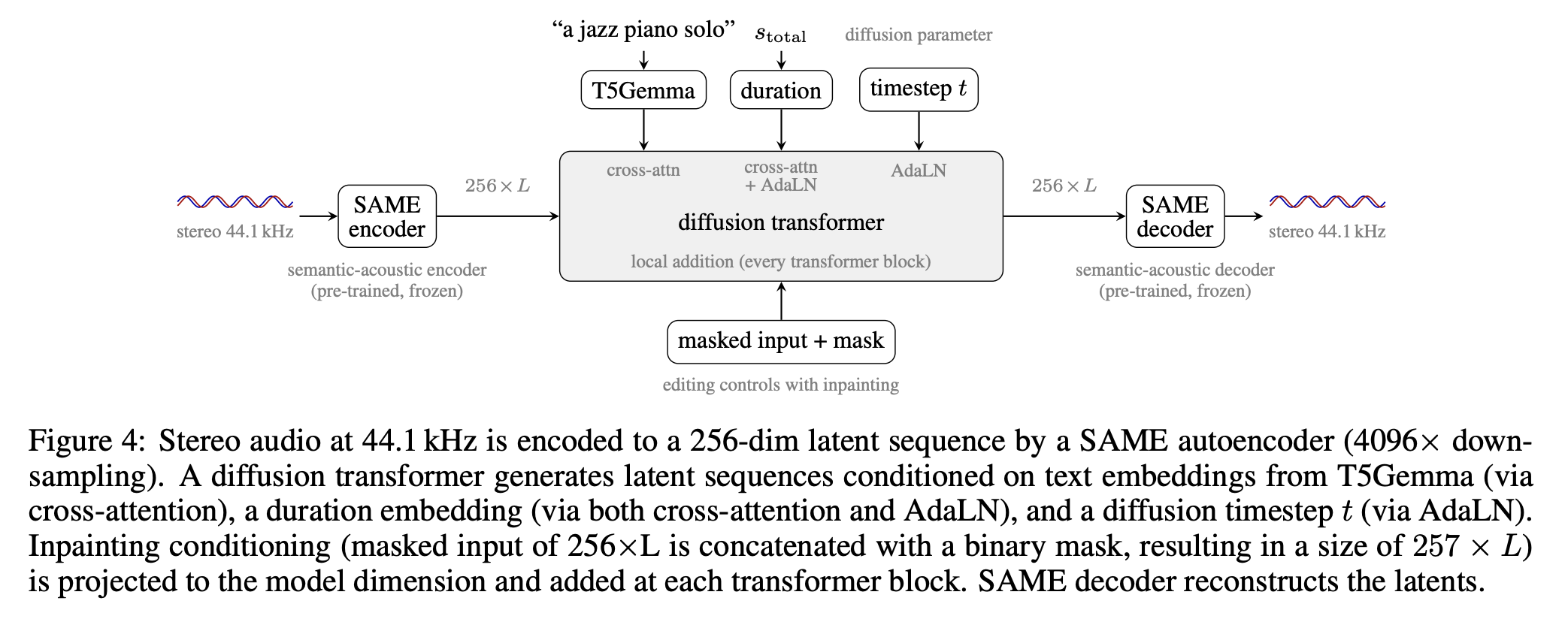

Компания Stability AI выпустила Stable Audio 3 с открытыми весами и техническим документом. Модели латентной диффузии поддерживают вывод данных переменной длины и редактирование на основе ретуширования для генерации стереозвука.

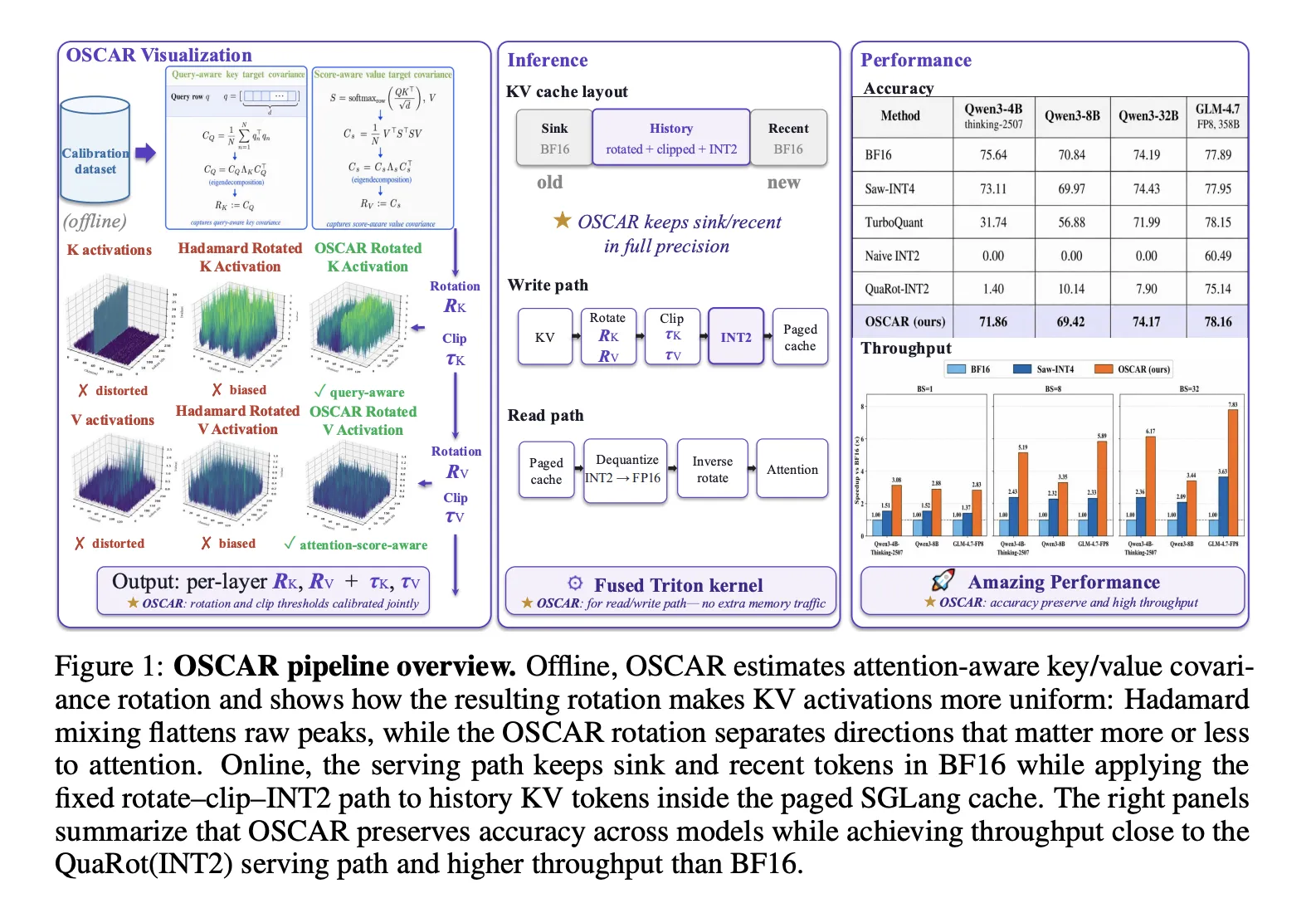

Кэш KV является значительной статьёй затрат при обслуживании больших языковых моделей (LLM); его сжатие с помощью квантования на основе поворотов, реализованного в OSCAR, повышает эффективность при точности INT2. OSCAR вычисляет повороты на основе статистики внимания, чтобы уменьшить ошибки квантования, что позволяет улучшить качество внимания и повысить производительность модели.

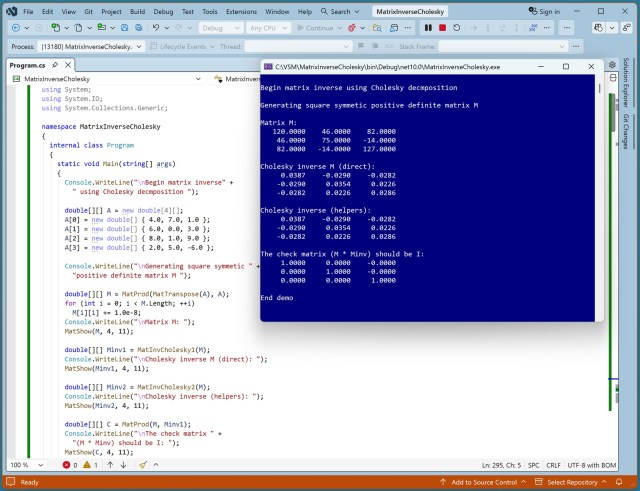

Разработка функции обратного матричного преобразования с использованием разложения Холески: более лаконичный код или более высокая эффективность. Анализ методов разработки программного обеспечения с использованием кода, сгенерированного ИИ, и дизайна персонажей в анимационных фильмах.

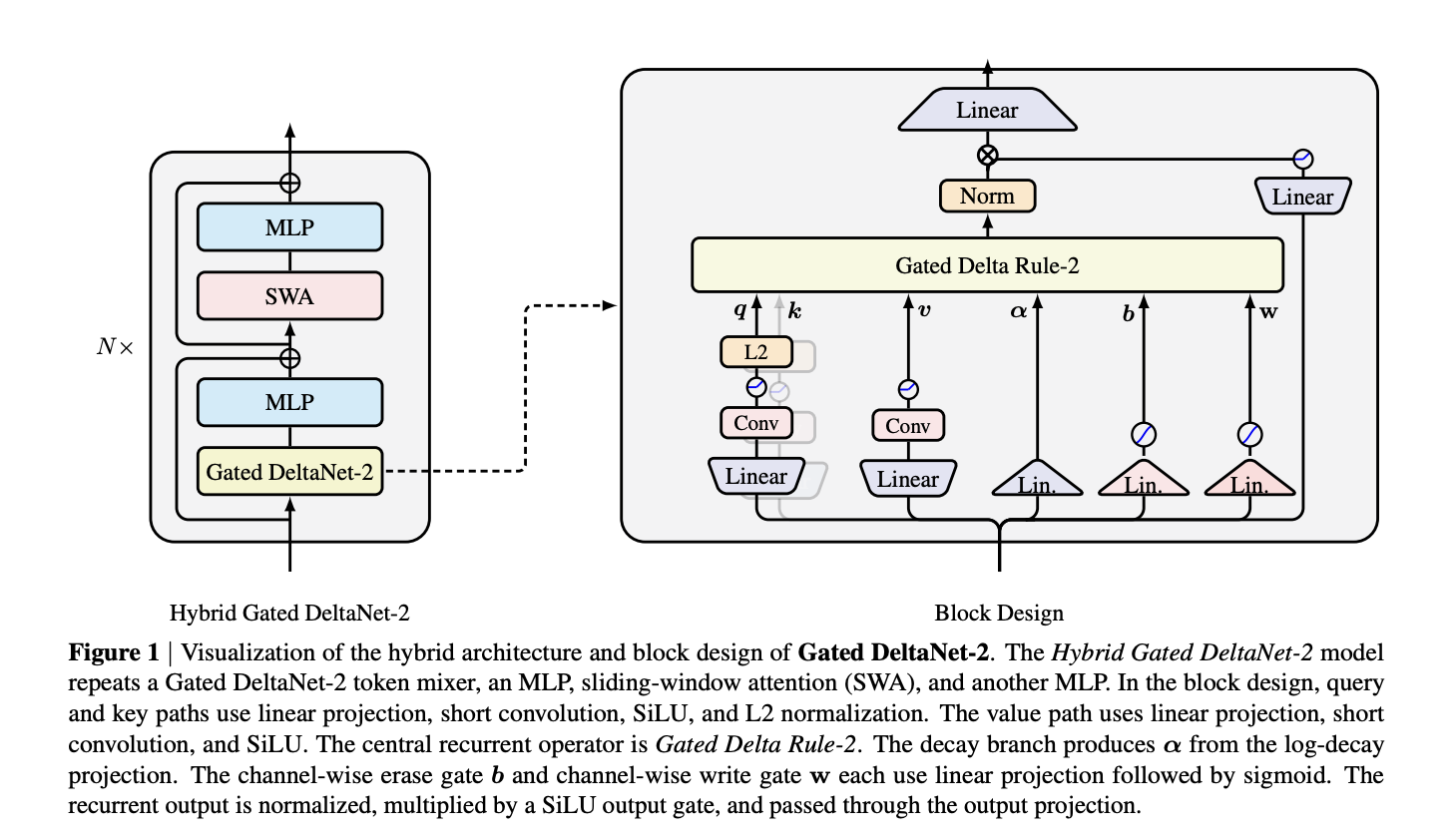

Компания NVIDIA представляет модель Gated DeltaNet-2 с линейным механизмом внимания, предназначенную для улучшения обработки данных в памяти. Модель оснащена двумя канальными гейтами и демонстрирует более высокую производительность по сравнению с предыдущими моделями в исследовательских тестах.

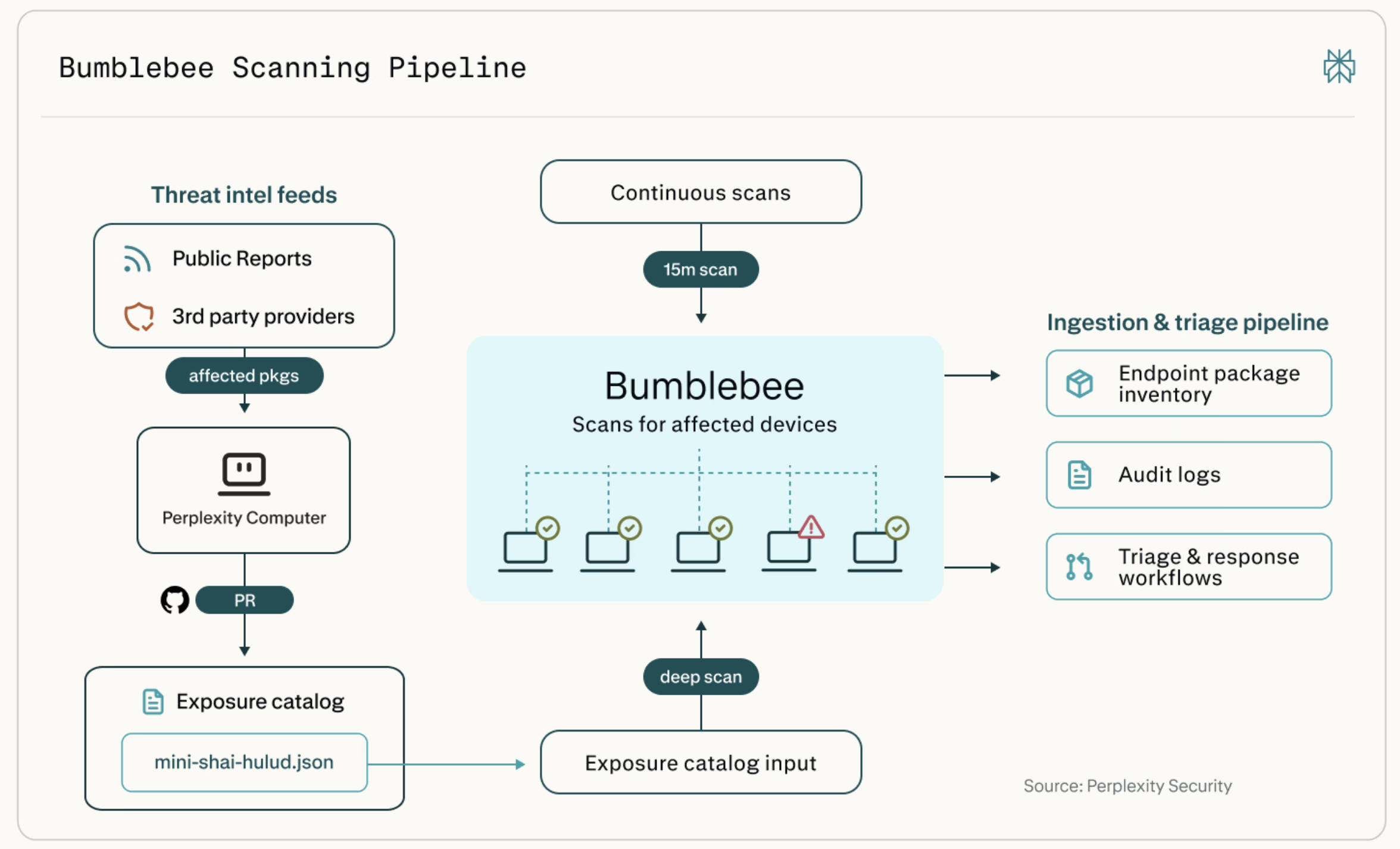

Инструмент Bumblebee от Perplexity сканирует рабочие станции разработчиков на наличие уязвимых пакетов, расширений и настроек инструментов искусственного интеллекта. Он восполняет пробел в существующих инструментах, проверяя локальную среду разработчика на наличие потенциальных угроз безопасности.

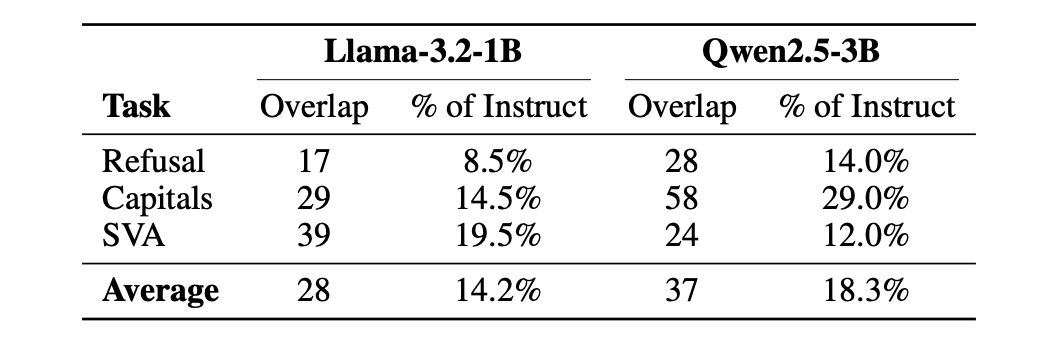

В новом исследовании команды Nous представлена модель CNA, позволяющая точно определять нейроны MLP, ответственные за «барьеры отклонения» в моделях с инструкциями. Удаление всего 0,1 % активаций MLP снижает частоту отклонений более чем на 50 % без ущерба для качества выходных данных.

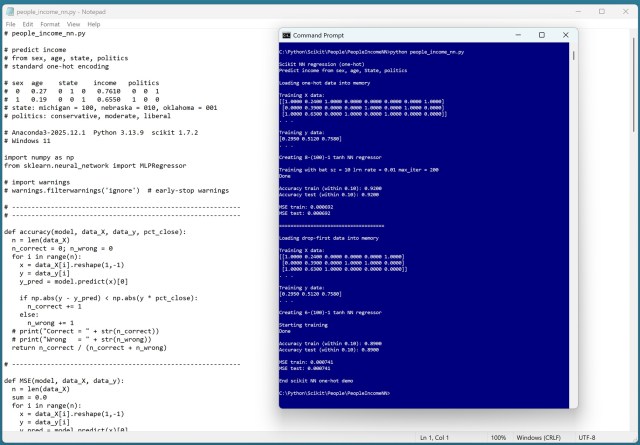

Для регрессоров нейронных сетей, работающих с категориальными данными, следует использовать кодирование «one-hot»; кодирование «drop-first» не является необходимым и оказывается несколько менее эффективным. Результаты демонстрации показывают, что нет оснований рассматривать кодирование «drop-first» для нейронных сетей, что подтверждает преимущества кодирования «one-hot».

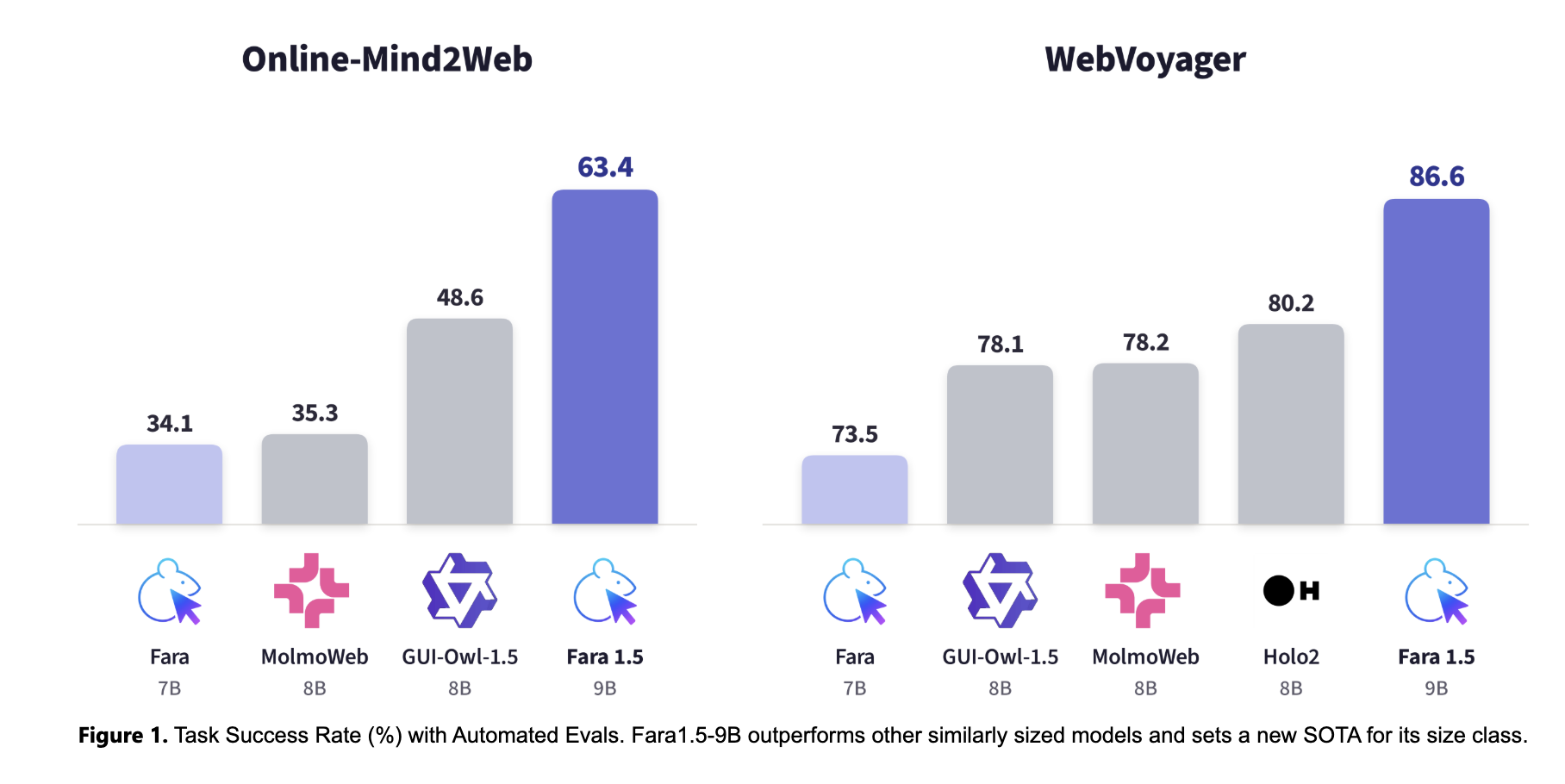

Лаборатория AI Frontiers компании Microsoft Research выпустила Fara1.5 — семейство моделей компьютерных агентов для браузеров, интегрированных с MagenticLite. Модель Fara1.5-27B демонстрирует 72 % успешности выполнения задач на наборе данных Online-Mind2Web, превосходя по результатам таких конкурентов, как Operator от OpenAI и Gemini 2.5 от Google.

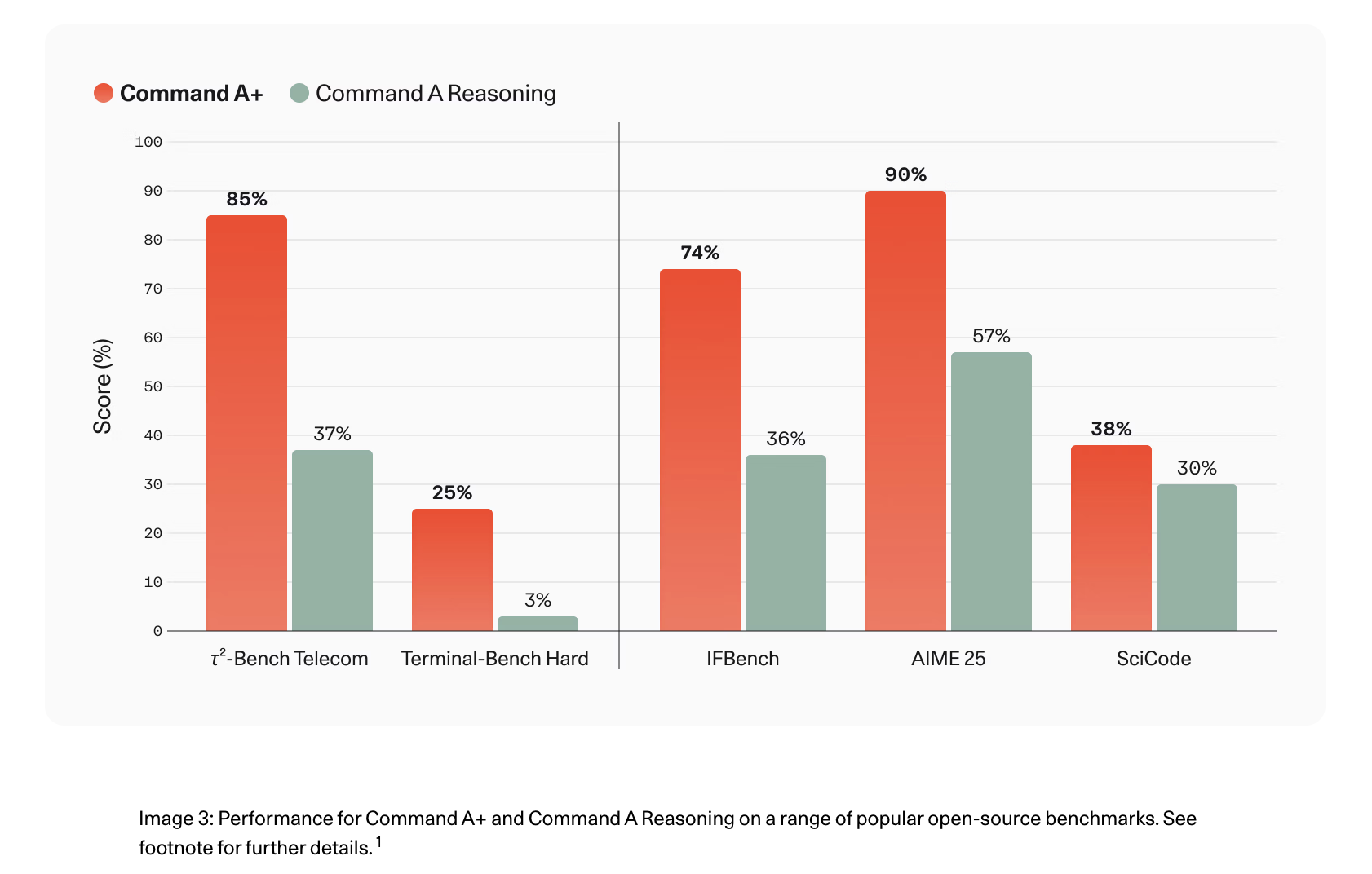

Command A+ от Cohere — это модель MoE с открытым исходным кодом, оптимизированная для агентных рабочих процессов и объединяющая в себе возможности четырёх предыдущих моделей. Благодаря наличию трёх вариантов квантования Command A+ демонстрирует значительное повышение производительности по сравнению с предыдущими моделями Command A при решении различных корпоративных задач.

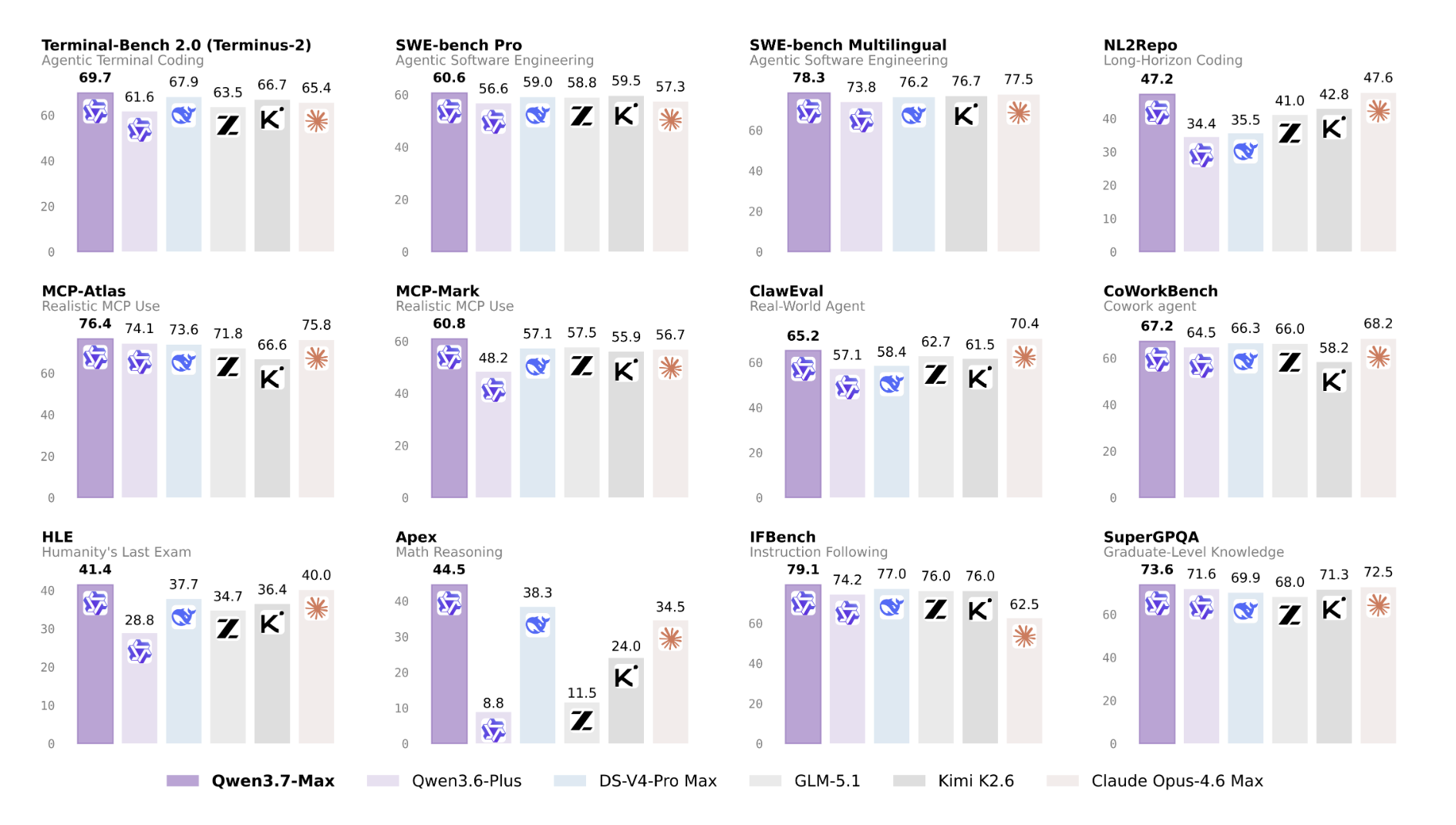

Alibaba представляет Qwen3.7-Max для выполнения автономных многоэтапных задач. Qwen3.7-Max предлагает режим расширенного мышления с контекстным окном объемом 1 млн токенов, что значительно повышает возможности модели в области логического мышления.

Исследование Массачусетского технологического института (MIT) под руководством Дэвида Аутора показывает, что новые формы занятости приносят пользу молодым, образованным людям, проживающим в городских районах. Государственные инвестиции стимулируют развитие инновационных форм занятости, создавая возможности для применения специализированных знаний.

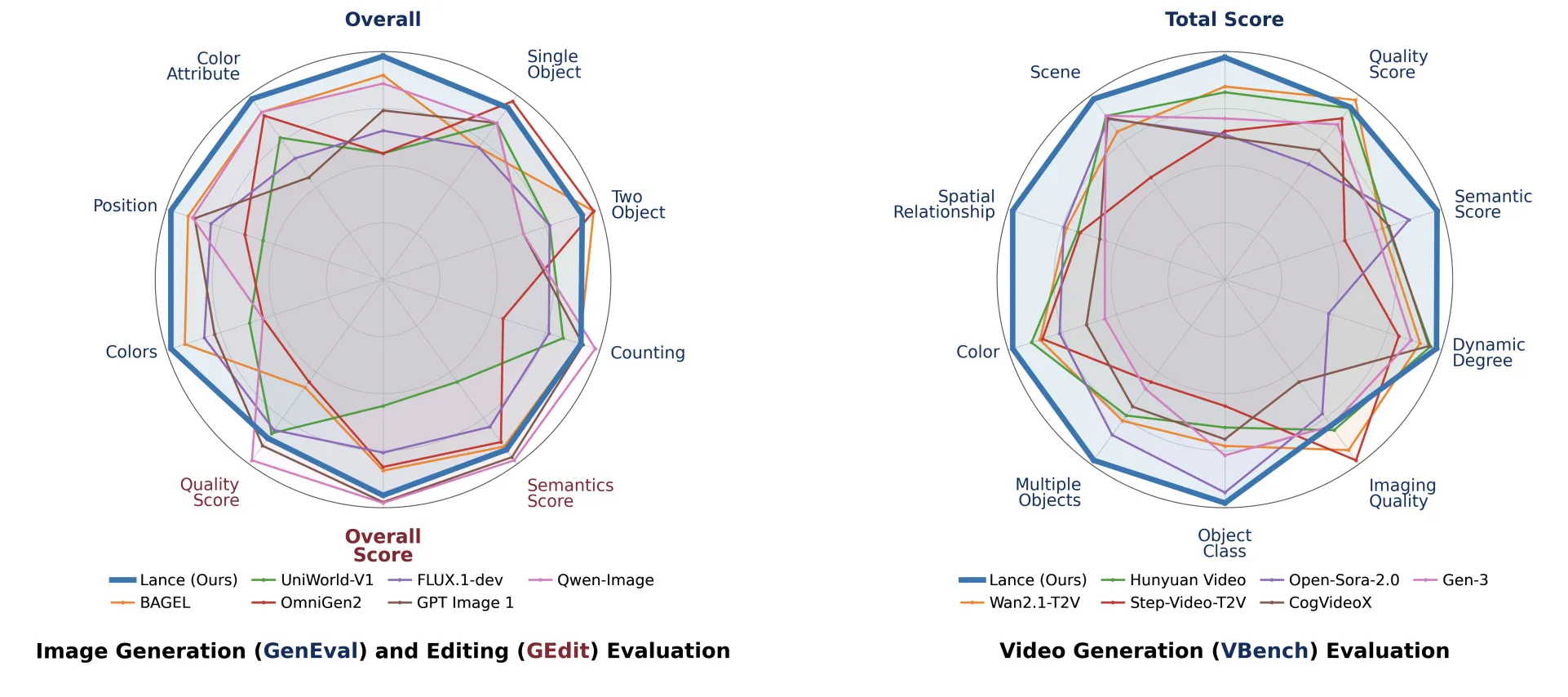

Lance от ByteDance объединяет в одной модели функции распознавания, генерации и редактирования изображений и видео, что стало важной вехой в развитии архитектуры искусственного интеллекта. Lance объединяет всю экосистему работы с изображениями и видео, выполняя задачи от создания подписей до многоэтапного редактирования с обеспечением согласованности в обоих форматах.

Компания NVIDIA блестяще выступила на выставке COMPUTEX 2026: суперкомпьютер Vera Rubin NVL72 на базе ИИ и платформа Jetson Thor получили высшие награды. Vera Rubin NVL72 устанавливает новые стандарты масштабируемости и экологичности в сфере ИИ, обеспечивая исключительную производительность и экономическую эффективность для приложений с автономным ИИ.

CopilotKit превращает искусственный интеллект в программном обеспечении из пассивного в активный, а AG-UI устраняет барьер между агентами и пользователями в приложениях. Такие крупные компании, как Google и AWS, активно внедряют этот протокол, что свидетельствует о его зрелости и готовности к использованию в производственной среде.