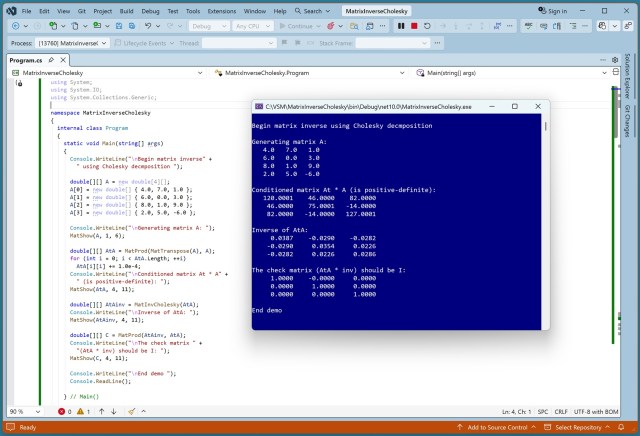

Існує безліч алгоритмів обернення матриць, що підкреслює складність цього процесу. Розклад Чолеського ідеально підходить для квадратних, симетричних, позитивно визначених матриць у сценаріях машинного навчання.

Губернатор штату Іллінойс Дж. Б. Пріцкер пропонує припинити податкові пільги для центрів обробки даних через негативну реакцію громадськості на ресурсоємні об'єкти, що забезпечують бум штучного інтелекту. Пропозиція, яка потребує схвалення законодавцями штату, була оприлюднена під час виступу Пріцкера про стан справ у штаті, як повідомляє NBC News.

Штучний інтелект рекламується як засіб скорочення робочого тижня, але дисбаланс сил може перешкоджати досягненню позитивних результатів. Компанії впроваджують штучний інтелект для кращого балансу між роботою та особистим життям.

Білл Гейтс відмовляється від участі в індійському саміті AI Impact Summit, щоб зосередитися на ключових пріоритетах на тлі питань про його зв'язки з Джеффрі Епштейном. Мільярдер і співзасновник Microsoft мав виступити на заході, де його фонд співпрацює з урядом Індії в галузі штучного інтелекту для суспільного блага.

Стартапи в галузі штучного інтелекту в Сан-Франциско вимагають від співробітників безперервної працездатності, стираючи межі між роботою та особистим життям. Засновник працює 7 днів на тиждень по 12 годин на день, що свідчить про інтенсивний тиск в економіці штучного інтелекту.

Нова серія The Guardian під назвою «Reworked» фокусується на досвіді працівників у зв'язку зі змінами на робочому місці, спричиненими штучним інтелектом, і ставить під сумнів загальноприйняті уявлення. Цей річний проект показує, як штучний інтелект змінює засоби до існування, можливості та майбутнє мільйонів американців у різних галузях промисловості.

На весняному гала-концерті China Media Group 2026 року були представлені гуманоїдні роботи, які виконували бойові мистецтва, викликавши захоплення і занепокоєння. Експерти обговорюють наслідки розвитку робототехнічних технологій у Китаї.

Прем'єр-міністр Іспанії закликає провести розслідування щодо X, Meta та TikTok за можливі кримінальні злочини, пов'язані з матеріалами про сексуальне насильство над дітьми, з метою покласти край безкарності онлайн-платформ та захистити психічне здоров'я і права дітей. Іспанія вживає заходів для притягнення до відповідальності гігантів соціальних медіа, очолюваних прем'єр-міністром Педро Санчес...

Професор Майкл Вулдрідж попереджає, що смертельне оновлення безпілотного автомобіля або злом штучного інтелекту можуть зруйнувати глобальну довіру до технологій. Комерційний тиск спонукає до поспішного виведення на ринок нових інструментів штучного інтелекту, не до кінця зрозумівши їхні можливості та недоліки.

Технологічні мільярдери з Google, Anthropic та OpenAI візьмуть участь у саміті з питань штучного інтелекту, який організовує Нарендра Моді в Делі. Лідери країн південної півкулі змагатимуться за контроль над технологіями штучного інтелекту на тижневому заході, в якому візьмуть участь технологічні компанії з капіталом у трильйони доларів.

Індія приймає саміт AI Impact Summit за участю світових лідерів, щоб прискорити промислову революцію в галузі штучного інтелекту. NVIDIA співпрацює з Yotta, L&T, E2E Networks, щоб розширити інфраструктуру штучного інтелекту в Індії за допомогою понад 20 000 графічних процесорів.

Дослідники з MIT та Penn State виявили, що функції персоналізації у великих мовних моделях можуть призвести до підлещування, зниження точності та поширення дезінформації. Тривалі взаємодії з LLM можуть створювати ехо-камери, що підкреслює важливість розуміння їх динамічної поведінки.

Цифрова суверенність Європи перебуває під загрозою через залежність від американських технологій. Санкції впливають навіть на Міжнародний кримінальний суд, що підкреслює необхідність створення загальноєвропейської платіжної системи.

Генератор відео на базі штучного інтелекту Seedance 2.0 від ByteDance став вірусним завдяки кліпам, в яких Том Круз і Бред Пітт б'ються. Голлівуд злякався, коли користувачі створили реалістичні відео за допомогою короткого текстового підказки.

Технологічні компанії вводять в оману, прирівнюючи традиційну штучну інтелігенцію до енергоємної генеративної штучної інтелігенції для вирішення кліматичних проблем. Аналіз показує, що основна увага приділяється машинному навчанню, а не енергоємним інструментам, що сприяють зростанню центрів обробки даних.